Monitoramento de API é a prática contínua e automatizada de validar endpoints de API quanto à disponibilidade, tempo de resposta e correção dos dados — confirmando não apenas que um endpoint responde, mas que retorna os dados corretos, no formato correto, dentro de uma latência aceitável, do ponto de vista dos usuários e sistemas dependentes.

APIs são o tecido conectivo do software moderno. Toda vez que um usuário faz login, realiza um pagamento ou recebe uma notificação em tempo real, múltiplas chamadas de API são executadas nos bastidores — frequentemente entre microsserviços, provedores de nuvem e fornecedores terceirizados. Quando essas chamadas falham ou desaceleram, o impacto é imediato: fluxos de checkout interrompidos, usuários bloqueados e receita perdida.

No entanto, a maioria das equipes só descobre falhas na API quando os clientes as relatam. Sem monitoramento proativo, o atraso entre a falha e a investigação geralmente é medido em dezenas de minutos — tempo suficiente para expor riscos reais de receita e SLA antes que alguém seja notificado.

Este guia explica o que é o monitoramento de API, como funciona, quais métricas acompanhar, como ele difere do teste de API e do APM, e como implementá-lo — com a precisão que engenheiros DevOps, SREs e equipes de QA precisam para tomar decisões informadas em produção.

O que é Monitoramento de API?

O monitoramento de API cobre três camadas distintas de validação, em ordem de especificidade crescente:

- Monitoramento de disponibilidade — O endpoint está acessível? Ele retorna uma resposta HTTP sem timeout?

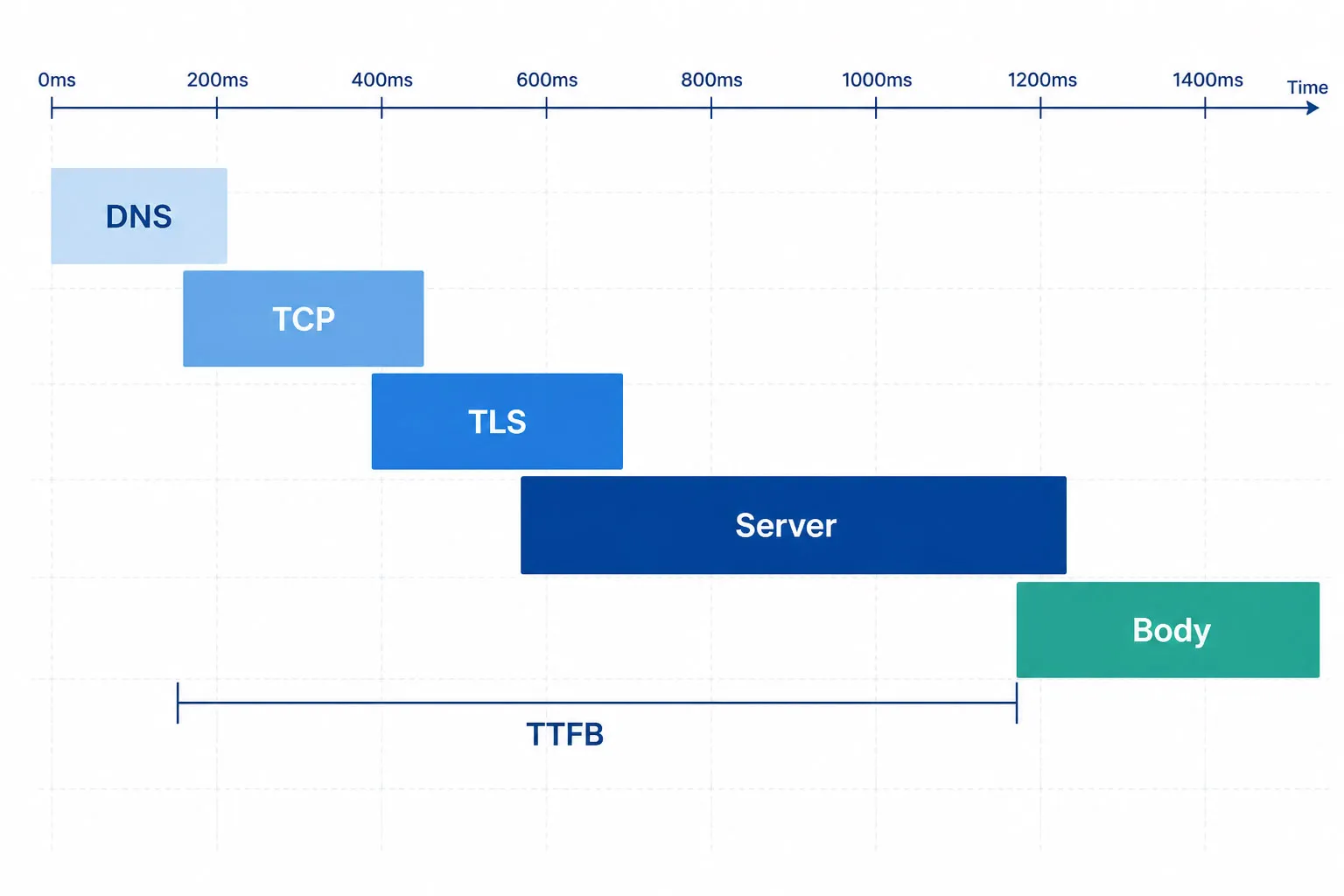

- Monitoramento de desempenho — Quanto tempo a resposta leva? O TTFB, resolução DNS ou handshake TLS estão introduzindo latência?

- Validação de payload — O corpo da resposta contém a estrutura de dados esperada? As assertivas JSONPath ou XPath são aprovadas?

O que é um Endpoint de API?

Uma interface de programação de aplicações (API) é um conjunto de protocolos e definições que permite que sistemas de software se comuniquem. Um endpoint de API é a URL específica na qual uma API recebe requisiçõese retorna respostas — a unidade de observação para monitoramento de API. Por exemplo:

POST /v2/auth/token— endpoint de emissão de tokenGET /v2/orders/{id}— endpoint de recuperação de pedidoPOST /v2/payments/charge— endpoint de processamento de pagamento

Aplicações modernas dependem simultaneamente de dezenas ou centenas desses endpoints — microsserviços internos, gateways de pagamento de terceiros, provedores de identidade, APIs de envio e sistemas CRM. O monitoramento de API mantém a visibilidade em todos eles.

Tipos de Monitoramento de API

Nem todo monitoramento de API é igual. Compreender as categorias ajuda as equipes a construir uma cobertura que corresponda tanto à sua arquitetura quanto aos seus requisitos de negócios. Os cinco tipos principais se aplicam a quase todas as equipes; os tipos especializados são importantes quando suas condições se aplicam.

Tipos Principais

| Tipo | O Que Valida | Melhor Para |

|---|---|---|

| Monitoramento de Disponibilidade | Alcance do endpoint; códigos de resposta HTTP; resposta dentro da janela de timeout | SLAs básicos de disponibilidade; detecção imediata de indisponibilidade |

| Monitoramento de Desempenho | Tempo de resposta, TTFB, resolução DNS, handshake TCP, tempo TLS, throughput | SLAs de latência, metas P95/P99, planejamento de capacidade |

| Monitoramento de Payload / Validação | Corpo da resposta via asserções JSONPath/XPath; correção do esquema; valores dos campos | Captura de falhas silenciosas onde HTTP 200 ≠ dados corretos |

| Monitoramento Sintético | Chamadas API simuladas de locais globais em intervalos programados, independentemente do tráfego real | Detecção proativa; cobertura geográfica; períodos sem tráfego |

| Monitoramento de Transação Multi-Etapas | Sequências encadeadas de chamadas API (ex.: auth → query → submit → confirm); passagem de dados entre etapas | Fluxos de e-commerce, jornadas de login, workflows de pedidos |

Tipos Especializados

| Tipo | O Que Valida | Melhor Para |

|---|---|---|

| Monitoramento de Segurança | Falhas de autenticação, padrões anômalos de requisição, expiração de certificados, abuso de limite de taxa, replay de token | FinTech, saúde; APIs que manipulam PII/PHI |

| Verificações Relacionadas à Conformidade | Validação de versão/cifra TLS, expiração de certificado, presença de cabeçalho de segurança, testes de aplicação de autenticação | Saúde, serviços financeiros, indústrias reguladas |

| Monitoramento de Usuário Real (RUM) | Interações reais de usuários com a API; visibilidade de sessão completa; variação real de localização geográfica e dispositivo | >Compreendendo o verdadeiro impacto no usuário; validando descobertas sintéticas |

| Monitoramento de Versionamento e Depreciação | Taxas de adoção de versões da API; picos de erro após mudanças de versão; compatibilidade retroativa | Equipes gerenciando múltiplas versões de API simultaneamente |

| Monitoramento de Terceiros / Integração | Dependências de APIs externas (Stripe, Okta, Salesforce, Twilio); isolando falhas externas vs. internas | Qualquer aplicativo que dependa de APIs de terceiros para fluxos críticos de trabalho |

Uma nota sobre verificações relacionadas à conformidade: elas fornecem evidências de apoio para controles técnicos específicos. A conformidade com frameworks (HIPAA, PCI DSS, SOC 2) requer governança organizacional mais ampla além do que o monitoramento sozinho pode oferecer.

Monitoramento Sintético vs. Monitoramento de Usuário Real (RUM)

Ambas as abordagens fornecem dados de desempenho de API, mas de pontos de vista fundamentalmente diferentes:

| Monitoramento Sintético | Monitoramento de Usuário Real (RUM) | |

|---|---|---|

| Acionamento | Verificações roteirizadas em um cronograma (ex: a cada 1 minuto) | Requisições reais de usuários em produção |

| Cobertura | Opera 24/7 — incluindo quando nenhum usuário real está ativo | Gera dados apenas quando usuários estão ativamente fazendo requisições |

| Detecção | Proativo — captura falhas antes que algum usuário seja impactado | Reativo — revela problemas depois que usuários já foram afetados |

| Escopo | APIs públicas e privadas/internas (via Agente Privado) | APIs alcançadas por usuários/clientes reais — principalmente públicas, embora o RUM empresarial também possa capturar chamadas internas de API de aplicativos instrumentados |

| Caso de uso | Validação contínua de disponibilidade e desempenho | Compreensão do verdadeiro raio de impacto e experiência real do usuário |

Principais Métricas de Monitoramento de API

Acompanhar as métricas corretas é a diferença entre uma resposta a incidentes informada e a fadiga de alertas. Abaixo estão as métricas que mais importam — com benchmarks precisos e o que cada uma indica.

| Métrica | Meta / Referência | O Que Detecta |

|---|---|---|

| Disponibilidade (Uptime %) | ≥ 99,9% (três noves); 99,99% para APIs críticas para receita | Interrupção total, interrupção parcial, tempo limite |

| Tempo Total de Resposta | < 200ms para endpoints simples; < 1s para operações complexas | Lentidão do servidor, sobrecarga, regressões após deploy |

| Tempo para o Primeiro Byte (TTFB) | < 100ms ideal; < 300ms aceitável | Atraso no processamento do servidor antes do início da resposta |

| Tempo de Resposta P95 / P99 | Alerta a 2× seu baseline P95 por endpoint; ajuste conforme comportamento do endpoint | Latência extrema afetando os 1–5% mais lentos das requisições |

| Taxa de Erro (4xx / 5xx) | < 0,1% para APIs em produção | Falhas de autenticação, tratamento incorreto de entrada, erros de servidor |

| Tempo de Resolução DNS | < 50ms para consultas em cache na mesma região; inter-região pode exceder 100ms | Problemas de propagação DNS, falhas do resolvedor |

| Tempo de Handshake TLS | < 100ms | Configuração incorreta de certificado, problemas na negociação da versão TLS |

| Taxa de Aprovação de Asserção de Payload | 100% (alerta em qualquer falha) | Falhas silenciosas: respostas HTTP 200 com dados incorretos ou ausentes |

| Throughput (req/seg) | Comparar com o baseline histórico | Quedas inesperadas de tráfego ou picos anormais |

| Expiração do Certificado (dias restantes) | Alerta em 30 dias; crítico em 7 dias | Expiração iminente do certificado TLS |

Benchmarks de Tempo de Resposta

Como Funciona o Monitoramento de API?

Compreender os aspectos técnicos ajuda as equipes a configurar o monitoramento corretamente e interpretar os resultados com precisão.

O Loop Central de Monitoramento

- Agendar. Uma verificação sintética é executada em um intervalo configurado (por exemplo, a cada 1 minuto) a partir de uma localização global de monitoramento selecionada.

- Enviar solicitação. O agente de monitoramento envia uma requisição HTTP para o endpoint alvo — incluindo o método HTTP (GET, POST, PUT, PATCH, DELETE), cabeçalhos da requisição, credenciais de autenticação e corpo da requisição.

- Medir o tempo. O agente registra o tempo de resolução de DNS, tempo de conexão TCP, tempo de handshake TLS, Time to First Byte (TTFB) e o tempo total de resposta como componentes distintos.

- Validar. A resposta é avaliada contra asserções configuradas — código de status HTTP, limite de tempo de resposta, cabeçalhos de resposta e conteúdo do payload via JSONPath (REST) ou XPath (SOAP).

- Alertar ou passar. Se alguma asserção falhar ou se a requisição expirar, um incidente é criado e alertas são enviados conforme as regras de notificação configuradas.

- Registrar. Todos os resultados — sucesso e falha — são armazenados com carimbos de data/hora, dados da resposta e resultados das asserções para análise histórica e relatórios de SLA.

Monitoramento de Transações de API em Múltiplas Etapas

A monitoramento de endpoint único confirma que endpoints individuais respondem. Mas as jornadas reais do usuário não são chamadas API únicas — são sequências encadeadas onde cada etapa depende da saída da etapa anterior.

Considere um fluxo de checkout de comércio eletrônico:

- Etapa 1 —

POST /auth/token: Autenticar usuário; extrairaccess_tokendo corpo da resposta - Etapa 2 —

GET /products/{id}: Buscar detalhes do produto; inserir token no cabeçalhoAuthorization - Etapa 3 —

POST /cart/add: Adicionar item; extraircart_idda resposta - Etapa 4 —

POST /checkout/initiate: Iniciar checkout comcart_id; extraircheckout_session_id - Etapa 5 —

POST /payments/charge: Processar pagamento; afirmar que o campo da respostaorder_statusé igual a'confirmed'

No monitoramento de endpoint único, todas as cinco etapas podem passar individualmente enquanto a transação completa falha — porque os dados da sessão não são passados corretamente entre as etapas, um token expira no meio do fluxo ou a API de pagamento retorna HTTP 200 com um campo de erro no payload. O monitoramento multi-etapas executa toda a cadeia como um monitor, valida cada passo independentemente e passa valores dinâmicos (tokens, IDs de sessão, IDs de pedido) entre as etapas automaticamente.

Dotcom-Monitor possibilita monitoramento de transações multi-etapas ao encadear chamadas API sequenciais em uma única tarefa de monitoramento. A extração e injeção de variáveis entre etapas é automática. Cada etapa é afirmada de forma independente, portanto as falhas são identificadas exatamente na etapa onde a transação quebrou.

Validação de Payload: Asserções JSONPath e XPath

A validação de payload é o que diferencia o monitoramento de um simples ping de disponibilidade. Como as asserções são expressas depende da ferramenta, mas a lógica é consistente:

- Acesso a campo JSONPath (REST): Acessar

$.data.status— e então afirmar que o valor retornado é igual a'active' - Verificação de array JSONPath: Acessar

$.items— afirmar que o tamanho do array é maior que 0 - Asserção XPath (SOAP):

//order/status/text()— afirmar que o valor do nó é igual a'confirmed' - Asserção de cabeçalho: Afirmar que o valor do cabeçalho

Content-Typeé igual a'application/json' - Asserção de tempo de resposta: Afirmar que o tempo total de resposta está abaixo de 500ms

Monitoramento de Autenticação

APIs de produção requerem autenticação. Uma ferramenta de monitoramento deve lidar com os mesmos métodos de autenticação que seus clientes reais de API. Os esquemas que uma plataforma de monitoramento pronta para produção deve suportar:

| Método de Auth | Descrição | Notas |

|---|---|---|

| OAuth 2.0 — Client Credentials | Máquina para máquina; o cliente troca credenciais por um token diretamente | Mais comum para monitoramento de API servidor-servidor |

| OAuth 2.0 — Authorization Code | Autorização delegada pelo usuário; tipicamente usado com PKCE para SPAs/apps móveis | Requer que a ferramenta de monitoramento faça o refresh do token automaticamente |

| OAuth 2.0 — Resource Owner Password (ROPC) | Troca direta de nome de usuário + senha — fluxo legado | Use somente onde Authorization Code não for viável |

| Bearer Token (JWT) | Token estático ou dinamicamente atualizado no cabeçalho Authorization |

JWTs de curta duração requerem atualização automática do token |

| API Key | Chave estática no cabeçalho, parâmetro de consulta ou cookie | Mais simples de monitorar; atenção a eventos de rotação |

| Basic Authentication | username:password codificado em Base64 no cabeçalho Authorization |

Legado — ainda comum em APIs internas e empresariais |

| AWS Signature v4 | Requisição assinada HMAC usando credenciais AWS | Obrigatório para endpoints do AWS API Gateway |

| mTLS / Client Certificate | TLS mútuo — ambos os lados apresentam certificados | Ambientes zero-trust; monitoramento de expiração de certificado é crítico |

| NTLM / Kerberos | Autenticação integrada Windows/Active Directory | APIs internas empresariais; menos comum em stacks cloud-native |

| Custom Headers | Esquemas proprietários de autenticação via cabeçalhos personalizados | Categoria geral para implementações não padrão de autenticação |

A expiração do token é uma das principais causas de falsos positivos no monitoramento. Os tempos de vida dos tokens de acesso OAuth 2.0 variam amplamente conforme a implementação e o tipo de concessão. Tokens delegados pelo usuário (fluxo Authorization Code) tipicamente variam de 15 minutos a 1 hora. Tokens máquina-a-máquina (fluxo Client Credentials) são frequentemente configurados para janelas mais longas — 1 hora a 24 horas — para reduzir a sobrecarga de refresh. Ambientes de alta segurança podem impor tempos de vida tão curtos quanto 5 minutos. Independentemente da janela, um monitoferramenta de monitoramento que não lida com atualização automática de token gerará falsos positivos ou exigirá rotação manual de credenciais, criando tanto sobrecarga operacional quanto risco de indisponibilidade.

Uma nota sobre o grant implícito do OAuth 2.0: ele está depreciado nas melhores práticas de segurança atuais do OAuth 2.0 (RFC 9700) e não deve ser usado em novos sistemas. Se suas APIs existentes usam o fluxo implícito, a migração para Código de Autorização + PKCE é fortemente recomendada.

Por que o Monitoramento de API Importa: Impacto nos Negócios

APIs não são abstrações de infraestrutura — são caminhos de receita. Quando falham, as consequências são financeiras, operacionais e contratuais.

O Custo de Falhas de API Não Detectadas

Sem monitoramento proativo, as equipes dependem de relatórios de clientes para detectar falhas. Pesquisas do setor consistentemente colocam o MTTD reportado por clientes bem acima de 30 minutos — quando uma reclamação é registrada, investigada, triada e escalada, esse período já passou. O monitoramento sintético contínuo com intervalos de checagem de 1 minuto reduz a detecção para menos de 60 segundos, permitindo o isolamento da causa raiz antes que o problema se agrave.

A fórmula da receita é direta: pedidos/min × valor médio do pedido × duração da indisponibilidade em minutos. Uma plataforma que processa 100 pedidos/min com valor médio de $50 perde $25.000 em receita potencial durante uma indisponibilidade de 5 minutos na API de pagamento. Insira seu próprio volume e valor de pedido para dimensionar sua exposição.

Cenários Específicos por Indústria

- E-commerce. Uma falha na API de checkout durante o pico de tráfego interrompe todas as conversões. Uma API de autorização de pagamento que retorna HTTP 200 com status negado — mas sem alerta — bloqueia silenciosamente transações por minutos antes que alguém perceba.

- FinTech. APIs de processamento de transações devem cumprir requisitos de latência abaixo de um segundo. Degradação persistente acima dos limites do SLA pode gerar penalidades contratuais e constatações de auditoria sob PCI DSS.

- Saúde. APIs de integração de EHR e pontos finais de telemedicina devem manter a troca de dados em conformidade com HIPAA. Uma API que retorna HTTP 200 com dados incompletos do paciente é um evento de conformidade — não apenas uma questão de desempenho.

- SaaS / API-como-Produto. Quando sua API é um produto faturável, o tempo de inatividade gera penalidades contratuais de SLA e perda de clientes. O monitoramento fornece a evidência documentada de uptime necessária para relatórios de conformidade com SLA.

- TI Corporativa. Integrações de API de CRM, ERP e RH entre departamentos. Uma degradação da API do Salesforce pode silenciosamente quebrar fluxos de trabalho de vendas em toda a organização sem que um único erro 500 apareça nos seus logs.

Risco de APIs de Terceiros

Aplicações modernas dependem de APIs externas que não controlam: gateways de pagamento (Stripe, PayPal, Braintree), provedores de identidade (Okta, Auth0, AWS Cognito), shAPIs de envio e sistemas CRM. Quando eles falham, sua aplicação parece quebrada para os usuários, mesmo que sua infraestrutura esteja saudável.

Monitorar endpoints de terceiros permite que as equipes isolem imediatamente se uma falha é interna ou externa — uma distinção que pode levar tempo significativo de investigação para ser estabelecida sem dados prévios de monitoramento. Também fornece evidência documentada para responsabilizar fornecedores pelos SLAs publicados.

Pare de descobrir falhas de API pelos seus clientes.

A monitoramento sintético de API da Dotcom-Monitor detecta falhas em menos de 60 segundos e direciona alertas diretamente para PagerDuty, Slack ou Microsoft Teams. Monitore gateways de pagamento, provedores de identidade e APIs internas em uma única plataforma.

Experimente grátis por 30 dias → Não é necessário cartão de crédito

Monitoramento de API vs. Teste de API

Ambas as práticas validam o comportamento da API, mas servem a propósitos diferentes no ciclo de vida de entrega de software. Confundi-las cria lacunas de cobertura.

| Dimensão | Teste de API | Monitoramento de API |

|---|---|---|

| Quando | Pré-implantação — desenvolvimento, QA, pipeline CI/CD | Pós-implantação — continuamente em produção |

| Ambiente | Desenvolvimento, staging, ambiente de teste controlado | Produção ao vivo, infraestrutura real, tráfego real |

| Gatilho | Commit de código, build, execução manual, porta PR | Agendado (ex: a cada 1 minuto), contínuo 24/7 |

| Objetivo | Prevenir bugs de chegarem à produção | Detectar falhas e degradação em produção |

| Cobertura | Todos os comportamentos, casos extremos, caminhos de erro | Caminhos críticos, endpoints de SLA, cadeias da jornada do usuário |

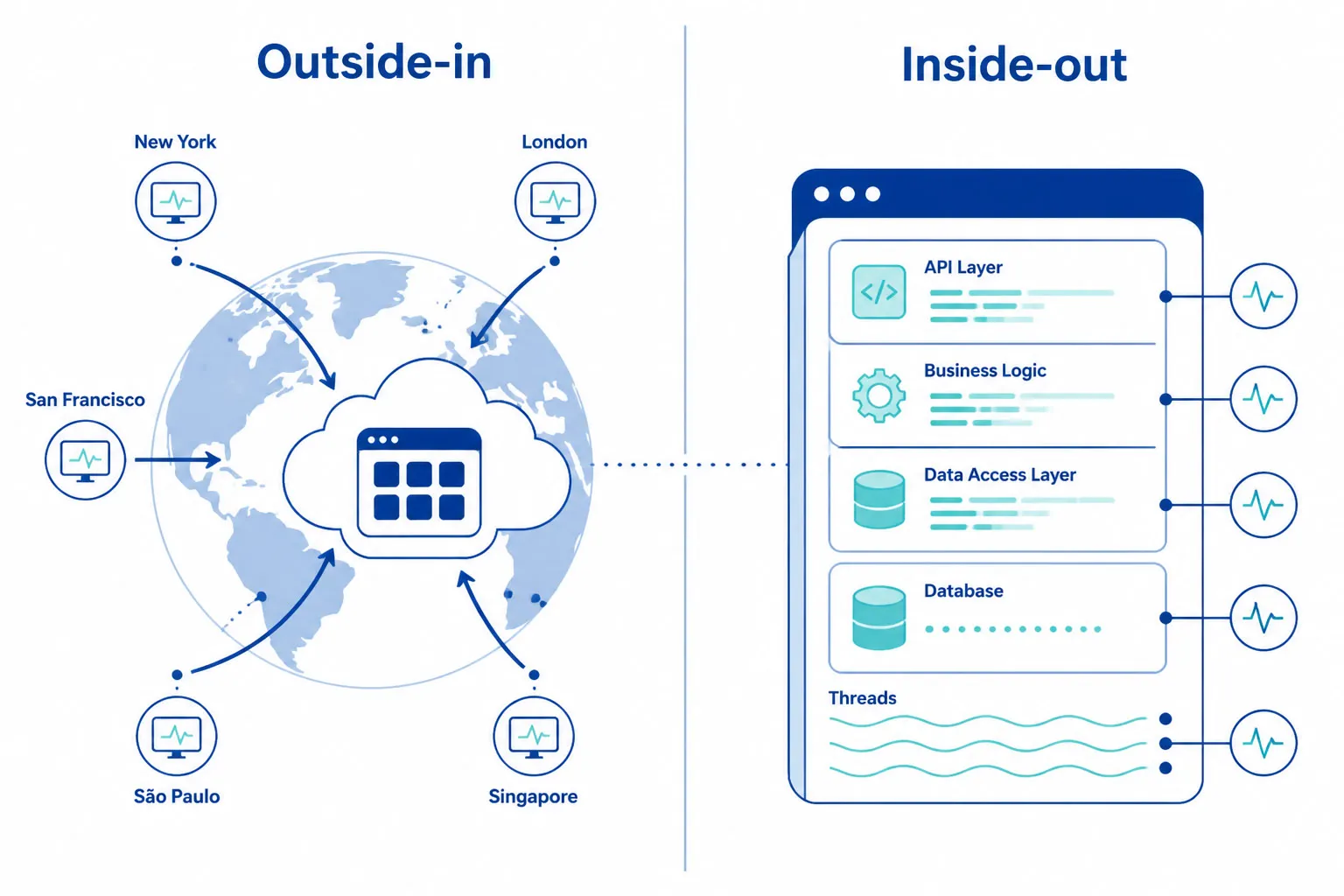

| Perspectiva | De dentro para fora: testa o comportamento do código | De fora para dentro: valida do ponto de vista do usuário |

| Resultado | Relatório de aprovação/reprovação; bloqueia a implantação em falha | Alertas em tempo real, registros de SLA de uptime, histórico de incidentes |

O relacionamento prático: Testes de API são uma atividade na fase de desenvolvimento. Monitoramento de API é uma atividade operacional. Testes detectam bugs antes da implantação; monitoramento detecta falhas, regressões, degradação de desempenho e problemas de dependência após a implantação — sob condições reais de infraestrutura que diferem de ambientes de teste controlados.

Um nível avançado dea equipe de engenharia executa ambos — e usa importações de Coleções Postman para conectar os dois, convertendo testes de desenvolvimento em monitores de produção sem duplicar definições de requisição.

Monitoramento de API vs. APM

Essas duas categorias são frequentemente confundidas. Elas são complementares, não intercambiáveis.

| Monitoramento Sintético de API | APM (Monitoramento de Performance de Aplicações) | |

|---|---|---|

| Perspectiva | De fora para dentro — valida do mesmo ponto de vista que usuários e parceiros | De dentro para fora — observa o comportamento interno da aplicação |

| O que vê | Falhas de DNS, problemas de roteamento de rede, erros TLS, rotas incorretas de CDN, lacunas geográficas | Consultas lentas ao BD, vazamentos de memória, exceções no código, chamadas lentas de função |

| Quando executa | 24/7 — mesmo durante períodos de zero tráfego | Apenas quando requisições reais estão sendo processadas |

| Pergunta que responde | “Nossos clientes podem realmente chamar esta API agora?” | “O que está acontecendo dentro da nossa aplicação quando uma requisição chega?” |

Equipes com o MTTR mais baixo usam ambos: APM para análise interna da causa raiz, monitoramento sintético de API para validação externa. Logs e rastreamentos respondem “o que deu errado em nosso código?” O monitoramento sintético responde “nossos clientes podem usar esta API agora?”

Protocolos de API: REST, SOAP, GraphQL, gRPC e WebSocket

Cada protocolo de API tem requisitos de monitoramento e modos de falha distintos. Uma ferramenta de monitoramento que trata todas as APIs como simples requisições HTTP GET vai perder problemas específicos do protocolo.

Monitoramento de API REST

REST é o protocolo de API dominante. O monitoramento valida métodos HTTP (GET, POST, PUT, PATCH, DELETE), códigos de status, cabeçalhos de resposta e corpos JSON via asserções JSONPath. Requisitos chave: afirmar valores dos campos do payload da resposta — não apenas códigos de status; monitorar todos os métodos HTTP, não apenas GET (POST, PUT e DELETE ativam lógicas diferentes no lado do servidor e falhasmodos); acompanhe o tempo de resposta por endpoint individualmente, não como médias agregadas entre os endpoints.

Monitoramento de API SOAP

APIs SOAP trocam XML via HTTP. Requisitos de monitoramento: importação WSDL para definição de endpoint e esquema; assertivas XPath em elementos de resposta XML; suporte aos protocolos SOAP 1.1 e SOAP 1.2; configuração WS-Security para serviços SOAP corporativos usando segurança em nível de mensagem.

Monitoramento de API GraphQL

O principal desafio do GraphQL para monitoramento: a maioria das implementações de servidores GraphQL retorna HTTP 200 mesmo para erros parciais ou consultas malformadas. O código de status HTTP não é um sinal confiável de falha. Você deve:

- Enviar cargas de consulta específicas e fazer assertivas no objeto

datada resposta - Verificar o array

errorsno corpo da resposta — no GraphQL padrão, toda resposta tem um campo opcionalerrorsno nível superior que está vazio ou ausente em caso de sucesso e preenchido em caso de falha. Uma resposta 200 comerrors[]preenchido significa que a requisição falhou no nível GraphQL mesmo com sucesso HTTP - Validar os invariantes de dados específicos da consulta: garantir que os campos esperados estejam presentes, não nulos e corretos em tipo no objeto data — alguns sistemas codificam falhas de domínio dentro do objeto data ao invés de preencher o array de erros no nível superior

- Monitorar limites de complexidade e profundidade da consulta para detectar degradação de desempenho antes que cause timeouts

Monitoramento de API gRPC

gRPC usa Protocol Buffers sobre HTTP/2 por padrão, embora gRPC-Web suporte HTTP/1.1 via proxy para clientes em navegador. Requisitos de monitoramento: importação do arquivo proto para definições de serviço e método; suporte à codificação/decodificação binária para mensagens Protocol Buffer; validação de códigos de status usando códigos gRPC (OK, UNAVAILABLE, DEADLINE_EXCEEDED, etc.) — não códigos HTTP; suporte aos tipos RPC Unary, Server-Streaming, Client-Streaming e Bidirectional-Streaming.

Monitoramento de API WebSocket

APIs WebSocket mantêm conexões bidirecionais persistentes para dados em tempo real. O monitoramento valida o tempo de estabelecimento da conexão e sucesso do handshake WebSocket, latência de entrega de mensagem e correção do payload, além da estabilidade da conexão ao longo do tempo incluindo comportamento de reconexão após quedas.

Monitoramento de API Pública vs. Monitoramento de API Interna

A maioria dos guias de monitoramento de API foca exclusivamente em endpoints públicos. Mas em arquiteturas de microserviços, a maioria das chamadas críticas de API são internas — chamadas serviço a serviço que nunca chegam à internet pública.

| Monitoramento de API Pública | Monitoramento de API Interna | |

|---|---|---|

| O que cobre | Endpoints voltados para clientes, APIs de parceiros, integrações de terceiros | Microserviços internos, VPCs privadas, ambientes de staging, APIs atrás de firewall |

| Como funciona | Agentes de monitoramento externos realizam verificações a partir de locais globais pela internet pública | Um Agente Privado implantado dentro da sua rede inicia conexões outbound para a plataforma de monitoramento |

| Requisitos de firewall | Nenhum — as verificações originam-se externamente | Não são necessárias regras inbound — o agente inicia apenas conexões outbound |

| O que detecta | Falhas de resolução DNS, problemas de roteamento CDN, erros TLS, lacunas de disponibilidade geográfica | Falhas entre serviços, latência em microserviço de autenticação, degradação de API de consulta a banco de dados |

| Implantação | Sem instalação — funciona imediatamente | Agente instalado on-premises ou em nuvem privada (suporte a Windows e Linux) |

APIs internas de microserviços são a fonte mais comum de falhas em cascata. Um serviço de autenticação degradado ou uma API lenta de acesso a dados causa problemas subsequentes que aparecem como falhas no frontend — dificultando a localização da causa raiz sem visibilidade interna. Monitorar APIs internas permite que as equipes isolem se a falha está na camada de API, no microserviço downstream, ou no banco de dados. Saiba mais sobre monitoramento com Agente Privado atrás do seu firewall.

Melhores Práticas para Monitoramento de API

Essas práticas reduzem o tempo médio para detecção (MTTD), melhoram a precisão dos alertas e garantem que a cobertura de monitoramento corresponda ao risco de produção.

- Monitore em intervalos de 1 minuto para endpoints críticos de receita. Para APIs de pagamento, autenticação e dados centrais, cada minuto não detectado impacta diretamente os negócios. Intervalos de 5 ou 15 minutos são aceitáveis para endpoints de menor criticidade.

- Execute verificações a partir de pelo menos 5 locais geograficamente distribuídos. Um único local de monitoramento não pode detectar falhas regionais de DNS, configurações incorretas de CDN ou problemas de roteamento geoespecíficos. No mínimo, cubra América do Norte, Europa e Ásia—Pacífico.

- Valide o conteúdo da carga útil, não apenas os códigos de status. Configure asserções JSONPath para cada endpoint crítico. As falhas silenciosas mais caras são APIs que retornam HTTP 200 com dados incompletos, desatualizados ou malformados.

- Use limites de alerta derivados da linha de base, não valores estáticos em milissegundos. Estabeleça uma linha de base de tempo de resposta por endpoint e configure alertas em 2× o valor P95. Limites estáticos geram falsos positivos durante picos normais de tráfego.

- Inclua autenticação em suas cadeias de monitoramento. Expiração de token, falhas na atualização OAuth e rotação de certificados são causas principais de interrupções de API. Monitorar etapas de autenticação detecta falhas relacionadas a credenciais antes que se agravem.

- Construa monitores de transações em múltiplas etapas para cada jornada crítica do usuário. Fluxos de login, sequências de checkout e workflows de envio de dados são chamadas de API encadeadas. Monitores de endpoint único não conseguem detectar falhas entre etapas causadas por passagem incorreta de dados ou gerenciamento de sessão.

- Monitore dependências de API de terceiros como monitores separados. Crie monitores dedicados para Stripe, Okta, Salesforce e outras dependências externas. Isso responde imediatamente se uma falha é interna ou externa.

- Importe coleções Postman ou Insomnia para iniciar o monitoramento. Converta definições de API existentes em monitores de produção 24/7 sem recriar estruturas de requisição. Isso elimina a lacuna entre testes em tempo de desenvolvimento e monitoramento em produção.

- Integre verificações de API após implantação em pipelines CI/CD. Execute verificações sintéticas de API como testes automatizados após cada implantação. Se as verificações pós-implantação falharem, considere acionar uma reversão automatizada ou suspensão de tráfego em configurações de entrega progressiva (blue/green ou canário) — usando execuções de confirmação de uma segunda localização para reduzir falsos positivos antes de tomar qualquer ação automatizada.

- Direcione alertas para PagerDuty, Slack ou Microsoft Teams com políticas de escalonamento. Alertas apenas por e-mail criam atraso na detecção. Integrações nativas com ferramentas de gerenciamento de incidentes garantem que alertas cheguem à pessoa certa imediatamente, com caminhos de escalonamento definidos para ausência de resposta.

Desafios do Monitoramento de API

Mesmo configurações de monitoramento bem projetadas enfrentam desafios operacionais. Antecipá-los ajuda as equipes a projetar soluções adequadas.

Visibilidade de API de Terceiros

Monitorar dependências externas fornece dados de disponibilidade e latência, mas não consegue expor a causa interna de uma degradação. Quando Stripe ou Okta desaceleram, você pode confirmar e isolar o raio de impacto — mas a análise de causa raiz depende de páginas de status do fornecedor e caminhos de escalonamento de suporte.

Limitação de Taxa

Os agentes de monitoramento contam para os limites de taxa da sua API. O volume total de solicitações sintéticas escala como: locais × verificações por hora × chamadas de API por execução do monitor × tentativas de confirmação. Para um monitor de endpoint único: 30 locais × 60 verificações/hora = 1.800 solicitações/hora. Para um monitor de transação de 5 etapas com as mesmas configurações: 30 × 60 × 5 = 9.000 solicitações/hora por monitor. Considere isso no orçamento do limite de taxa, especialmente para APIs internas com limites mais restritos. Certifique-se de que os intervalos de IP do seu provedor de monitoramento estejam na lista de permissões onde necessário.

Complexidade de Autenticação

APIs que utilizam tokens de curta duração exigem ferramentas de monitoramento que lidem automaticamente com a renovação do token. Tokens OAuth 2.0 delegados pelo usuário (fluxo de Código de Autorização) normalmente expiram em 15 minutos a 1 hora; tokens Client Credentials de máquina para máquina geralmente duram entre 1 e 24 horas; ambientes de alta segurança podem impor janelas de 5 minutos. Autenticação baseada em certificado e chaves de API rotativas também exigem gestão cuidadosa das credenciais.

Respostas Dinâmicas e Não Determinísticas

APIs que retornam dados com carimbo de data/hora, resultados paginados ou arrays em ordem aleatória são difíceis de validar com correspondência de valores exatos. Use expressões JSONPath que validem a estrutura, presença de campos e tipos de campo — em vez de valores exatos que mudam a cada solicitação.

Cansaço de Alertas

Monitoramento excessivo — muitos endpoints com intervalos de 1 minuto, ou limites configurados muito apertados — gera ruído que dessensibiliza as equipes a alertas reais. Use monitoramento em camadas: 1 minuto para caminhos críticos, 5 a 15 minutos para endpoints não críticos. Confirme alertas de uma localização secundária antes de enviar notificações, para eliminar falsos positivos transitórios.

Diversidade de Protocolos

REST, SOAP, GraphQL, gRPC e WebSocket exigem estratégias de validação diferentes. Uma ferramenta que só suporta REST poderá perder falhas de serviços SOAP e reportar incorretamente erros de GraphQL como sucesso porque estes retornam HTTP 200.

Como Configurar o Monitoramento de API com o Dotcom-Monitor

O Dotcom-Monitor oferece monitoramento sintético de API para REST, SOAP e GraphQL de mais de 30 locais globais, com intervalos de verificação de 1 minuto, suporte a transações de múltiplas etapas e integrações nativas com PagerDuty, Slack, and Microsoft Teams.

Passo 1 — Defina seu Endpoint e Declarações

- URL do Endpoint: O endpoint da API para monitorar

- Método HTTP: GET, POST, PUT, PATCH ou DELETE

- Headers da requisição:

Content-Type,Authorizatione quaisquer headers personalizados necessários - Corpo da requisição: Payload JSON para requisições POST/PUT

- Autenticação: OAuth 2.0, Bearer Token, API Key, Basic Auth, mTLS, AWS Signature v4, NTLM, Kerberos ou headers personalizados

- Declarações: Código de status HTTP, limite de tempo de resposta, valores de headers, declarações JSONPath/XPath no payload

Passo 2 — Importe do Postman ou Insomnia

Se sua equipe usa Postman ou Insomnia, pule completamente a configuração manual do endpoint:

- Postman: Exporte sua Collection como JSON v2.0 ou v2.1 e importe no Dotcom-Monitor. Definições de requisição, headers, corpo, variáveis de ambiente e declarações de teste são preservadas.

- Insomnia: Exporte seu workspace como arquivo JSON Insomnia v4 e importe no Dotcom-Monitor. Grupos de requisição, configurações de autenticação e variáveis de ambiente são mantidos.

Ambos os formatos de importação convertem testes desenvolvidos pontualmente em monitores de produção agendados continuamente 24/7 sem reconfiguração.

Já usa Postman? Está a 5 minutos do monitoramento de produção 24/7.

Importe sua Collection existente do Postman diretamente para o Dotcom-Monitor. Suas definições de requisição, headers, variáveis de ambiente e declarações são preservadas — nenhuma reconfiguração necessária.

Passo 3 — Configure Locais de Monitoramento e Frequência

- Frequência de checagem: Intervalos de 1, 3, 5 ou 15 minutos — configurados por endpoint com base na criticidade

- Locais de monitoramento: Selecione entre mais de 30 locais na América do Norte, Europa, Ásia-Pacífico e América do Sul

- Agente Privado: Para APIs internas ou atrás do firewall — implante o agente on-premises ou na sua nuvem privada (suporte a Windows e Linux). O agente inicia conexões outbound apenas — não são necessárias regras de firewall inbound.

- Retentativas de confirmação: Configure uma checagem de confirmação secundária em outro local antes de disparar alertas, para eliminar falsos positivos transitórios de rede

Passo 4 — Configure o Encaminhamento de Alertas

- PagerDuty: Encaminhe alertas críticos diretamente para escalas de plantão com criação automática de incidente e escalonamento

- Slack / Microsoft Teams: Envie mensagens de alerta com detalhes do endpoint, tipo de erro e dados da resposta para canais de operações

- Email, SMS, Phone call: Configure preferências de notificação por contato ou por equipe

- Webhook: Integre com OpsGenie, ServiceNow ou qualquer serviço compatível com HTTP

- Configuração de limiar: Defina condições de alerta por métrica — tempo de resposta, taxa de erro, taxa de falha de asserção — com níveis de severidade

Passo 5 — Integração com Pipeline CI/CD

- Dotcom-Monitor REST API: Crie, atualize e acione tarefas de monitoramento programaticamente via chamadas HTTP API de qualquer sistema CI/CD

- GitHub Actions / Azure DevOps / Jenkins: Adicione uma etapa pós-deploy que aciona uma execução de verificação Dotcom-Monitor, aguarda resultados e falha o pipeline se alguma asserção falhar

- Validação pré-produção: Execute os mesmos testes sintéticos contra seu ambiente de staging antes de promover builds para produção — detecte regressões antes que qualquer usuário seja afetado

Casos de Uso de Monitoramento de API por Indústria

| Indústria | APIs Críticas para Monitorar | Principais Requisitos de Monitoramento |

|---|---|---|

| E-commerce | Checkout, autorização de pagamento, inventário, envio, gerenciamento de carrinho | Cadeias de transações multi-etapas; intervalos de 1 minuto; asserção de payload no status de confirmação de pagamento |

| FinTech / Bancos | Processamento de transações, verificação KYC/AML, saldo de conta, taxas FX, APIs de transferência bancária | SLAs de latência abaixo de 200ms; checagens relacionadas a compliance suportando evidências PCI DSS; validação completa do fluxo de autenticação |

| Saúde | Integrações EHR (HL7 FHIR), portais de seguro, endpoints de telemedicina, agendamento de pacientes | Checagens relacionadas a compliance suportando evidências HIPAA; validação de payload para completude dos dados; SLA de 99,99% de uptime |

| SaaS | APIs do produto principal, endpoints de entrega webhook, APIs de integração de parceiros, APIs de autenticação | Aderência ao SLA de API-como-Produto; importação Postman para consistência dev-para-monitoramento; monitoramento de dependências de terceiros |

| TI Corporativa | CRM, ERP, HRIS, provedor de identidade, APIs internas de automação de fluxo de trabalho | Agente Privado para APIs por trás do firewall; suporte a autenticação NTLM/Kerberos; visibilidade de APIs entre departamentos |

| Mídia / Games | APIs de entrega de conteúdo CDN, autenticação, pontuação em tempo real, APIs de recursos sociais | Monitoramento de distribuição geográfica; monitoramento de conexão WebSocket; detecção de picos de tráfego |

Comece a monitorar suas APIs hoje.

Dotcom-Monitor oferece monitoramento sintético de API a partir de mais de 30 localidades globais, com checagem a cada 1 minuto intervalos, suporte a transações multi-etapas e integrações nativas com PagerDuty, Slack e Microsoft Teams. A configuração leva menos de 5 minutos. Não é necessário cartão de crédito para o teste gratuito de 30 dias.