Lorsqu’un site web tombe en panne, cela ressemble souvent à un mystère enfermé dans une boîte noire. Les visiteurs voient une roue qui tourne, un code d’erreur ou un écran blanc, mais pour les équipes informatiques et les ingénieurs DevOps, la première question est toujours la même : qu’est-ce qui a cassé ?

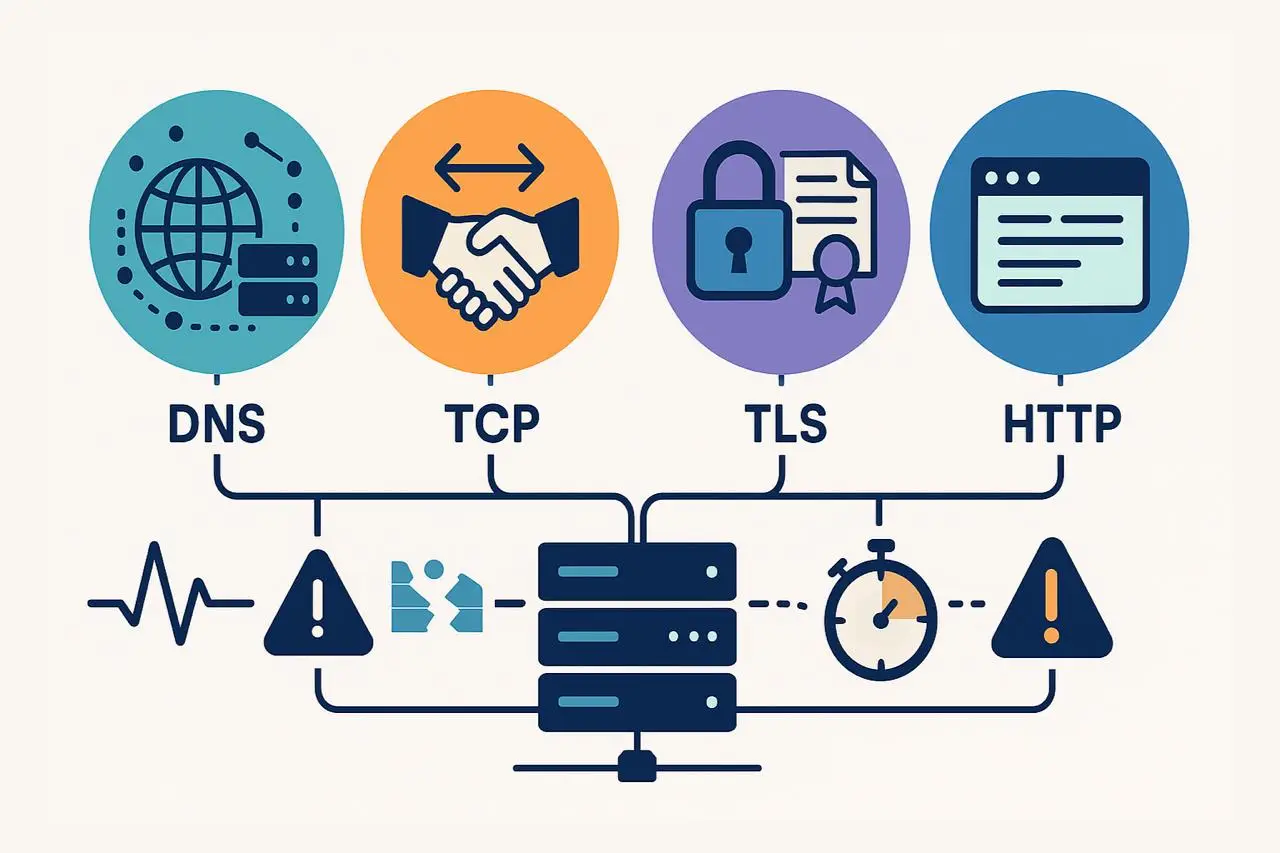

En réalité, il n’y a pas qu’une seule façon pour un site de « tomber ». Chaque requête du navigateur passe par plusieurs étapes — la résolution DNS, la connexion TCP, la négociation TLS/SSL et la réponse HTTP — et chaque couche introduit ses propres points de défaillance potentiels. Si un seul maillon de la chaîne dysfonctionne, l’expérience utilisateur entière est perturbée.

C’est pourquoi la surveillance moderne des sites va au-delà de simples vérifications de disponibilité. Un monitoring intelligent ne se contente pas de dire qu’un site est « hors ligne » ; il identifie où le problème est survenu.

- Une erreur DNS indique des problèmes de domaine ou de résolveur.

- Une défaillance TCP suggère des problèmes de connectivité ou de pare-feu.

- Une erreur TLS/SSL signale des problèmes de certificat ou de sécurité.

- Une réponse HTTP 5xx révèle des erreurs applicatives côté serveur.

En identifiant quelle couche a échoué, vos équipes peuvent répondre plus rapidement, réduire le temps moyen de résolution (MTTR) et résoudre le bon problème sans escalades inutiles ni tâtonnements.

Erreurs DNS : le premier point de défaillance d’un site

Chaque requête web commence par la résolution DNS (Domain Name System), ce qui en fait l’une des couches les plus critiques dans la chaîne de livraison d’un site. Lorsque un utilisateur saisit votre domaine dans un navigateur, la première action est une requête DNS qui traduit le nom de domaine en une adresse IP indiquant au navigateur où se connecter.

Si cette étape échoue, rien d’autre ne peut se produire. Le navigateur n’établira pas de connexion TCP, ne validera pas un certificat TLS/SSL et ne recevra pas de réponse HTTP. En d’autres termes, le DNS est la fondation, et quand il casse, tout votre site s’éteint.

C’est pourquoi la surveillance DNS est souvent le premier et le plus important indicateur d’une potentielle indisponibilité. En détectant tôt les problèmes DNS, les équipes peuvent prévenir des pannes à grande échelle, éviter des pertes de revenus et maintenir la confiance des utilisateurs avant que les problèmes n’empirent.

Erreurs DNS courantes et ce qu’elles signifient

Parce que le DNS est la première étape de chaque requête, même des problèmes mineurs ici peuvent causer des pannes majeures. Comprendre les types d’erreurs DNS courants aide les équipes à identifier plus rapidement les causes racines et à intervenir avant que le downtime n’affecte les utilisateurs.

Voici les défaillances DNS les plus fréquentes que vous rencontrerez — et ce qu’elles indiquent :

1. NXDOMAIN (domaine inexistant)

Cette erreur signifie que le nom de domaine n’existe pas ou ne peut pas être résolu.

Elle est souvent causée par :

- Domaines expirés ou non enregistrés

- Fichiers de zone DNS mal configurés

- Fautes de frappe dans les enregistrements DNS ou les entrées CNAME

Un domaine expiré peut mettre votre site hors service instantanément, tandis qu’une petite mauvaise configuration peut casser seulement un sous-domaine ou un service spécifique. La surveillance DNS continue aide à détecter ces problèmes tôt, surtout après des renouvellements de domaine ou des changements de configuration.

2. SERVFAIL (échec du serveur)

Un SERVFAIL indique que le serveur DNS autoritatif n’a pas pu traiter la requête.

Les causes courantes incluent :

- Fichiers de zone corrompus ou incomplets

- Enregistrements glue manquants

- Erreurs de validation DNSSEC

Les réponses SERVFAIL apparaissent souvent soudainement après des mises à jour système ou de configuration, ce qui en fait un signal d’alerte précoce d’un déploiement défectueux. Des contrôles de santé DNS en temps réel peuvent alerter votre équipe au moment où ces problèmes côté serveur surviennent.

3. Timeouts DNS

Un timeout survient lorsqu’une requête DNS ne reçoit pas de réponse dans la fenêtre temporelle attendue.

Causes typiques :

- Serveurs de noms surchargés ou non réactifs

- Latence réseau ou pannes de connectivité

- Attaques DDoS submergeant les résolveurs

Comme les résolutions DNS ont lieu avant la mise en cache ou la livraison de contenu, même un petit retard peut se transformer en temps de chargement de page plus long et en dégradation de l’expérience utilisateur. Le monitoring DNS global proactif — comme celui proposé par Dotcom-Monitor — teste les requêtes depuis plusieurs emplacements pour détecter ces ralentissements régionaux ou spécifiques à un fournisseur avant que les clients ne ressentent l’impact.

Comment surveiller le DNS efficacement

Surveiller la santé DNS ne se limite pas à vérifier qu’un domaine se résout une seule fois. Pour comprendre réellement la performance et la fiabilité, le monitoring doit reproduire la façon dont les utilisateurs réels expérimentent votre site depuis différents lieux et réseaux.

Voici comment implémenter un monitoring DNS complet :

Exécutez des vérifications DNS globales

Les performances DNS peuvent varier selon la géographie. Un enregistrement qui se résout instantanément depuis votre bureau local peut échouer dans une autre région à cause de problèmes de routage anycast ou de pannes réseau régionales.

Utilisez des agents de surveillance synthétique depuis plusieurs emplacements mondiaux afin de simuler des requêtes réelles et de détecter les problèmes spécifiques à une région avant qu’ils n’impactent les utilisateurs.

Des outils comme Dotcom-Monitor effectuent des tests de résolution DNS multi-région, identifiant en temps réel des pics de latence, des requêtes échouées ou des enregistrements incohérents.

Suivez le comportement du TTL (Time-to-Live)

Chaque enregistrement DNS inclut une valeur de TTL, qui définit combien de temps un résolveur met en cache l’enregistrement avant de re-interroger.

Alors que des TTL plus longs améliorent les performances pour les utilisateurs finaux, ils peuvent retarder les mises à jour après des changements de configuration ou des migrations.

Les outils de monitoring devraient vérifier que les valeurs mises à jour se propagent correctement et qu’aucune entrée de cache DNS obsolète ne persiste à travers les régions.

Configurez la détection d’anomalies et les alertes

Les insights les plus précieux du monitoring DNS proviennent de l’analyse des tendances.

- Une augmentation soudaine des réponses NXDOMAIN ou SERVFAIL

- Hausse de la latence de résolution DNS

- Incohérences régionales dans les temps de réponse

Ce sont des indicateurs précoces de problèmes plus profonds — apparaissant souvent des heures avant que les utilisateurs ne signalent des pannes. Les alertes automatiques d’anomalies DNS permettent aux équipes de réagir instantanément, assurant une haute disponibilité et une récupération plus rapide.

Lorsque le monitoring DNS est correctement implémenté, il n’identifie pas seulement les causes racines, il permet aussi d’écarter ce qui n’est pas cassé.

Si la résolution DNS échoue, vous savez que les vérifications TCP, TLS et HTTP n’ont même pas commencé. Cette clarté réduit rapidement l’investigation et aide les équipes à contacter les bons fournisseurs (hébergeurs DNS, registrars ou fournisseurs réseau) pour la résolution.

Défaillances de connexion TCP : quand le handshake réseau échoue

Après que la résolution DNS a fourni avec succès une adresse IP, l’étape suivante dans la chaîne de requête est le handshake TCP — la « poignée de main » numérique qui établit un canal de communication entre le client et le serveur.

Ce handshake suit un processus simple en trois étapes :

- Le client envoie un paquet SYN (synchronize).

- Le serveur répond avec un SYN-ACK (synchronize acknowledgment).

- Le client renvoie un ACK, complétant la connexion.

Ce n’est qu’une fois ce handshake terminé que les données peuvent commencer à circuler entre le navigateur et le serveur web.

Lorsque le TCP échoue, le navigateur sait où localiser le serveur (grâce au DNS) mais ne peut pas s’y connecter. Le résultat ressemble à un trou noir; les pages restent bloquées, les sockets restent fermés et les utilisateurs voient des spinners de chargement sans fin.

Les défaillances de DNS, qui ont tendance à être immédiates et évidentes, et les problèmes de TCP causent souvent des pannes partielles; le site peut sembler accessible pour certains utilisateurs et inaccessible pour d’autres. Ces incohérences font du monitoring TCP une couche cruciale de toute stratégie de surveillance de performance et de disponibilité.

Erreurs TCP courantes et ce qu’elles indiquent

Lorsque le processus de handshake TCP commence, plusieurs échecs liés au réseau peuvent empêcher une communication réussie entre client et serveur. Comprendre ces types d’erreurs TCP aide les équipes à diagnostiquer rapidement où la connexion se brise et quel composant du système (réseau, pare-feu ou application) nécessite une intervention.

Voici les erreurs de connexion TCP les plus communes et ce qu’elles signifient généralement :

1. Connection Refused

Cette erreur signifie que le client a atteint l’hôte cible avec succès, mais qu’aucun service n’écoutait sur le port attendu.

Causes courantes :

- Services web ou applicatifs qui plantent de façon inattendue

- Containers ou machines virtuelles terminés ou ré-déployés

- Load balancers mal configurés ou liaisons de port incorrectes

Un exemple simple : un serveur web qui n’est pas lié au port 443 (HTTPS) paraît « hors ligne » même si le serveur sous-jacent fonctionne correctement.

Bonne pratique : Utilisez la surveillance de ports TCP pour confirmer que les services sont correctement liés et écoutent sur toutes les instances. Dotcom-Monitor peut tester en continu la disponibilité des ports et alerter votre équipe lorsqu’un service cesse de répondre.

2. Connection Timed Out

Un timeout TCP survient quand des paquets sont perdus ou bloqués quelque part le long du trajet vers la destination.

Causes typiques :

- Pare-feux qui abandonnent silencieusement les paquets

- Congestion ou instabilité sur le chemin réseau

- Mauvaises configurations de routage ou problèmes au niveau du FAI

Les timeouts peuvent être particulièrement frustrants car ils n’offrent aucun retour diagnostic immédiat; les utilisateurs voient simplement un spinner jusqu’à ce que le client abandonne.

Bonne pratique : Mettez en place un monitoring de chemin TCP avec des outils qui tracent les sauts réseau et la latence. Les diagnostics réseau de Dotcom-Monitor visualisent le flux de paquets pour localiser précisément où les timeouts se produisent.

3. Connection Reset

Cela se produit lorsqu’un handshake TCP est complété mais est interrompu brusquement.

Causes fréquentes :

- Proxies ou serveurs surchargés fermant les connexions prématurément

- Paramètres agressifs de timeout inactivité sur les load balancers

- Middleboxes de sécurité (comme des WAF) rejetant des sessions jugées suspectes

Les resets apparaissent souvent comme des erreurs intermittentes difficiles à reproduire, surtout dans des architectures distribuées ou des environnements CDN.

Bonne pratique : Utilisez un monitoring continu de performance TCP pour détecter des motifs de reset et les corréler avec la charge, les politiques de sécurité ou les comportements spécifiques des proxies.

En catégorisant les erreurs ainsi, les équipes peuvent rapidement restreindre le champ du problème :

- Si le TCP échoue, la résolution DNS fonctionne, mais la connexion ne peut pas être établie.

- Cette clarté réduit le temps d’investigation et oriente la correction vers la bonne équipe — réseau, pare-feu ou opérations d’infrastructure.

Comment surveiller le TCP efficacement

Des vérifications de base comme de simples pings ICMP créent souvent une fausse impression de sécurité. Un serveur peut répondre aux pings mais échouer à compléter un handshake TCP, ce qui signifie que les utilisateurs ne peuvent pas réellement se connecter à votre site ou application.

Le véritable monitoring TCP va plus loin, validant le comportement de connexion réel et détectant des problèmes que les tests de ping de base manquent. Voici comment faire correctement :

1. Validation du handshake

Une surveillance TCP efficace commence par valider le handshake SYN/SYN-ACK/ACK sur le port de service réel (par exemple 80 pour HTTP ou 443 pour HTTPS).

Cela garantit que le serveur est joignable et écoute activement le trafic, et pas seulement qu’il est vivant au niveau réseau.

Bonne pratique : Utilisez des outils de monitoring synthétique, tels que le Network Monitoring de Dotcom-Monitor, pour tenter automatiquement des handshakes TCP complets et confirmer que chaque endpoint de service répond correctement sur tous les nœuds.

2. Analyse de chemin entre régions

Un handshake réussi dépend de chaque lien dans le chemin de connexion. L’utilisation de traceroutes ou de MTRs (My Traceroute) depuis plusieurs régions géographiques révèle où les paquets ralentissent ou s’arrêtent, que ce soit dans votre data center, au point d’accès CDN ou en amont chez votre FAI.

Bonne pratique : Exécutez des vérifications de chemin TCP géo-distribuées pour détecter précocement des problèmes de routage ou de congestion. Le réseau mondial de monitoring de Dotcom-Monitor facilite l’identification d’anomalies régionales avant qu’elles n’affectent les utilisateurs.

3. Parité de protocole (monitoring IPv4 et IPv6)

De nombreuses organisations prennent désormais en charge à la fois IPv4 et IPv6, mais des incidents réels peuvent n’affecter qu’un seul protocole. Si vous testez uniquement IPv4, vous pourriez manquer des problèmes visibles par les utilisateurs sur les réseaux IPv6.

Bonne pratique : Incluez toujours les deux protocoles dans votre configuration de monitoring. Avec Dotcom-Monitor, vous pouvez exécuter des vérifications dual-stack pour assurer la cohérence et détecter des problèmes de parité entre types de connexion.

Pourquoi le monitoring TCP est important

Les vérifications DNS ou HTTP et le monitoring TCP valident que vos serveurs sont prêts à accepter du trafic réel — pas seulement allumés. Si le TCP échoue, cela signifie que la résolution DNS a fonctionné, mais que la connexion réseau n’a pas pu être établie.

Cet insight aide votre équipe à prioriser les incidents instantanément :

- DNS OK → concentrez-vous sur le serveur, le pare-feu ou le load balancer.

- Pas besoin d’escalader inutilement vers les développeurs ou les équipes applicatives.

En implémentant un monitoring TCP en couches, les organisations gagnent en rapidité de réponse aux incidents, en réduction du downtime et en fiabilité réseau accrue.

Erreurs TLS/SSL

Dans le paysage web actuel, HTTPS n’est plus optionnel — c’est la norme. Après le handshake TCP, un navigateur et un serveur web initient une session TLS (Transport Layer Security) pour sécuriser la connexion.

Le TLS remplit deux fonctions critiques :

- Chiffrement : Il protège toutes les données transmises entre le navigateur et le serveur contre l’interception.

- Authentification : Il vérifie que le serveur est légitime en validant son certificat numérique.

Sans TLS, les utilisateurs s’exposent à des risques importants de sécurité et de confidentialité. Mais même avec TLS, des mauvaises configurations ou des certificats expirés peuvent provoquer de graves incidents.

Quand le TLS échoue, les utilisateurs voient des avertissements effrayants du navigateur comme « Votre connexion n’est pas privée » ou « Le certificat de ce site est invalide. » Ces messages érodent immédiatement la confiance — et, dans bien des cas, empêchent l’utilisateur d’aller plus loin.

C’est pourquoi le monitoring TLS/SSL est essentiel pour préserver à la fois la disponibilité et la crédibilité. Un seul certificat expiré peut mettre votre site hors service et nuire à votre réputation du jour au lendemain.

Pourquoi les erreurs TLS/SSL surviennent

Les problèmes TLS proviennent souvent de mauvaises configurations ou d’oublis de renouvellement. Les causes courantes incluent :

- Certificats expirés – des certificats non renouvelés avant expiration déclenchent immédiatement des erreurs de sécurité qui bloquent l’accès.

- Non-correspondance de hostname – survient lorsqu’un certificat a été émis pour un domaine (par ex. www.example.com) mais est utilisé sur un autre (par ex. api.example.com).

- Autorité de certification (CA) non fiable — les navigateurs ne reconnaissent pas la CA si le certificat est autosigné ou chaîné à une racine privée non installée sur l’appareil client.

- Échecs de handshake — la négociation cryptographique entre client et serveur échoue, souvent à cause de suites de chiffrement non supportées, de versions de protocole obsolètes ou de chaînes de certificats incomplètes.

Chacune de ces erreurs affecte la confiance et l’accessibilité des utilisateurs, d’où la nécessité d’un monitoring TLS continu pour une détection précoce.

Comment surveiller TLS/SSL efficacement

Les certificats TLS ne tombent pas en panne progressivement ; ils fonctionnent parfaitement un jour et bloquent l’accès le lendemain. La meilleure approche de surveillance est proactive et automatisée.

Voici comment implémenter un monitoring TLS fiable :

1. Suivre la validité des certificats

Surveillez la date d’expiration de tous les certificats SSL/TLS pour vos domaines et sous-domaines. Configurez plusieurs seuils d’alerte (par ex. 30, 7 et 1 jour avant expiration) pour garantir que le renouvellement ait lieu à temps.

2. Valider la chaîne complète de certificats

Des chaînes de certificats incomplètes ou mal configurées peuvent casser la confiance même si le certificat principal est valide. Testez régulièrement les chaînes depuis différentes régions pour détecter les problèmes avec les CA ou les certificats intermédiaires avant que les utilisateurs ne les rencontrent.

3. Vérifier la compatibilité des protocoles et des suites de chiffrement

Au fur et à mesure que les navigateurs abandonnent des protocoles plus anciens (comme TLS 1.0/1.1) et des suites faibles, maintenir la compatibilité devient critique. Les outils de monitoring doivent valider les suites de chiffrement et les versions de protocole supportées pour s’assurer que les utilisateurs ne sont pas exclus.

4. Surveiller les échecs de handshake

Une augmentation soudaine des erreurs de handshake TLS indique souvent des load balancers mal configurés, des intermédiaires expirés ou des problèmes au niveau réseau.

Pourquoi le monitoring TLS est important

Les erreurs TLS ne sont pas que des problèmes techniques ; elles sont critiques pour l’activité. Elles impactent directement la confiance des utilisateurs, la perception de la marque et les taux de conversion.

Quand votre monitoring TLS vous alerte tôt sur des problèmes de certificat ou de handshake, votre équipe peut agir rapidement avant que ces incidents n’atteignent les utilisateurs.

Erreurs TLS/SSL courantes

Les erreurs TLS (Transport Layer Security) et SSL (Secure Sockets Layer) figurent parmi les problèmes les plus visibles et dommageables pour la réputation qu’un site peut rencontrer. Lorsqu’elles surviennent, les utilisateurs reçoivent des avertissements du navigateur comme « Votre connexion n’est pas privée » ou « Le certificat de sécurité de ce site a expiré. » Ces alertes brisent immédiatement la confiance et peuvent empêcher les visites.

Voici les erreurs TLS/SSL les plus courantes, leurs causes et pourquoi la surveillance continue est essentielle pour les prévenir.

Certificat expiré

Un certificat SSL expiré est une des principales causes d’indisponibilité HTTPS. Les certificats sont émis pour une période limitée (généralement 90 jours à un an). S’ils ne sont pas renouvelés avant l’expiration, les navigateurs signaleront le site comme non sécurisé et bloqueront l’accès.

Pourquoi cela arrive :

- Échec d’automatiser les renouvellements

- La rénovation du certificat n’a pas été propagée à tous les serveurs

- Load balancers mal configurés ou problèmes de cache

Non-correspondance de hostname

Une non-correspondance de hostname se produit lorsque le nom de domaine dans le certificat ne correspond pas à l’URL visitée par l’utilisateur. Par exemple, un certificat émis pour www.example.com ne sera pas valide si l’utilisateur visite api.example.com.

Pourquoi cela arrive :

- Ajout de nouveaux sous-domaines après l’émission du certificat

- Déplacement de services derrière une CDN ou un proxy sans réémettre de certificats

- Configuration SAN (Subject Alternative Name) incorrecte

Autorité de certification (CA) non fiable

Si l’autorité de certification (CA) n’est pas reconnue ou approuvée par le navigateur, les utilisateurs verront un avertissement « certificat non fiable ». Cela arrive lorsque le certificat est autosigné, émis par une CA interne, ou chaîné à un intermédiaire absent ou obsolète.

Pourquoi cela arrive :

- Utilisation de certificats autosignés en production

- Racines privées non installées sur les appareils clients

- Intermédiaires manquants ou invalides

Échec de handshake

Un échec de handshake TLS survient lorsque le navigateur et le serveur ne peuvent pas se mettre d’accord sur la façon d’établir une connexion sécurisée. Le processus de handshake garantit que les deux parties prennent en charge les mêmes protocoles et suites de chiffrement.

Pourquoi cela arrive :

- Suites de chiffrement obsolètes ou non supportées

- Utilisation de versions TLS anciennes (comme 1.0 ou 1.1)

- Configuration incorrecte de la chaîne de certificats ou intermédiaires manquants

Assurez-vous que votre site ne rate jamais un handshake TLS à nouveau

Avec le monitoring TLS/SSL de Dotcom-Monitor, vous pouvez détecter automatiquement les erreurs de certificat, les problèmes de handshake et les SSL expirés avant qu’ils n’impactent vos utilisateurs ou votre réputation.

Comment surveiller le TLS

Le monitoring TLS (Transport Layer Security) doit être proactif, automatisé et continu. Les certificats expirent sans avertissement, et quand cela arrive, les utilisateurs voient immédiatement des erreurs dans le navigateur. Voilà pourquoi les pratiques clés de monitoring TLS incluent :

Suivre la validité et l’expiration des certificats

Les certificats expirent sans avertissement et, lorsqu’ils le font, les utilisateurs voient des erreurs qui bloquent l’accès. Pour éviter cela, surveillez continuellement les dates d’expiration et configurez des alertes anticipées — idéalement à 30 jours, 7 jours et 1 jour avant l’échéance.

Valider la chaîne complète de certificats

Un certificat valide n’est fiable que si sa chaîne de confiance est complète. Même si le certificat leaf est valable, l’absence d’intermédiaires peut casser la confiance dans certains navigateurs ou régions.

Validez régulièrement la chaîne complète depuis plusieurs localités pour détecter tôt les incohérences régionales.

Vérifier la compatibilité des protocoles et des suites

Les navigateurs mettent souvent hors service des protocoles anciens (comme TLS 1.0 et 1.1) et des suites faibles. Si votre serveur repose encore sur des configurations obsolètes, des utilisateurs pourraient être incapables de se connecter de manière sécurisée.

Surveiller les échecs de handshake et la latence

Les handshakes TLS sont la base de la communication chiffrée. Quand ils échouent ou prennent trop de temps, les utilisateurs subissent des retards, des timeouts ou des erreurs de connexion.

Des pics d’erreurs de handshake renvoient souvent à des load balancers mal configurés, des intermédiaires expirés ou des déploiements CDN récents.

Automatiser la gestion des certificats

La meilleure façon de prévenir les pannes liées aux certificats est l’automatisation. Traitez les certificats comme du code : renouvelez-les automatiquement, déployez les mises à jour de façon cohérente entre les environnements et surveillez l’expiration avec la même rigueur que l’utilisation du disque ou du CPU.

Erreurs HTTP

Après que DNS, TCP et TLS ont correctement rempli leurs rôles, le navigateur envoie enfin une requête HTTP au serveur web. Le serveur répond alors avec un code d’état HTTP 200 OK lorsque tout fonctionne normalement, ou avec un code d’erreur lorsque quelque chose ne va pas.

La surveillance de ces réponses HTTP est souvent ce à quoi pensent les gens quand ils évoquent le monitoring de disponibilité. Cependant, surveiller uniquement le HTTP n’est qu’un aspect du monitoring de disponibilité. Sans le contexte des couches précédentes (DNS, TCP et TLS), le monitoring HTTP peut révéler ce qui a échoué, mais pas pourquoi. C’est pourquoi un monitoring applicatif avancé doit aller au-delà de la simple disponibilité et examiner les performances, les codes de réponse et l’intégrité des transactions.

Erreurs HTTP courantes

Voici quelques problèmes HTTP fréquents qui affectent la disponibilité et l’expérience utilisateur :

- 404 Not Found : La page ou la ressource demandée n’existe pas. Cela peut être causé par des liens cassés, des pages supprimées ou un routage incorrect.

- 500 Internal Server Error : Le serveur a rencontré une condition inattendue — souvent due à des bugs dans le code applicatif, des configurations erronées ou des processus surchargés.

- 502 Bad Gateway : Un proxy ou un load balancer a reçu une réponse invalide d’un serveur en amont. C’est courant dans des environnements distribués ou basés sur des microservices.

- 503 Service Unavailable : Le serveur est temporairement incapable de traiter les requêtes, généralement pour maintenance ou surcharges.

- 504 Gateway Timeout : Un service en amont a mis trop de temps à répondre, provoquant l’échec de la requête avant qu’une réponse ne soit renvoyée à l’utilisateur.

Chacune de ces erreurs affecte la confiance des utilisateurs et les conversions, et dans la plupart des cas, vos clients ne sauront pas (ou ne se soucieront pas) de la raison — ils partiront tout simplement.

Comment surveiller le HTTP

Un monitoring HTTP efficace va bien au-delà de vérifier si votre page d’accueil se charge. Il doit vérifier les codes de réponse, les temps de réponse et les taux de réussite des transactions sur toutes les couches de l’expérience web.

Les bonnes pratiques clés incluent :

- Transactions synthétiques : Simulez des interactions réelles d’utilisateurs comme la connexion, l’ajout au panier ou la finalisation d’un achat pour garantir que les workflows complets fonctionnent.

- Suivi des codes de réponse : Capturez automatiquement et alertez sur toutes les réponses en dehors de la plage 200–299 afin de détecter rapidement des défaillances serveur ou applicatives.

- Seuils de performance : Surveillez les temps de réponse et la vitesse de chargement globalement. Même si un site est « en ligne », des performances lentes peuvent éloigner les utilisateurs.

- Emplacements de monitoring globaux : Exécutez des vérifications HTTP depuis plusieurs régions pour identifier latence, problèmes CDN ou goulets d’étranglement de routage affectant des audiences globales.

Pourquoi le monitoring HTTP compte

Surveiller le HTTP ne consiste pas seulement à confirmer la disponibilité ; il s’agit de comprendre la santé de l’application et l’expérience utilisateur. Un site qui répond lentement ou de façon incohérente vous coûte du trafic, des conversions et des positions SEO. En superposant le monitoring HTTP aux couches DNS, TCP et TLS, vous obtenez une visibilité complète sur l’origine des problèmes, qu’il s’agisse de votre code, de votre infrastructure ou d’une dépendance en amont.

Erreurs HTTP courantes

Lors de la surveillance de la disponibilité et des performances, les codes de réponse HTTP révèlent le résultat de chaque requête utilisateur. Comprendre ces erreurs courantes aide à déterminer si les problèmes se situent dans votre application, votre serveur ou dans des dépendances upstream.

- 404 Not Found : Indique que la ressource demandée n’existe pas. Cela résulte typiquement de liens cassés, de contenu supprimé ou d’un routage incorrect. Un monitoring HTTP régulier aide à détecter ces erreurs tôt pour préserver le SEO et la confiance des utilisateurs.

- 500 Internal Server Error : Une défaillance générique côté serveur, souvent causée par des bugs applicatifs, des mauvaises configurations serveur ou des processus backend surchargés. Le monitoring des logs de réponse HTTP peut rapidement identifier des 500 récurrents avant qu’ils n’impactent les utilisateurs.

- 502 Bad Gateway : Se produit lorsqu’un proxy, CDN ou load balancer reçoit une réponse invalide d’un serveur upstream. Fréquent dans des architectures distribuées ou microservices où un composant échoue à communiquer correctement avec un autre.

- 503 Service Unavailable : Signale que le serveur est temporairement incapable de traiter les requêtes, généralement à cause de maintenance programmée, d’un épuisement de ressources ou de pics de trafic. Un monitoring proactif aide les équipes à identifier et atténuer les conditions de surcharge avant que le downtime ne se propage.

- 504 Gateway Timeout : Arrive lorsqu’un serveur upstream met trop de temps à répondre, faisant expirer la requête au niveau du gateway/proxy. Cela peut indiquer de la latence, des goulots d’étranglement en base de données ou des ralentissements dans des dépendances de la stack applicative.

Rassembler le tout : une stratégie de monitoring en couches

La surveillance moderne d’un site ne consiste pas seulement à détecter une indisponibilité — il s’agit de comprendre pourquoi un site est hors service et quelle couche a causé la défaillance. Chaque étape de la séquence de connexion — DNS, TCP, TLS et HTTP — joue un rôle distinct et chacune peut tomber indépendamment.

Toute panne se produit dans un ordre :

- Si le DNS échoue, aucune connexion ne peut être établie.

- Si le TCP échoue, la résolution DNS fonctionne, mais le handshake réseau ne se fait pas.

- Si le TLS échoue, la configuration de chiffrement ou la validation du certificat est rompue.

- Si le HTTP échoue, toutes les couches précédentes ont réussi — ce qui signifie que le problème se situe dans l’application ou le serveur.

Cette approche en couches fournit clarté et précision dans le diagnostic des problèmes de performance et de disponibilité web.

Les quatre couches d’un monitoring d’erreur complet

- Commencez par des contrôles DNS : Vérifiez que les domaines se résolvent correctement depuis plusieurs emplacements globaux.

- Ajoutez le monitoring de connexion TCP : Confirmez que les serveurs acceptent et répondent aux requêtes de connexion.

- Superposez le monitoring des certificats TLS : Suivez la validité des SSL, les performances de handshake et la chaîne de confiance.

- Terminez par le monitoring des réponses HTTP : Mesurez la disponibilité réelle, la latence et les codes de réponse.

Analyse de cause racine plus rapide

En alignant le monitoring sur ces couches, votre équipe peut identifier le point exact de défaillance — et le bon propriétaire pour le corriger :

- Erreur DNS ? Contactez votre fournisseur d’hébergement DNS.

- Erreur TCP ? Escaladez vers votre fournisseur réseau ou d’hébergement.

- Erreur TLS ? Vérifiez la validité du certificat ou les configurations en edge.

- Erreur HTTP ? Alertez votre équipe d’application ou DevOps.

Plutôt que de recevoir un vague avertissement « le site est hors service », vous obtenez des informations exploitables qui réduisent le MTTR et éliminent les approximations entre équipes.

Conclusion

Les sites ne tombent pas simplement ; ils tombent en couches. Chaque panne commence à un point spécifique de la chaîne de connexion : DNS, TCP, TLS ou HTTP. Chaque couche introduit ses propres risques, comportements et signatures de défaillance.

En adoptant le monitoring par type d’erreur, vous transformez la complexité en clarté, convertissant un avertissement générique « site hors service » en informations précises et exploitables.

Avec une stratégie robuste de surveillance de site alimentée par des outils comme Dotcom-Monitor, vous gagnez plus que des données de disponibilité ; vous gagnez de la compréhension. Vous saurez pourquoi votre site est hors service, quelle couche l’a causé et qui doit le réparer — qu’il s’agisse d’une action auprès du registrar, d’un timeout chez l’hébergeur ou d’une expiration de certificat.

En définitive, le monitoring basé sur les erreurs ne consiste pas seulement à maintenir le site en ligne ; il s’agit de responsabilité, visibilité et rapidité. La prochaine fois que votre site rencontrera un problème, ne vous contentez pas de l’incertitude. Sachez exactement ce qui a cassé, pourquoi ça a cassé et comment le résoudre avec confiance et clarté.

Prêt à surveiller votre site de façon intelligente ?

Détectez les problèmes DNS, TCP, TLS et HTTP avant vos utilisateurs.

Foire aux questions

Surveiller les erreurs d'un site Web par type consiste à suivre et analyser les défaillances d'un site Web en fonction de la couche spécifique du processus de connexion : DNS, TCP, TLS ou HTTP. Chaque type d'erreur révèle une cause profonde différente :

- Les erreurs DNS signalent des problèmes de résolution de nom de domaine.

- Les erreurs TCP indiquent des connexions réseau défaillantes ou lentes.

- Les erreurs TLS/SSL indiquent des problèmes de certificat ou de cryptage.

- Les erreurs HTTP mettent en évidence des défaillances du serveur web ou de l'application.

En utilisant des outils de surveillance de sites web multicouches tels que Dotcom-Monitor, les équipes peuvent détecter où et pourquoi les temps d'arrêt se produisent, améliorant ainsi la disponibilité, les performances et la fiabilité des sites web tout en réduisant le temps de dépannage.

La surveillance multicouche des sites Web est essentielle, car les sites Web ne tombent pas en panne pour une seule raison : ils échouent à différents niveaux de la pile Internet. Les contrôles de disponibilité traditionnels vous indiquent uniquement si un site est « en ligne » ou « hors ligne », mais pas pourquoi.

La surveillance multicouche sur les protocoles DNS, TCP, TLS et HTTP offre une visibilité complète :

- Si le DNS tombe en panne, votre domaine est introuvable.

- Si le TCP tombe en panne, la connexion réseau est interrompue.

- Si le TLS tombe en panne, les utilisateurs sont confrontés à des erreurs de certificat SSL et à des avertissements du navigateur.

- Si le protocole HTTP tombe en panne, votre application Web ou votre serveur fonctionne mal.

Cette approche garantit une analyse plus rapide des causes profondes, une meilleure surveillance du temps de disponibilité et une meilleure expérience utilisateur, autant d'éléments essentiels pour les sites Web critiques pour l'entreprise.

Dotcom-Monitor fournit des outils avancés de surveillance des performances et de la disponibilité des sites Web qui reproduisent les interactions réelles des utilisateurs à partir de plusieurs emplacements dans le monde. Il teste en permanence chaque couche de la connexion pour garantir sa fiabilité :

- Surveillance DNS : vérifie la vitesse et la disponibilité de la résolution des domaines à l'échelle mondiale.

- Surveillance TCP : vérifie la réussite des handshakes et détecte les problèmes de connectivité.

- Surveillance TLS/SSL : suit la validité des certificats SSL, leur expiration et la force du cryptage.

- Surveillance HTTP : mesure la disponibilité, la vitesse des pages et les codes de réponse d'erreur.

Grâce à des alertes en temps réel et des diagnostics visuels, Dotcom-Monitor permet aux équipes informatiques et DevOps d'identifier la cause exacte des temps d'arrêt, qu'il s'agisse d'un délai d'expiration DNS, d'un problème de connexion TCP, d'un échec de connexion TLS ou d'une erreur HTTP 500, et de le résoudre avant qu'il n'ait un impact sur les utilisateurs ou le classement SEO.