APIモニタリングとは、APIエンドポイントの可用性、応答時間、およびデータの正確性を継続的かつ自動的に検証する作業です。これは、エンドポイントが応答するだけでなく、ユーザーおよび依存システムの視点から、適切な形式で適切なデータを許容可能な遅延内で返すことを確認することを意味します。

APIは現代ソフトウェアの結合組織です。ユーザーがログインしたり、支払いを送信したり、リアルタイム通知を受け取るたびに、複数のAPIコールが裏で実行されます。これらはしばしばマイクロサービス、クラウドプロバイダー、およびサードパーティベンダーを横断します。これらの呼び出しが失敗したり遅延したりすると、その影響は即座に現れます:購入手続きの失敗、ユーザーのロックアウト、収益の損失などです。

しかし、多くのチームは顧客からの報告があるまでAPIの障害に気づきません。積極的なモニタリングがなければ、障害と調査までのタイムラグは通常数十分に及びます。それは、本当に通報が入る前に収益やSLAリスクが露呈するのに十分な時間です。

このガイドは、APIモニタリングとは何か、その仕組み、追跡すべき指標、APIテストやAPMとの違い、そして実装方法を説明します。これはDevOpsエンジニア、SRE、QAチームが生産環境の判断を下すために必要な精度を持っています。

APIモニタリングとは何ですか?

APIモニタリングは、以下の3つの異なる検証レイヤーを含み、具体性の高い順に並んでいます:

- 可用性モニタリング — エンドポイントに到達可能ですか?タイムアウトなしにHTTP応答を返しますか?

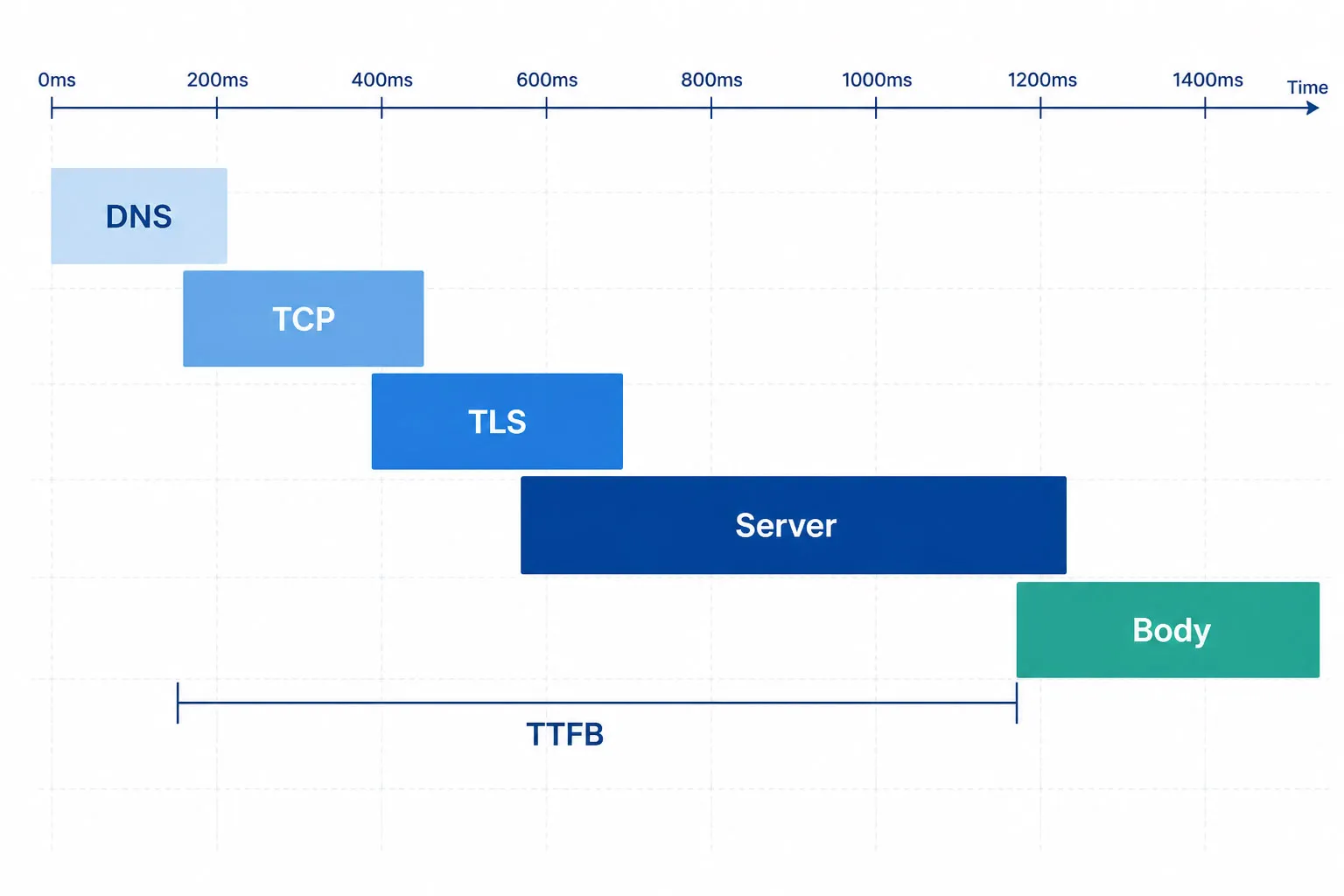

- パフォーマンスモニタリング — 応答にどれくらい時間がかかりますか?TTFB、DNS解決、TLSハンドシェイクは遅延を引き起こしていますか?

- ペイロード検証 — 応答ボディは期待されるデータ構造を含んでいますか?JSONPathまたはXPathの検証は成功していますか?

APIエンドポイントとは何ですか?

アプリケーションプログラミングインターフェース(API)とは、ソフトウェアシステムが通信するためのプロトコルと定義のセットです。APIエンドポイントとは、APIがリクエストを受け取る特定のURLのことです。およびレスポンスを返す — API監視の観察単位。例えば:

POST /v2/auth/token— トークン発行エンドポイントGET /v2/orders/{id}— 注文取得エンドポイントPOST /v2/payments/charge— 支払い処理エンドポイント

モダンなアプリケーションは、内部マイクロサービス、サードパーティの決済ゲートウェイ、アイデンティティプロバイダー、配送API、CRMシステムなど、同時に何十または何百ものエンドポイントに依存しています。API監視はそれらすべての可視性を維持します。

API監視の種類

すべてのAPI監視が同じというわけではありません。カテゴリーを理解することで、チームはアーキテクチャとビジネス要件の両方に合致するカバレッジを構築できます。5つのコアタイプはほぼすべてのチームに該当し、条件が合う場合には専門的なタイプも重要です。

コアタイプ

| タイプ | 検証内容 | 最適利用 |

|---|---|---|

| 稼働時間監視 | エンドポイントの到達性;HTTPレスポンスコード;タイムアウト内のレスポンス | 基本的な可用性SLA;即時の障害検知 |

| パフォーマンス監視 | レスポンス時間、TTFB、DNS解決、TCPハンドシェイク、TLS時間、スループット | レイテンシSLA、P95/P99目標、キャパシティプランニング |

| ペイロード/バリデーション監視 | JSONPath/XPathアサーションによるレスポンスボディ;スキーマの正確性;フィールド値 | HTTP 200 ≠ 正しいデータの静かな故障検出 |

| シンセティック監視 | スケジュールされた間隔でのグローバルロケーションからの模擬APIコール;実際のトラフィックに依存しない | 事前検出;地理的カバレッジ;ゼロトラフィック期間 |

| マルチステップトランザクション監視 | 連鎖したAPIコールシーケンス(例:認証 → クエリ → 送信 → 確認);ステップ間のデータ受け渡し | ECフロー、ログインジャーニー、注文ワークフロー |

専門的タイプ

| タイプ | 検証内容 | 最適利用 |

|---|---|---|

| セキュリティ監視 | 認証失敗、異常なリクエストパターン、証明書の期限切れ、レートリミットの乱用、トークンのリプレイ | FinTech、ヘルスケア;PII/PHIを扱うAPI |

| コンプライアンス関連チェック | TLSバージョン/暗号の検証、証明書期限、セキュリティヘッダーの有無、認証強制テスト | ヘルスケア、金融サービス、規制産業 |

| リアルユーザーモニタリング(RUM) | 実際のユーザーAPIインタラクション;フルセッションの可視化;実際の地理的およびデバイスの多様性 | >真のユーザー影響の理解;合成的な調査結果の検証 |

| バージョニング&非推奨モニタリング | APIバージョン採用率;バージョン変更後のエラースパイク;後方互換性 | 複数APIバージョンを同時に管理するチーム |

| サードパーティ/統合モニタリング | 外部API依存(Stripe、Okta、Salesforce、Twilio);外部障害と内部障害の切り分け | 重要なワークフローにサードパーティAPIを利用するあらゆるアプリ |

コンプライアンス関連チェックについての注意:これらは特定の技術的コントロールの裏付け証拠を提供します。フレームワークのコンプライアンス(HIPAA、PCI DSS、SOC 2)は、モニタリングだけでは達成できないより広範な組織ガバナンスを要求します。

合成モニタリング vs. リアルユーザーモニタリング(RUM)

両アプローチはAPIパフォーマンスデータを提供しますが、根本的に異なる視点からのものです:

| 合成モニタリング | リアルユーザーモニタリング(RUM) | |

|---|---|---|

| トリガー | スケジュールに基づくスクリプト化されたチェック(例:毎分) | 本番環境での実際のユーザーリクエスト |

| カバレッジ | 24時間365日実行 ─ 実際のユーザーがゼロの時も含む | ユーザーが積極的にリクエストを送信している時のみデータ生成 |

| 検出 | プロアクティブ ─ ユーザーに影響が出る前に障害を検知 | リアクティブ ─ ユーザーに影響が出た後に問題を表面化 |

| スコープ | パブリックおよびプライベート/内部API(プライベートエージェント経由) | リアルユーザー/クライアントが到達するAPI ─ 主に公開向けだが、エンタープライズRUMでは計測対象アプリからの内部API呼び出しもキャプチャ可能 |

| ユースケース | 継続的な可用性とパフォーマンスの検証 | 真の影響範囲と実際のユーザー体験の理解 |

主要なAPI監視指標

適切な指標を追跡することは、情報に基づいたインシデント対応とアラート疲労の違いを生みます。以下は最も重要な指標であり、正確なベンチマークとそれぞれが示す内容です。

| 指標 | 目標 / ベンチマーク | 検出可能な問題 |

|---|---|---|

| 可用性(稼働率 %) | ≥ 99.9%(三つの9);収益に直結するAPIは99.99% | 完全な停止、部分停止、タイムアウト |

| 総応答時間 | 単純なエンドポイントは< 200ms;複雑な操作は< 1秒 | サーバーの遅延、過負荷、デプロイによる回帰 |

| 初回バイトまでの時間(TTFB) | 理想は< 100ms;許容は< 300ms | レスポンス開始前のサーバー処理遅延 |

| P95 / P99 応答時間 | エンドポイントごとに基準値P95の2倍でアラート;エンドポイントの動作に合わせて調整 | 最も遅い1〜5%のリクエストに影響する末尾遅延 |

| エラー率(4xx / 5xx) | 本番APIは< 0.1% | 認証失敗、不正入力処理、サーバーエラー |

| DNS解決時間 | 同一リージョンのキャッシュ付き検索は< 50ms;リージョン間は100msを超えることも | DNS伝播問題、リゾルバー障害 |

| TLSハンドシェイク時間 | < 100ms | 証明書の設定ミス、TLSバージョン交渉の問題 |

| ペイロードアサーション合格率 | 100%(失敗時にアラート) | 静かな失敗:誤ったまたは欠落データを含むHTTP 200レスポンス |

| スループット(req/sec) | 過去の基準値と比較 | 予期しないトラフィックの減少や異常な急増 |

| 証明書の有効期限(日数残り) | 30日でアラート;7日で重大警告 | TLS証明書の期限切れが近い |

応答時間のベンチマーク

API監視はどのように機能するのか?

技術的な仕組みを理解することで、チームは監視を正しく設定し、結果を正確に解釈できます。

コア監視ループ

- スケジュール設定。 選択されたグローバル監視地点から、設定された間隔(例:1分ごと)で合成チェックを実行します。

- リクエスト送信。 監視エージェントがHTTPメソッド(GET、POST、PUT、PATCH、DELETE)、リクエストヘッダー、認証情報、リクエストボディを含むHTTPリクエストをターゲットエンドポイントに送信します。

- タイミング測定。 エージェントはDNS解決時間、TCP接続時間、TLSハンドシェイク時間、最初のバイトまでの時間(TTFB)、および合計応答時間を個別の要素として記録します。

- アサート。 応答は、設定されたアサーション(HTTPステータスコード、応答時間閾値、応答ヘッダー、JSONPath(REST)またはXPath(SOAP)によるペイロード内容)に対して評価されます。

- アラートまたはパス判定。 いずれかのアサーションが失敗するか、リクエストのタイムアウトが発生した場合、インシデントが作成され、設定された通知ルールに従ってアラートが送信されます。

- 記録。 合格・不合格のすべての結果は、タイムスタンプ、応答データ、アサーション結果とともに保存され、過去の傾向分析やSLAレポートに使用されます。

マルチステップAPIトランザクション監視

単一エンドポイントの監視は、個々のエンドポイントが応答することを確認します。しかし実際のユーザージャーニーは単一のAPI呼び出しではなく、それぞれのステップが前のステップの出力に依存する連鎖したシーケンスです。

eコマースのチェックアウトフローを考えてみましょう:

- ステップ1 —

POST /auth/token:ユーザーを認証し、レスポンスボディからaccess_tokenを抽出 - ステップ2 —

GET /products/{id}:商品詳細を取得し、Authorizationヘッダーにトークンを注入 - ステップ3 —

POST /cart/add:アイテムを追加し、レスポンスからcart_idを抽出 - ステップ4 —

POST /checkout/initiate:cart_idを使ってチェックアウトを開始し、checkout_session_idを抽出 - ステップ5 —

POST /payments/charge:支払いを処理し、レスポンスフィールドorder_statusが'confirmed'であることを検証

単一エンドポイント監視では、5つのステップそれぞれが個別には成功しても、完全な取引は失敗することがあります。なぜならセッションデータがステップ間で正しく渡されなかったり、トークンが処理途中で失効したり、支払いAPIがHTTP 200を返してもペイロードにエラーが含まれていることがあるためです。マルチステップ監視は、全体の連鎖を1つのモニターとして実行し、各ステップを独立して検証するとともに、ステップ間で動的な値(トークン、セッションID、注文ID)を自動的に受け渡します。

Dotcom-Monitorは、一連のAPI呼び出しを単一の監視タスクで連鎖させることで、マルチステップトランザクション監視を実現します。各ステップ間の変数抽出や注入は自動化されており、各ステップは独立して検証されるため、取引が失敗した正確なステップを特定できます。

ペイロード検証:JSONPathおよびXPathアサーション

ペイロード検証は、単なる可用性の確認から監視を区別するものであり、アサーションの表現方法はツールによって異なりますが、論理は一貫しています:

- JSONPathフィールドアクセス (REST):

$.data.statusにアクセスし、返された値が'active'に等しいことを検証 - JSONPath配列チェック:

$.itemsにアクセスし、配列の長さが0より大きいことを検証 - XPathアサーション (SOAP):

//order/status/text()にアクセスし、ノード値が'confirmed'に等しいことを検証 - ヘッダーアサーション:

Content-Typeヘッダー値が'application/json'に等しいことを検証 - レスポンスタイムアサーション: 合計レスポンス時間が500ms未満であることを検証

認証モニタリング

プロダクションAPIには認証が必要です。モニタリングツールは実際のAPIクライアントと同じ認証方法を扱う必要があります。プロダクション対応のモニタリングプラットフォームがサポートすべきスキーム:

| 認証方法 | 説明 | 備考 |

|---|---|---|

| OAuth 2.0 — クライアント認証情報 | マシン間通信;クライアントが直接トークンと認証情報を交換 | サーバー間APIモニタリングで最も一般的 |

| OAuth 2.0 — 認可コード | ユーザー代理認可;通常、SPAやモバイルアプリ向けにPKCEと共に使用 | モニタリングツールがトークンリフレッシュを自動で処理する必要あり |

| OAuth 2.0 — リソースオーナーパスワード(ROPC) | 直接のユーザー名+パスワード交換 — レガシーフロー | 認可コードが利用不可能な場合のみ使用 |

| ベアラートークン(JWT) | Authorizationヘッダー内の静的または動的にリフレッシュされるトークン |

短命のJWTは自動トークンリフレッシュが必要 |

| APIキー | ヘッダー、クエリパラメーター、またはクッキー内の静的キー | モニタリングが最も簡単;ローテーションイベントに注意 |

| ベーシック認証 | Authorizationヘッダー内のBase64エンコードされたusername:password |

レガシー;企業内および内部APIで今でも一般的 |

| AWS Signature v4 | AWS認証情報を用いたHMAC署名付きリクエスト | AWS API Gatewayエンドポイントに必須 |

| mTLS / クライアント証明書 | 相互TLS — 両側が証明書を提示 | ゼロトラスト環境;証明書の有効期限モニタリングが重要 |

| NTLM / Kerberos | Windows / Active Directory統合認証 | 企業内部API;クラウドネイティブスタックではあまり一般的でない |

| カスタムヘッダー | カスタムリクエストヘッダーを使った独自認証スキーム | 非標準認証実装のキャッチオール |

トークンの有効期限切れはモニタリングの誤検知の主要な原因です。OAuth 2.0のアクセストークンの有効期限は実装や付与タイプによって大きく異なります。ユーザー代理のトークン(認可コードフロー)は通常15分から1時間の範囲です。マシン間トークン(クライアント認証情報フロー)はリフレッシュの負荷を減らすために、1時間から24時間の長い設定が多いです。高セキュリティ環境では最短5分の有効期限を強制する場合もあります。ウィンドウに関係なく、モニタ…自動トークンリフレッシュを処理しないツールは、誤検知を発生させるか、手動での認証情報ローテーションを必要とし、運用負荷と障害リスクの両方を生み出します。

OAuth 2.0 インプリシットグラントについての注意:これは現在のOAuth 2.0セキュリティベストプラクティス(RFC 9700)では非推奨であり、新しいシステムでは使用すべきではありません。既存のAPIがインプリシットフローを使用している場合は、Authorization Code + PKCEへの移行を強く推奨します。

APIモニタリングが重要な理由:ビジネスへの影響

APIはインフラ抽象化ではなく、収益経路です。APIが故障すると、財務的、運用的、契約的な影響があります。

検出されないAPI障害のコスト

積極的な監視なしでは、チームは顧客の報告に依存して障害検出を行います。業界調査では、顧客報告によるMTTDは一貫して30分以上とされており、苦情が提出されて調査・振り分け・エスカレーションされる頃には、その時間が経過しています。1分間隔の連続合成監視は検出時間を60秒未満に短縮し、問題が悪化する前に根本原因の特定を可能にします。

収益の計算式はシンプルです:注文数/分 × 平均注文額 × 障害継続時間(分)。1分間に100件の注文処理、平均注文額50ドルのプラットフォームが5分間の決済API障害を起こした場合、潜在的な収益損失は2万5000ドルになります。ご自身のスループットと注文額を当てはめてリスクを評価してください。

業界別のシナリオ

- Eコマース. ピーク時間帯のチェックアウトAPI障害は全てのコンバージョンを停止させます。決済承認APIがHTTP 200を返しつつ却下ステータスになると、アラートなしで数分間取引が静かにブロックされることがあります。

- FinTech. トランザクション処理APIは1秒未満のレイテンシ要件を満たす必要があります。SLAを超える持続的な性能低下は契約上の罰則やPCI DSS監査上の指摘につながります。

- ヘルスケア. 電子健康記録(EHR)統合APIや遠隔医療エンドポイントはHIPAA準拠のデータ交換を維持しなければなりません。HTTP 200で不完全な患者データを返すAPIは、性能問題だけでなくコンプライアンスイベントです。

- SaaS / API-as-a-Product. APIを課金製品として提供する場合、ダウンタイムは契約上のSLA違反ペナルティや顧客離脱を引き起こします。監視はSLA遵守報告に必要な稼働証明を提供します。

- エンタープライズIT. 部門間でのCRM、ERP、HR API統合。Salesforce APIの劣化はログに500エラーが記録されなくても組織全体の営業ワークフローを密かに破壊することがあります。

サードパーティAPIのリスク

現代のアプリケーションは自身で管理していない外部APIに依存しています:決済ゲートウェイ(Stripe、PayPal、Braintree)、アイデンティティプロバイダー(Okta、Auth0、AWS Cognito)、shipping APIやCRMシステム。これらが劣化すると、インフラは正常でもアプリケーションがユーザーに壊れているように見えます。

サードパーティのエンドポイントを監視することで、障害が内部由来か外部由来かをすぐに特定できます。これには事前の監視データがなければかなりの調査時間を要します。また、公開されたSLAの遵守をベンダーに求めるための証拠としての記録も提供します。

APIの障害をお客様から知るのはもうやめましょう。

Dotcom-MonitorのシンセティックAPI監視は60秒以内に障害を検出し、PagerDuty、Slack、Microsoft Teamsに直接アラートを送信します。支払いゲートウェイ、IDプロバイダー、内部APIを1つのプラットフォームで監視可能です。

API監視とAPIテストの比較

どちらの方法もAPIの動作を検証しますが、ソフトウェア提供ライフサイクルにおいて異なる目的を果たします。混同するとカバレッジのギャップが生じます。

| 視点 | APIテスト | API監視 |

|---|---|---|

| タイミング | デプロイ前—開発、QA、CI/CDパイプライン | デプロイ後—本番環境で継続的に |

| 環境 | 開発、ステージング、制御されたテスト環境 | 本番環境、実際のインフラ、実際のトラフィック |

| トリガー | コードコミット、ビルド、手動実行、PRゲート | スケジュール(例:1分毎)、24時間365日継続的 |

| 目的 | バグの本番環境流出防止 | 本番環境での障害、劣化の検出 |

| カバレッジ | 全動作、エッジケース、エラーパス | 重要経路、SLAエンドポイント、ユーザージャーニーチェーン |

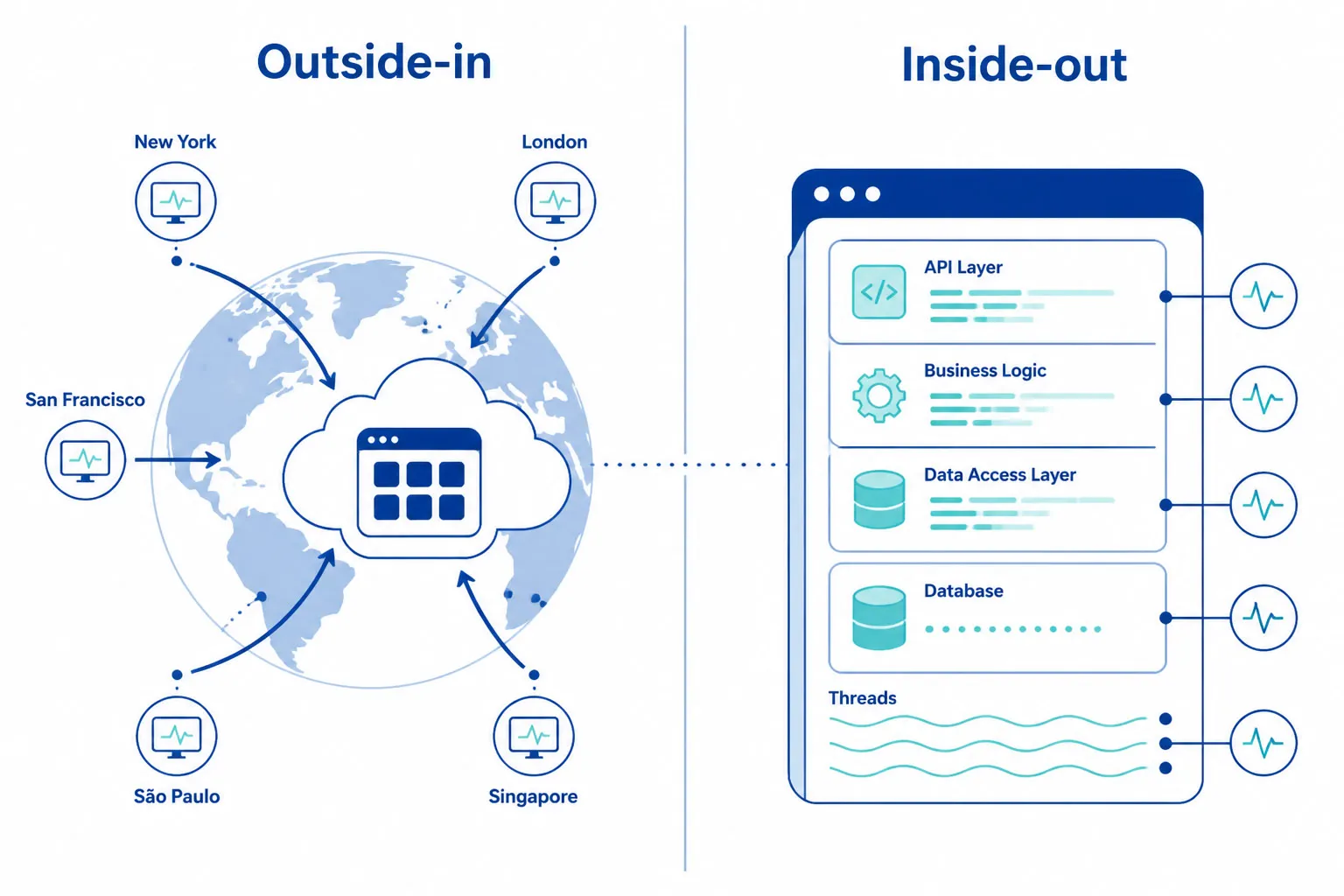

| 視点 | 内側から外側:コードの動作をテスト | 外側から内側:ユーザーの視点から検証 |

| 出力 | 合否レポート;失敗時はデプロイ停止 | リアルタイムアラート、稼働率SLA記録、インシデント履歴 |

実用的な関係:APIテストは開発フェーズの活動です。API監視は運用フェーズの活動です。テストはデプロイ前にバグを検出し、監視はデプロイ後に実際のインフラ条件下で障害、回帰、性能劣化、依存関係問題を検出します。

成熟したエンジニアリングチームは両方を実行し、Postman Collectionインポートを使用して両者を橋渡しし、開発テストを複製なしに本番監視に変換しています。

API監視とAPMの違い

これらの2つのカテゴリはしばしば混同されます。両者は補完的で、置き換え可能ではありません。

| 合成API監視 | APM(アプリケーションパフォーマンス監視) | |

|---|---|---|

| 視点 | 外部から内側へ — ユーザーやパートナーと同じ視点から検証 | 内側から外へ — アプリケーション内部の挙動を観察 |

| 見えるもの | DNS障害、ネットワークルーティング問題、TLSエラー、CDNの誤配信、地理的ギャップ | 遅いDBクエリ、メモリリーク、コード例外、遅い関数呼び出し |

| 稼働時間 | 24時間365日 — トラフィックがゼロの期間も含む | 実際のリクエスト処理時のみ |

| 答える質問 | 「お客様は現在このAPIを実際に呼び出せますか?」 | 「リクエストが入った際にアプリケーション内部で何が起きていますか?」 |

最もMTTR(平均修復時間)が低いチームは両方を使用しています。内部の根本原因分析にはAPMを使い、外部の検証には合成API監視を用います。ログとトレースは「コードで何が問題だったのか?」に答え、合成監視は「お客様は今このAPIを使えますか?」に答えます。

APIプロトコル:REST、SOAP、GraphQL、gRPC、およびWebSocket

各APIプロトコルは異なる監視要件と障害モードがあります。すべてのAPIを単純なHTTP GETリクエストとして扱う監視ツールは、プロトコル固有の問題を見逃します。

REST API監視

RESTは支配的なAPIプロトコルです。監視はHTTPメソッド(GET、POST、PUT、PATCH、DELETE)、ステータスコード、レスポンスヘッダー、およびJSONPathアサーションを使ったJSONレスポンスボディを検証します。主な要件は、ステータスコードだけでなくレスポンスペイロードのフィールド値に対してアサートすることです。また、すべてのHTTPメソッドを監視しなければなりません。GETだけではなく、POST、PUT、DELETEは異なるサーバーサイドロジックと障害を引き起こします。modes); エンドポイントごとに応答時間を個別に追跡し、エンドポイント全体の平均値として集約しません。

SOAP API モニタリング

SOAP API は HTTP 上で XML を交換します。モニタリング要件: エンドポイントおよびスキーマ定義のための WSDL インポート; XML レスポンス要素に対する XPath アサーション; SOAP 1.1 と SOAP 1.2 プロトコルのサポート; メッセージレベルのセキュリティを使用したエンタープライズ SOAP サービス向けの WS-Security 設定。

GraphQL API モニタリング

GraphQL の主要なモニタリングの課題: ほとんどの GraphQL サーバー実装 は部分的なエラーや不正なクエリに対しても HTTP 200 を返します。HTTP ステータスコードは信頼できる失敗シグナルではありません。以下を実施する必要があります:

- 特定のクエリペイロードを送信し、レスポンスの

dataオブジェクトをアサートする - レスポンスボディの

errors配列を確認する — 標準の GraphQL では、すべてのレスポンスにオプションのトップレベルerrorsフィールドがあり、成功時には空または存在しませんが、失敗時には値が入ります。errors[]が埋まった 200 レスポンスは、HTTP は成功しているものの GraphQL レイヤーでリクエストが失敗していることを意味します - クエリ固有のデータ不変条件を検証する: 期待されるフィールドが存在し、null でなく、正しい型であることを data オブジェクトでアサートする — 一部のシステムはトップレベルの errors 配列ではなく data オブジェクト内にドメインの失敗をエンコードします

- クエリの複雑度および深さ制限をモニターし、タイムアウトが発生する前にパフォーマンス低下を検出する

gRPC API モニタリング

gRPC はデフォルトで HTTP/2 上の Protocol Buffers を使用しますが、gRPC-Web はブラウザクライアント向けにプロキシ経由で HTTP/1.1 をサポートします。モニタリング要件: サービスおよびメソッド定義のための proto ファイルインポート; Protocol Buffer メッセージのバイナリエンコード/デコードのサポート; HTTP ステータスコードではなく gRPC ステータスコード(OK、UNAVAILABLE、DEADLINE_EXCEEDED など)によるステータスコード検証; Unary、Server-Streaming、Client-Streaming、および Bidirectional-Streaming RPC タイプのサポート。

WebSocket API モニタリング

WebSocket API はリアルタイムデータのための持続的な双方向接続を維持します。モニタリングでは接続確立時間と WebSocket ハンドシェイクの成功、メッセージ配信の遅延およびペイロードの正確性、接続の安定性(切断後の再接続動作を含む)を検証します。

パブリック API モニタリングと内部 API モニタリング

ほとんどのAPI監視ガイドはパブリック向けのエンドポイントにのみ焦点を当てています。しかしマイクロサービスアーキテクチャにおいて、重要なAPI呼び出しの大部分は内部であり、サービス間の呼び出しであってパブリックインターネットに到達することはありません。

| パブリックAPI監視 | 内部API監視 | |

|---|---|---|

| 対象範囲 | 顧客向けエンドポイント、パートナーAPI、サードパーティとの統合 | 内部マイクロサービス、プライベートVPC、ステージング環境、ファイアウォール内API |

| 動作方法 | グローバル拠点からパブリックインターネット経由で外部監視エージェントがチェックを実行 | ネットワーク内部に展開されたプライベートエージェントが監視プラットフォームへのアウトバウンド接続を開始 |

| ファイアウォール要件 | 不要 — チェックは外部から発生 | インバウンドルール不要 — エージェントはアウトバウンド接続のみ実行 |

| 検出内容 | DNS解決失敗、CDNルーティングの問題、TLSエラー、地域ごとの可用性の問題 | サービス間の障害、認証マイクロサービスの遅延、データベースクエリAPIの劣化 |

| 展開 | インストール不要 — 即時動作 | オンプレミスまたはプライベートクラウドにエージェントをインストール(WindowsおよびLinux対応) |

内部マイクロサービスAPIは連鎖的な障害の最も一般的な原因です。認証サービスの劣化やデータアクセスAPIの遅延は、フロントエンドの障害として表面化し、内部可視性なしでは根本原因の特定が困難になります。内部APIの監視によって、障害がAPIレイヤーなのか下流サービスなのかデータベースなのかをチームが切り分け可能になります。ファイアウォールの背後でのプライベートエージェント監視について詳しくご覧ください。

API監視のベストプラクティス

これらのプラクティスは平均検知時間(MTTD)を短縮し、アラートの精度を向上させ、監視カバレッジが本番環境のリスクに見合うものとなるようにします。

- 収益に直結するエンドポイントは1分間隔で監視すること。 支払い、認証、コアデータAPIの場合、見逃した1分間が直接的なビジネス影響を及ぼします。重要度が低いエンドポイントは5分または15分間隔でも許容されます。

- 少なくとも5か所の地理的に分散した地点からチェックを実行すること。 単一の監視地点では地域的なDNS障害、CDNの誤設定、地域特有のルーティング問題を検出できません。最低でも北米、ヨーロッパ、アジアをカバーしてください。Pacific.

- ステータスコードだけでなく、ペイロードの内容も検証する。 すべての重要なエンドポイントに対してJSONPathアサーションを設定します。最もコストのかかるサイレントな失敗は、HTTP 200を返しながら不完全、古くなった、または不正なデータを返すAPIです。

- 静的なミリ秒値ではなく、ベースラインから導出したアラート閾値を使用する。 エンドポイントごとにレスポンスタイムのベースラインを確立し、P95値の2倍でアラートを設定します。静的な閾値は通常のトラフィックピーク時に誤検知を引き起こします。

- 認証を監視チェーンに含める。 トークンの有効期限切れ、OAuthリフレッシュ失敗、証明書のローテーションはAPIの停止の主要原因です。認証ステップを監視することで、認証情報に関連する障害を連鎖的に発生する前に検出できます。

- すべての重要なユーザージャーニーに対して多段トランザクションモニターを作成する。 ログインフロー、チェックアウトシーケンス、データ送信ワークフローは連鎖するAPIコールです。単一エンドポイントのモニターでは、不正なデータの受け渡しやセッション処理による段階間の障害を検出できません。

- サードパーティAPI依存を別個のモニターとして監視する。 Stripe、Okta、Salesforceなどの外部依存に専用モニターを作成します。これにより障害が内部か外部か即座に判断できます。

- PostmanやInsomniaコレクションをインポートして監視の立ち上げを簡略化する. 既存のAPI定義を、リクエスト構造を再作成せずに24時間365日の本番モニターに変換します。これにより開発時のテストと本番監視のギャップが解消されます。

- CI/CDパイプラインにデプロイ後のAPIチェックを統合する. 各デプロイ後に合成APIチェックを自動スモークテストとして実行します。ポストデプロイチェックが失敗した場合は、自動ロールバックやトラフィックホールドのトリガーを検討してください(ブルー/グリーンやカナリアのプログレッシブデリバリ設定で)。誤検知を減らすため、2つ目のロケーションからの確認実行を使ってから自動処理を行います。

- PagerDuty、Slack、Microsoft Teamsへのエスカレーションポリシー付きアラートのルーティング。 メールのみのアラートは検知遅延を招きます。インシデント管理ツールとのネイティブ連携により、アラートは即座に適切な担当者に届き、未対応時のエスカレーションパスも確立されます。

API監視の課題

よく設計された監視体制でも運用上の課題に直面します。これらを予測することで、チームは対策を講じた設計が可能になります。

サードパーティAPIの可視性

外部依存を監視することで、可用性と遅延のデータは得られますが、劣化の内部原因を明らかにすることはできません。StripeやOktaが遅くなると、それを確認して影響範囲を特定できますが、根本原因分析はベンダーのステータスページやサポートのエスカレーションルートに依存します。

レート制限

モニタリングエージェントはAPIのレート制限にカウントされます。総合的なシンセティックリクエスト量は以下のようにスケールします:ロケーション × 時間あたりのチェック数 × モニター実行あたりのAPIコール × 確認の再試行回数。単一エンドポイントモニターの場合:30ロケーション × 60チェック/時間 = 1,800リクエスト/時間。同じ設定での5ステップトランザクションモニターの場合:30 × 60 × 5 = 9,000リクエスト/時間となります。特に制限が厳しい内部APIでは、レート制限の予算編成にこれを考慮してください。必要な場合はモニタリングプロバイダーのIPレンジがホワイトリストに登録されていることを確認しましょう。

認証の複雑さ

短期間有効なトークンを使用するAPIには、トークンの自動更新機能を持つモニタリングツールが必要です。ユーザー委任型のOAuth 2.0トークン(認可コードフロー)は通常15分から1時間で期限切れになります。マシン間通信用のクライアントクレデンシャルズトークンは通常1〜24時間持続します。高セキュリティ環境では5分間隔の制限を設ける場合もあります。証明書ベースの認証やローテーティングAPIキーも注意深い認証情報管理が必要です。

動的および非決定論的レスポンス

タイムスタンプ付きデータ、ページネーションがある結果、ランダム順の配列を返すAPIは、正確な値での一致をアサートするのが困難です。毎回変化する正確なフィールド値ではなく、構造、フィールドの存在、およびフィールドタイプを検証するJSONPath式を使用してください。

アラート疲労

過剰なモニタリング—1分間隔で多数のエンドポイントをチェックしたり、閾値を厳しく設定しすぎると、実際のアラートに対する感度が鈍化します。重要な経路には1分間隔、非重要エンドポイントには5〜15分間隔の階層的なモニタリングを使用してください。誤報を減らすために、二次ロケーションでの確認を行ってから通知することを推奨します。

プロトコルの多様性

REST、SOAP、GraphQL、gRPC、およびWebSocketはそれぞれ異なるアサーション戦略を必要とします。RESTのみを扱うツールではSOAPサービスの障害を見逃し、GraphQLのエラーをHTTP 200で返すために誤って成功として報告することがあります。

Dotcom-MonitorでのAPIモニタリング設定方法

チェックが失敗した場合、アラートは既存のインシデント対応ツールにルーティングされます。誰も見ない別のモニタリング受信箱には送られません。

チェックが失敗した場合、アラートは既存のインシデント対応ツールにルーティングされます。誰も見ない別のモニタリング受信箱には送られません。Dotcom-Monitorは30以上のグローバルロケーションからの1分間隔のチェック、多段階トランザクションサポート、PagerDuty、Slack、d Microsoft Teams。

ステップ 1 — エンドポイントとアサーションを定義する

- エンドポイント URL: 監視する API エンドポイント

- HTTP メソッド: GET、POST、PUT、PATCH、DELETE のいずれか

- リクエストヘッダー:

Content-Type、Authorization、および必要なカスタムヘッダー - リクエストボディ: POST/PUT リクエストの JSON ペイロード

- 認証: OAuth 2.0、Bearer トークン、API キー、Basic 認証、mTLS、AWS Signature v4、NTLM、Kerberos、またはカスタムヘッダー

- アサーション: HTTP ステータスコード、応答時間の閾値、ヘッダー値、JSONPath/XPath ペイロードアサーション

ステップ 2 — Postman または Insomnia からインポート

チームで Postman または Insomnia を使用している場合、手動でのエンドポイント設定は不要です:

- Postman: コレクションを v2.0 または v2.1 の JSON としてエクスポートし、Dotcom-Monitor にインポートします。リクエスト定義、ヘッダー、ボディ、環境変数、テストアサーションが保持されます。

- Insomnia: ワークスペースを Insomnia v4 JSON ファイルとしてエクスポートし、Dotcom-Monitor にインポートします。リクエストグループ、認証設定、環境変数が保持されます。

どちらのインポート形式も、一度の開発テストを継続的な24時間365日の本番監視に変換し、再設定の必要はありません。

すでに Postman を使用していますか?24時間365日の本番監視まであと5分です。

既存の Postman コレクションをそのまま Dotcom-Monitor にインポートしてください。リクエスト定義、ヘッダー、環境変数、アサーションは保持されますので、再設定は不要です。

ステップ 3 — 監視場所と頻度を設定する

- チェック頻度: 1分、3分、5分、15分間隔 — 重要度に応じてエンドポイントごとに設定

- 監視場所: 北米、ヨーロッパ、アジア太平洋、南米の30以上のロケーションから選択可能

- プライベートエージェント: 社内またはファイアウォール内の API 向け — オンプレミスまたはプライベートクラウドにエージェントを展開(Windows と Linux 対応)。エージェントはアウトバウンド通信のみを行い、インバウンドのファイアウォールルールは不要です。

- 確認リトライ: 一時的なネットワークの誤検知を防ぐために、アラートを発報する前に別の場所での確認チェックを設定可能

ステップ 4 — アラートのルーティングを設定する

- PagerDuty: 重大なアラートをオンコールスケジュールへ直接ルーティングし、自動インシデント作成とエスカレーションを実行

- Slack / Microsoft Teams: エンドポイントの詳細、エラータイプ、応答データを含むアラートメッセージをオペレーションチャネルに投稿

- メール、SMS、Phone call: 連絡先またはチームごとの通知設定を構成する

- Webhook: OpsGenie、ServiceNow、または任意のHTTP対応サービスと統合する

- しきい値設定: メトリックごとにアラート条件を設定 — 応答時間、エラー率、アサーション失敗率 — 重大度レベル付き

ステップ5 — CI/CDパイプライン統合

- Dotcom-Monitor REST API: 任意のCI/CDシステムからHTTP APIコールで監視タスクをプログラム的に作成、更新、トリガーする

- GitHub Actions / Azure DevOps / Jenkins: デプロイ後にDotcom-Monitorチェックを実行し、結果を待機、アサーションに失敗した場合はパイプラインを失敗させるステップを追加する

- 本番前の検証: ビルドを本番に昇格させる前に、ステージング環境で同じ合成チェックを実行し、ユーザーに影響が出る前にリグレッションを検出する

業界別API監視ユースケース

| 業界 | 監視すべき重要なAPI | 主要な監視要件 |

|---|---|---|

| Eコマース | チェックアウト、支払い認証、在庫、配送、カート管理 | マルチステップトランザクションチェーン;1分間隔;支払い確認ステータスのペイロードアサーション |

| FinTech / 銀行 | 取引処理、KYC/AML検証、口座残高、為替レート、電信送金API | 200ms未満のレイテンシSLA;PCI DSS証拠対応のコンプライアンス関連チェック;完全な認証フロー検証 |

| ヘルスケア | EHR統合(HL7 FHIR)、保険ポータル、遠隔医療エンドポイント、患者スケジューリング | HIPAA証拠対応のコンプライアンス関連チェック;データ完全性のペイロード検証;99.99%の稼働率SLA |

| SaaS | コアプロダクトAPI、Webhook配信エンドポイント、パートナー統合API、認証API | API-as-a-ProductのSLA遵守;Postmanインポートによる開発から監視への一貫性;サードパーティ依存関係の監視 |

| エンタープライズIT | CRM、ERP、HRIS、IDプロバイダー、内部ワークフロー自動化API | ファイアウォール内API用のプライベートエージェント;NTLM/Kerberos認証サポート;部門間APIの可視化 |

| メディア / ゲーミング | CDNコンテンツ配信API、認証、リアルタイムスコアリング、ソーシャル機能API | 地理的分散監視;WebSocket接続監視;トラフィック急増検出 |

今すぐAPIの監視を開始しましょう。

Dotcom-Monitorは30以上のグローバルロケーションから1分間隔の合成API監視を提供します。間隔、マルチステップトランザクションのサポート、およびネイティブのPagerDuty、Slack、Microsoft Teamsとの統合。セットアップは5分以内で完了します。30日間の無料トライアルにはクレジットカードは不要です。