La surveillance des API est la pratique continue et automatisée de validation des points de terminaison des API pour la disponibilité, le temps de réponse et la correction des données — confirmant non seulement qu’un point de terminaison répond, mais qu’il renvoie les bonnes données, dans le bon format, avec une latence acceptable, du point de vue des utilisateurs et des systèmes dépendants.

Les API sont le tissu conjonctif des logiciels modernes. Chaque fois qu’un utilisateur se connecte, effectue un paiement ou reçoit une notification en temps réel, plusieurs appels API s’exécutent en coulisses — souvent à travers des microservices, des fournisseurs cloud, et des vendeurs tiers. Quand ces appels échouent ou ralentissent, l’impact est immédiat : flux de paiement cassés, utilisateurs bloqués, et perte de revenus.

Pourtant, la plupart des équipes ne découvrent les échecs d’API que lorsqu’ils sont signalés par les clients. Sans surveillance proactive, le délai entre l’échec et l’enquête est généralement mesuré en dizaines de minutes — suffisamment long pour exposer un risque réel de revenus et de SLA avant que quelqu’un soit alerté.

Ce guide explique ce qu’est la surveillance des API, comment elle fonctionne, les métriques à suivre, en quoi elle diffère des tests d’API et de l’APM, et comment la mettre en œuvre — avec la précision dont les ingénieurs DevOps, les SRE et les équipes QA ont besoin pour prendre des décisions éclairées en production.

Qu’est-ce que la surveillance des API ?

La surveillance des API couvre trois couches distinctes de validation, par ordre de spécificité croissante :

- Surveillance de la disponibilité — Le point de terminaison est-il accessible ? Renvoie-t-il une réponse HTTP sans délai d’attente ?

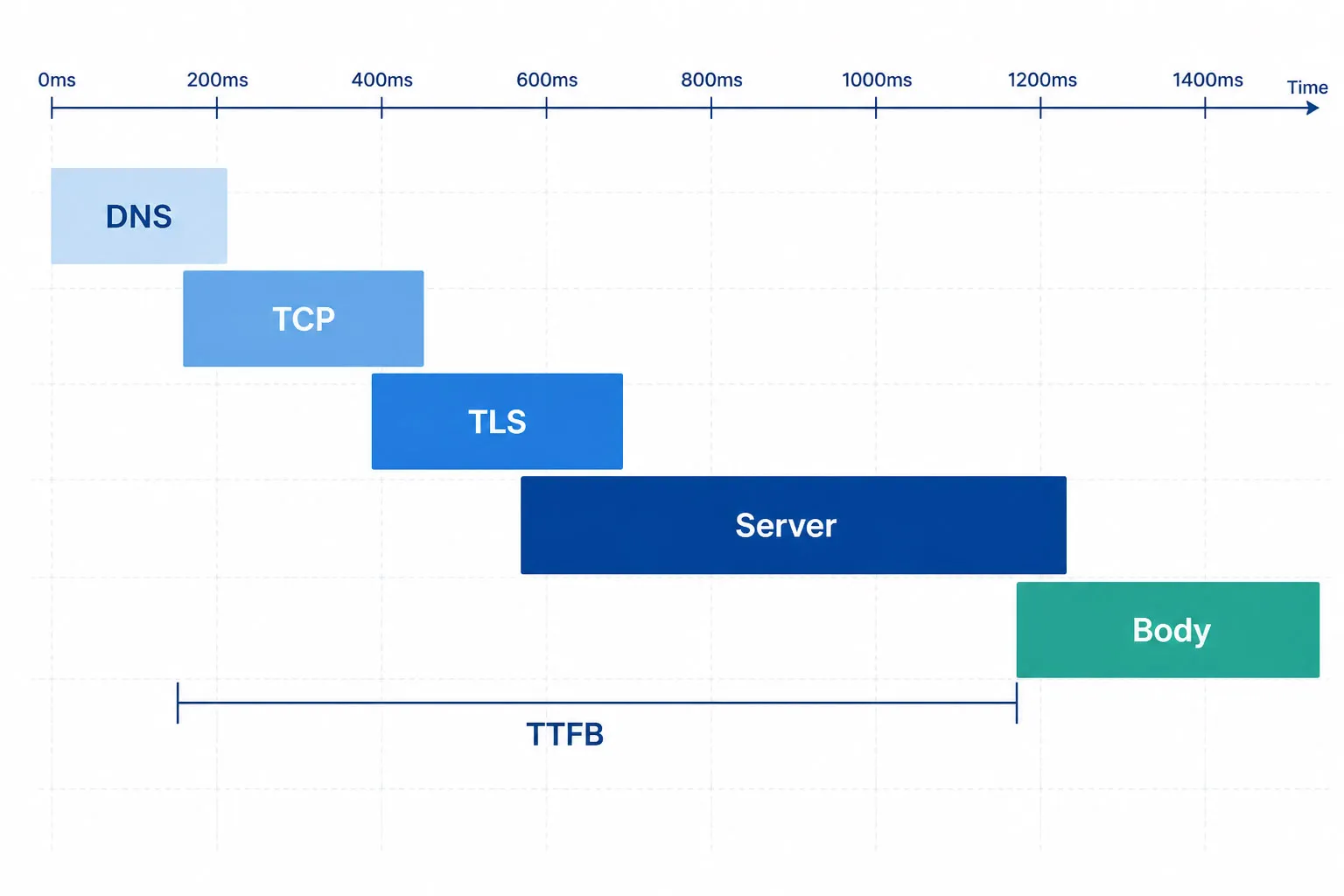

- Surveillance des performances — Combien de temps prend la réponse ? Le TTFB, la résolution DNS ou la négociation TLS introduisent-ils de la latence ?

- Validation de la charge utile — Le corps de la réponse contient-il la structure de données attendue ? Les assertions JSONPath ou XPath sont-elles validées ?

Qu’est-ce qu’un point de terminaison API ?

Une interface de programmation d’applications (API) est un ensemble de protocoles et de définitions qui permet aux systèmes logiciels de communiquer. Un point de terminaison d’API est l’URL spécifique à laquelle une API reçoit les requêteset renvoie des réponses — l’unité d’observation pour la surveillance des API. Par exemple :

POST /v2/auth/token— point de terminaison d’émission de jetonGET /v2/orders/{id}— point de terminaison de récupération de commandePOST /v2/payments/charge— point de terminaison de traitement des paiements

Les applications modernes dépendent simultanément de dizaines voire de centaines de tels points de terminaison — microservices internes, passerelles de paiement tierces, fournisseurs d’identité, API d’expédition et systèmes CRM. La surveillance des API maintient la visibilité sur tous ces éléments.

Types de surveillance des API

Toute surveillance d’API ne se ressemble pas. Comprendre les catégories aide les équipes à construire une couverture qui correspond à la fois à leur architecture et à leurs exigences métier. Les cinq types principaux s’appliquent à presque toutes les équipes ; les types spécialisés importent lorsque leurs conditions s’appliquent.

Types principaux

| Type | Ce qu’il valide | Idéal pour |

|---|---|---|

| Surveillance de disponibilité | Accessibilité du point de terminaison ; codes de réponse HTTP ; réponse dans la fenêtre de délai | SLA de disponibilité basique ; détection immédiate des pannes |

| Surveillance de performance | Temps de réponse, TTFB, résolution DNS, poignée de main TCP, temps TLS, débit | SLA de latence, cibles P95/P99, planification de capacité |

| Surveillance de charge utile / validation | Corps de réponse via assertions JSONPath/XPath ; exactitude du schéma ; valeurs des champs | Détection des échecs silencieux où HTTP 200 ≠ données correctes |

| Surveillance synthétique | Appels API simulés depuis des emplacements globaux à intervalles programmés, indépendamment du trafic réel | Détection proactive ; couverture géographique ; périodes sans trafic |

| Surveillance des transactions multi-étapes | Séquences chaînées d’appels API (par ex., auth → requête → soumettre → confirmer) ; passage de données entre étapes | Flux e-commerce, parcours de connexion, workflows de commande |

Types spécialisés

| Type | Ce qu’il valide | Idéal pour |

|---|---|---|

| Surveillance de sécurité | Échecs d’authentification, modèles de requêtes anormaux, expiration de certificat, abus de limitation de débit, rejeu de jeton | FinTech, santé ; API traitant des PII/PHI |

| Contrôles de conformité | Validation version/cipher TLS, expiration de certificat, présence des en-têtes de sécurité, test d’application d’authentification | Santé, services financiers, industries réglementées |

| Surveillance des utilisateurs réels (RUM) | Interactions réelles des utilisateurs avec les API ; visibilité complète de session ; variance géographique et dispositif réelle | >Comprendre le véritable impact utilisateur ; valider les résultats synthétiques |

| Versioning & Surveillance de la dépréciation | Taux d’adoption des versions de l’API ; pics d’erreurs après changement de version ; compatibilité rétroactive | Équipes gérant plusieurs versions d’API simultanément |

| Surveillance tierce partie / Intégration | Dépendances aux API externes (Stripe, Okta, Salesforce, Twilio) ; isolation des pannes externes vs internes | Toutes applications dépendant d’API tierces pour des workflows critiques |

Une note sur les contrôles liés à la conformité : ceux-ci fournissent des preuves complémentaires pour des contrôles techniques spécifiques. La conformité aux cadres réglementaires (HIPAA, PCI DSS, SOC 2) nécessite une gouvernance organisationnelle plus large que ce que la seule surveillance peut assurer.

Surveillance Synthétique vs. Surveillance des Utilisateurs Réels (RUM)

Les deux approches fournissent des données de performance API, mais depuis des points de vue fondamentalement différents :

| Surveillance Synthétique | Surveillance des Utilisateurs Réels (RUM) | |

|---|---|---|

| Déclencheur | Contrôles scriptés selon un planning (par exemple, toutes les 1 minute) | Requêtes réelles des utilisateurs en production |

| Couverture | Fonctionne 24h/24 et 7j/7 — y compris lorsqu’aucun utilisateur réel n’est actif | Génère des données uniquement lorsque des utilisateurs effectuent des requêtes actives |

| Détection | Proactive — détecte les pannes avant que l’utilisateur ne soit impacté | Réactive — met en lumière les problèmes après que les utilisateurs sont déjà affectés |

| Portée | API publiques et privées/internes (via Private Agent) | APIs atteintes par les utilisateurs/clients réels — principalement orientées vers le public, bien que la RUM entreprise puisse également capturer les appels API internes depuis des applications instrumentalisées |

| Cas d’usage | Validation continue de disponibilité et performance | Compréhension du véritable rayon d’impact et de l’expérience utilisateur réelle |

Principaux indicateurs de surveillance des API

Suivre les bons indicateurs fait la différence entre une réponse incidente informée et la fatigue des alertes. Voici les indicateurs les plus importants — avec des références précises et ce que chacun révèle.

| Indicateur | Objectif / Référence | Ce qu’il détecte |

|---|---|---|

| Disponibilité (Pourcentage de disponibilité) | ≥ 99,9 % (trois 9); 99,99 % pour les API critiques pour les revenus | Panne totale, panne partielle, délai d’attente |

| Temps de réponse total | < 200ms pour les points de terminaison simples ; < 1s pour les opérations complexes | Ralentissements serveur, surcharge, régressions de déploiement |

| Temps jusqu’au premier octet (TTFB) | < 100ms idéal ; < 300ms acceptable | Délai de traitement serveur avant le début de la réponse |

| Temps de réponse P95 / P99 | Alerte à 2× la base P95 par point de terminaison ; ajustez selon le comportement du point de terminaison | Latence extrême affectant les 1 à 5 % des requêtes les plus lentes |

| Taux d’erreur (4xx / 5xx) | < 0,1 % pour les API en production | Échecs d’authentification, mauvaise gestion des entrées, erreurs serveur |

| Temps de résolution DNS | < 50ms pour recherches mises en cache dans la même région ; inter-régions peuvent dépasser 100ms | Problèmes de propagation DNS, échecs de résolveurs |

| Temps de poignée de main TLS | < 100ms | Mauvaise configuration des certificats, problèmes de négociation de version TLS |

| Taux de réussite des assertions de charge utile | 100 % (alerte dès la moindre défaillance) | Échecs silencieux : réponses HTTP 200 avec données erronées ou manquantes |

| Débit (req/sec) | Comparer avec la base historique | Chutes de trafic inattendues ou pics anormaux |

| Expiration du certificat (jours restants) | Alerte à 30 jours ; critique à 7 jours | Expiration imminente du certificat TLS |

Références des temps de réponse

Comment fonctionne la surveillance API ?

Comprendre les mécanismes techniques aide les équipes à configurer correctement la surveillance et à interpréter avec précision les résultats.

La boucle principale de surveillance

- Planifier. Un contrôle synthétique s’exécute à intervalles configurés (par exemple, toutes les 1 minute) depuis un emplacement mondial de surveillance sélectionné.

- Envoyer la requête. L’agent de surveillance envoie une requête HTTP au point de terminaison cible — incluant la méthode HTTP (GET, POST, PUT, PATCH, DELETE), les en-têtes de requête, les identifiants d’authentification et le corps de la requête.

- Mesurer le temps. L’agent enregistre le temps de résolution DNS, le temps de connexion TCP, le temps de négociation TLS, le temps jusqu’au premier octet (TTFB) et le temps total de réponse en tant que composants distincts.

- Vérifier. La réponse est évaluée par rapport aux assertions configurées — code de statut HTTP, seuil de temps de réponse, en-têtes de réponse et contenu du payload via JSONPath (REST) ou XPath (SOAP).

- Alertes ou validation. Si une assertion échoue, ou si la requête expire, un incident est créé et des alertes sont envoyées selon les règles de notification configurées.

- Enregistrer. Tous les résultats — réussite et échec — sont conservés avec horodatages, données de réponse et résultats d’assertions pour l’analyse historique et les rapports SLA.

Surveillance de transaction API multi-étapes

La surveillance d’un point de terminaison unique confirme que chaque point de terminaison individuel répond. Mais les parcours réels des utilisateurs ne sont pas des appels d’API isolés — ce sont des séquences chaînées où chaque étape dépend du résultat de l’étape précédente.

Considérez un flux de paiement e-commerce :

- Étape 1 —

POST /auth/token: Authentifier l’utilisateur ; extraire leaccess_tokendu corps de la réponse - Étape 2 —

GET /products/{id}: Récupérer les détails du produit ; injecter le token dans l’en-têteAuthorization - Étape 3 —

POST /cart/add: Ajouter un article ; extraire lecart_idde la réponse - Étape 4 —

POST /checkout/initiate: Lancer le paiement avec lecart_id; extraire lecheckout_session_id - Étape 5 —

POST /payments/charge: Traiter le paiement ; vérifier que le champorder_statusdans la réponse vaut'confirmed'

Dans la surveillance d’un point de terminaison unique, les cinq étapes pourraient réussir individuellement alors que la transaction complète échoue — parce que les données de session ne sont pas correctement transmises entre les étapes, qu’un token expire en cours de processus, ou que l’API de paiement retourne un HTTP 200 avec un champ d’erreur dans la charge utile. La surveillance multi-étapes exécute toute la chaîne comme une seule surveillance, valide chaque étape indépendamment, et transmet automatiquement les valeurs dynamiques (tokens, IDs de session, IDs de commande) entre les étapes.

Dotcom-Monitor permet la surveillance de transaction multi-étapes en chaînant des appels API séquentiels dans une seule tâche de surveillance. L’extraction et l’injection de variables entre les étapes sont automatiques. Chaque étape est validée indépendamment, ce qui permet de localiser précisément l’étape où la transaction a échoué.

Validation de la charge utile : Assertions JSONPath et XPath

La validation de la charge utile différencie une surveillance d’une simple requête ping de disponibilité. La manière dont les assertions sont exprimées dépend de l’outil, mais la logique reste cohérente :

- Accès aux champs JSONPath (REST) : Accéder à

$.data.status— puis vérifier que la valeur retournée est égale à'active' - Vérification de tableau JSONPath : Accéder à

$.items— vérifier que la longueur du tableau est supérieure à 0 - Assertion XPath (SOAP) :

//order/status/text()— vérifier que la valeur du nœud est égale à'confirmed' - Assertion d’en-tête : Vérifier que la valeur de l’en-tête

Content-Typeest égale à'application/json' - Assertion de temps de réponse : Vérifier que le temps total de réponse est inférieur à 500 ms

Surveillance de l’authentification

Les API de production nécessitent une authentification. Un outil de surveillance doit gérer les mêmes méthodes d’authentification que vos clients API réels. Les schémas qu’une plateforme de surveillance prête pour la production devrait prendre en charge :

| Méthode d’authentification | Description | Remarques |

|---|---|---|

| OAuth 2.0 — Client Credentials | Machine à machine ; le client échange les identifiants contre un jeton directement | Le plus courant pour la surveillance des API serveur à serveur |

| OAuth 2.0 — Authorization Code | Autorisation déléguée par l’utilisateur ; généralement utilisé avec PKCE pour les SPA/applications mobiles | Nécessite que l’outil de surveillance gère automatiquement le rafraîchissement des jetons |

| OAuth 2.0 — Resource Owner Password (ROPC) | Échange direct nom d’utilisateur + mot de passe — flux hérité | À utiliser uniquement lorsque le flux Authorization Code n’est pas réalisable |

| Jeton Bearer (JWT) | Jeton statique ou rafraîchi dynamiquement dans l’en-tête Authorization |

Les JWT à courte durée de vie nécessitent un rafraîchissement automatique du jeton |

| Clé API | Clé statique dans l’en-tête, un paramètre de requête ou un cookie | Le plus simple à surveiller ; surveiller les événements de rotation |

| Authentification de base | username:password encodé en Base64 dans l’en-tête Authorization |

Hérité — encore courant dans les API internes et d’entreprise |

| Signature AWS v4 | Requête signée HMAC utilisant les identifiants AWS | Requis pour les points de terminaison AWS API Gateway |

| mTLS / Certificat client | TLS mutuel — les deux parties présentent des certificats | Environnements à confiance zéro ; la surveillance de l’expiration des certificats est critique |

| NTLM / Kerberos | Authentification intégrée Windows/Active Directory | APIs internes d’entreprise ; moins courant dans les environnements cloud natifs |

| En-têtes personnalisés | Schémas d’authentification propriétaires via des en-têtes de requête personnalisés | Solution générique pour les implémentations d’authentification non standard |

L’expiration des jetons est une cause principale de faux positifs dans la surveillance. Les durées de vie des jetons d’accès OAuth 2.0 varient largement selon l’implémentation et le type d’octroi. Les jetons délégués par l’utilisateur (flux Authorization Code) durent généralement de 15 minutes à 1 heure. Les jetons machine à machine (flux Client Credentials) sont souvent configurés pour des périodes plus longues — de 1 heure à 24 heures — afin de réduire la surcharge de rafraîchissement. Les environnements à haute sécurité peuvent imposer des durées aussi courtes que 5 minutes. Quelle que soit la durée, un outil de surve…Un outil de surveillance qui ne gère pas le rafraîchissement automatique des jetons générera des faux positifs ou nécessitera une rotation manuelle des identifiants, créant à la fois une surcharge opérationnelle et un risque de panne.

Une note sur la subvention implicite OAuth 2.0 : elle est dépréciée dans les meilleures pratiques de sécurité OAuth 2.0 actuelles (RFC 9700) et ne doit pas être utilisée dans les nouveaux systèmes. Si vos API existantes utilisent le flux implicite, une migration vers Authorization Code + PKCE est fortement recommandée.

Pourquoi la surveillance des API est importante : impact commercial

Les API ne sont pas des abstractions d’infrastructure — ce sont des voies de revenus. Lorsqu’elles échouent, les conséquences sont financières, opérationnelles et contractuelles.

Le coût des défaillances d’API non détectées

Sans surveillance proactive, les équipes dépendent des rapports des clients pour détecter les défaillances. Les enquêtes sectorielles placent constamment le MTTD signalé par les clients bien au-dessus de 30 minutes — au moment où une plainte est déposée, enquêtée, triée et escaladée, cette fenêtre est déjà passée. La surveillance synthétique continue à intervalles de 1 minute réduit la détection à moins de 60 secondes, permettant l’isolation de la cause racine avant que le problème ne s’aggrave.

La formule de revenus est simple : commandes/min × valeur moyenne de commande × durée de la panne en minutes. Une plateforme traitant 100 commandes/min à une valeur moyenne de 50 $ perd 25 000 $ de revenus potentiels pendant une panne de l’API de paiement de 5 minutes. Insérez votre propre débit et valeur de commande pour évaluer votre exposition.

Scénarios spécifiques à l’industrie

- E-commerce. Une défaillance de l’API de paiement pendant le pic de trafic bloque toutes les conversions. Une API d’autorisation de paiement retournant HTTP 200 avec un statut refusé — mais sans alerte — bloque silencieusement les transactions pendant des minutes avant qu’on ne s’en aperçoive.

- FinTech. Les API de traitement des transactions doivent répondre aux exigences de latence inférieure à la seconde. Une dégradation persistante au-delà des seuils SLA peut entraîner des pénalités contractuelles et des constats d’audit sous PCI DSS.

- Santé. Les API d’intégration des dossiers médicaux électroniques (DME) et les points de terminaison de télémédecine doivent maintenir un échange de données conforme à la HIPAA. Une API retournant HTTP 200 avec des données patient incomplètes constitue un événement de conformité — pas seulement un problème de performance.

- SaaS / API en tant que Produit. Lorsque votre API est un produit facturable, les interruptions entraînent des pénalités SLA contractuelles et une perte de clients. La surveillance fournit la preuve documentée de disponibilité nécessaire pour le reporting de conformité SLA.

- IT d’entreprise. Intégrations API CRM, ERP et RH à travers les départements. Une dégradation de l’API Salesforce peut briser silencieusement les workflows commerciaux à l’échelle de l’organisation sans qu’une seule erreur 500 n’apparaisse dans vos journaux.

Risque des API tierces

Les applications modernes dépendent d’API externes qu’elles ne contrôlent pas : passerelles de paiement (Stripe, PayPal, Braintree), fournisseurs d’identité (Okta, Auth0, AWS Cognito), shipping APIs et systèmes CRM. Lorsqu’ils se dégradent, votre application semble être en panne pour les utilisateurs même si votre infrastructure est saine.

La surveillance des points de terminaison tiers permet aux équipes d’isoler immédiatement si une panne est interne ou externe — une distinction qui peut prendre un temps d’investigation considérable sans données de surveillance préalables. Elle fournit également une preuve documentée pour tenir les fournisseurs responsables de leurs SLA publiés.

Cessez d’apprendre les pannes d’API par vos clients.

La surveillance synthétique des API de Dotcom-Monitor détecte les pannes en moins de 60 secondes et envoie des alertes directement à PagerDuty, Slack ou Microsoft Teams. Surveillez les passerelles de paiement, les fournisseurs d’identité et les API internes depuis une seule plateforme.

Essayez gratuitement pendant 30 jours → Aucune carte de crédit requise

Surveillance des API vs. Test des API

Ces deux pratiques valident le comportement des API, mais elles ont des objectifs différents dans le cycle de vie de la livraison logicielle. Les confondre crée des lacunes en matière de couverture.

| Dimension | Test des API | Surveillance des API |

|---|---|---|

| Quand | Avant déploiement — développement, QA, pipeline CI/CD | Après déploiement — en continu en production |

| Environnement | Développement, préproduction, environnement de test contrôlé | Production en direct, infrastructure réelle, trafic réel |

| Déclencheur | Commit de code, build, exécution manuelle, contrôle PR | Planifié (ex. toutes les 1 minute), continu 24/7 |

| Objectif | Empêcher les bugs d’atteindre la production | Détecter les pannes et dégradations en production |

| Couverture | Tous les comportements, cas limites, chemins d’erreur | Chemins critiques, points de terminaison SLA, chaînes de parcours utilisateur |

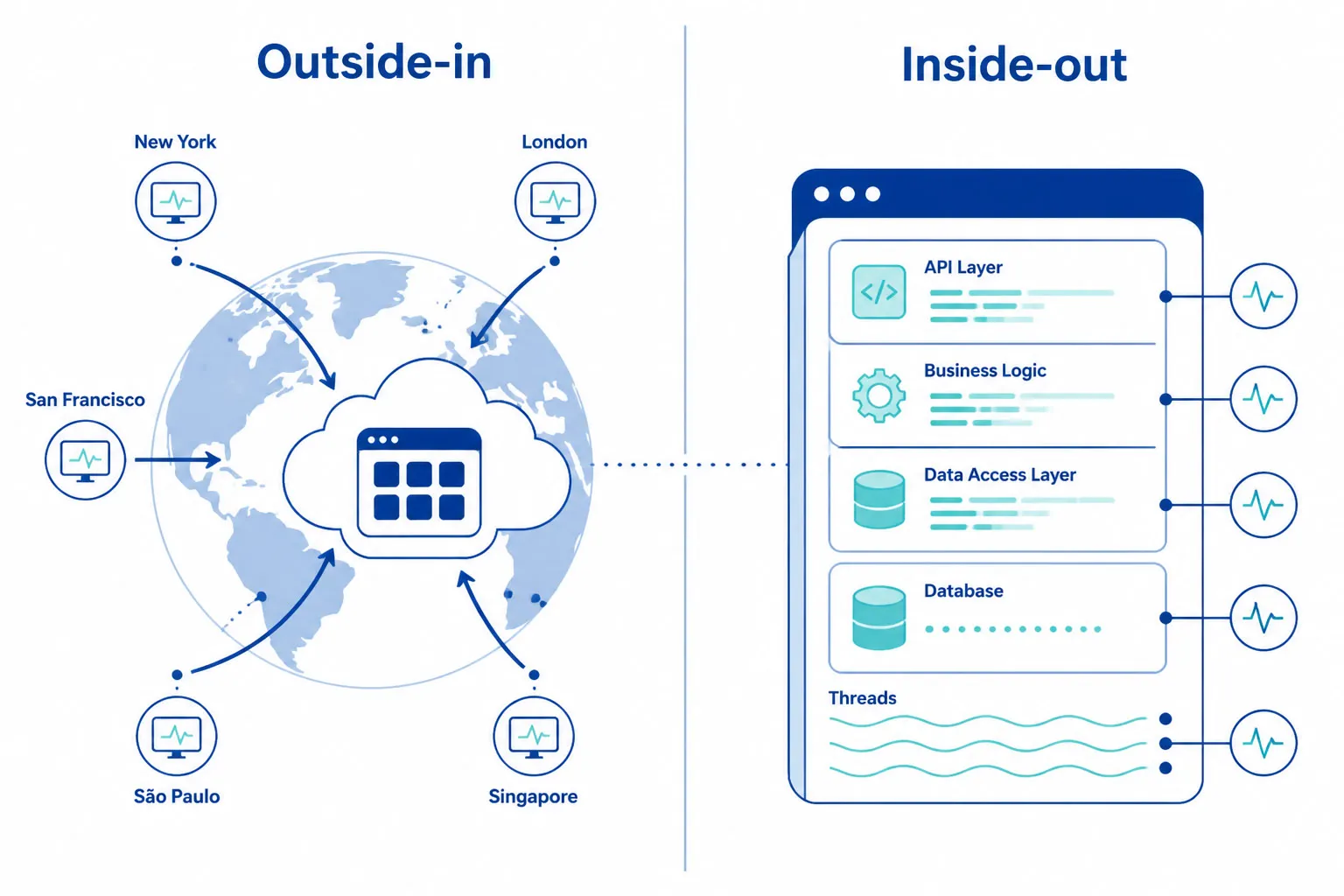

| Perspective | De l’intérieur vers l’extérieur : teste le comportement du code | De l’extérieur vers l’intérieur : valide du point de vue utilisateur |

| Résultat | Rapport succès/échec ; bloque le déploiement en cas d’échec | Alertes en temps réel, enregistrements SLA de disponibilité, historique des incidents |

La relation pratique : le test des API est une activité de phase de développement. La surveillance des API est une activité opérationnelle. Le test détecte les bugs avant le déploiement ; la surveillance détecte les pannes, régressions, dégradations de performance et problèmes de dépendance après le déploiement — dans des conditions d’infrastructure réelles différentes des environnements de test contrôlés.

Un système maturel’équipe d’ingénierie gère les deux — et utilise imports de collections Postman pour faire le lien entre les deux, convertissant les tests de développement en moniteurs de production sans dupliquer les définitions des requêtes.

Surveillance API vs. APM

Ces deux catégories sont fréquemment confondues. Elles sont complémentaires, non interchangeables.

| Surveillance synthétique API | APM (Application Performance Monitoring) | |

|---|---|---|

| Perspective | De l’extérieur vers l’intérieur — valide depuis le même point de vue que les utilisateurs et partenaires | De l’intérieur vers l’extérieur — observe le comportement interne de l’application |

| Ce qu’elle voit | Échecs DNS, problèmes de routage réseau, erreurs TLS, erreurs CDN, lacunes géographiques | Requêtes BD lentes, fuites de mémoire, exceptions de code, appels de fonctions lents |

| Quand elle s’exécute | 24/7 — même en période de trafic nul | Seulement lorsque des requêtes réelles sont traitées |

| Question à laquelle elle répond | « Nos clients peuvent-ils réellement appeler cette API maintenant ? » | « Que se passe-t-il à l’intérieur de notre application lorsqu’une requête arrive ? » |

Les équipes avec le MTTR le plus faible utilisent les deux : l’APM pour l’analyse interne des causes profondes, la surveillance synthétique API pour la validation externe. Les logs et traces répondent à « qu’est-ce qui a mal tourné dans notre code ? » La surveillance synthétique répond à « nos clients peuvent-ils utiliser cette API maintenant ? »

Protocoles API : REST, SOAP, GraphQL, gRPC, et WebSocket

Chaque protocole API a des exigences de surveillance et des modes de défaillance distincts. Un outil de surveillance qui traite toutes les API comme de simples requêtes HTTP GET manquera les problèmes spécifiques au protocole.

Surveillance API REST

REST est le protocole API dominant. La surveillance valide les méthodes HTTP (GET, POST, PUT, PATCH, DELETE), les codes d’état, les en-têtes de réponse et les corps de réponse JSON via des assertions JSONPath. Exigences clés : assertion sur les valeurs des champs du contenu de la réponse — pas seulement les codes d’état ; surveiller toutes les méthodes HTTP, pas uniquement GET (POST, PUT, et DELETE déclenchent des logiques côté serveur différentes et des échecsmodes); suivre le temps de réponse par point de terminaison individuellement, pas en moyennes agrégées à travers les points de terminaison.

Surveillance de l’API SOAP

Les API SOAP échangent du XML via HTTP. Exigences de surveillance : importation WSDL pour la définition des points de terminaison et du schéma ; assertions XPath sur les éléments de réponse XML ; prise en charge des protocoles SOAP 1.1 et SOAP 1.2 ; configuration WS-Security pour les services SOAP d’entreprise utilisant la sécurité au niveau des messages.

Surveillance de l’API GraphQL

Le principal défi de la surveillance de GraphQL : la plupart des implémentations serveur GraphQL retournent un HTTP 200 même en cas d’erreurs partielles ou de requêtes malformées. Le code de statut HTTP n’est pas un signal fiable d’échec. Vous devez :

- Envoyer des charges utiles de requête spécifiques et vérifier l’objet

datade la réponse - Contrôler le tableau

errorsdans le corps de la réponse — dans GraphQL standard, chaque réponse possède un champ optionnelerrorsau niveau supérieur qui est vide ou absent en cas de succès et rempli en cas d’échec. Une réponse 200 avec unerrors[]peuplé signifie que la requête a échoué au niveau GraphQL même si le HTTP a réussi - Valider les invariants spécifiques à la requête : vérifier que les champs attendus sont présents, non nuls et correctement typés dans l’objet data — certains systèmes encodent les échecs métier dans l’objet data plutôt que de remplir le tableau d’erreurs au niveau supérieur

- Surveiller la complexité et la profondeur des requêtes pour détecter la dégradation des performances avant que cela ne cause des délais d’attente

Surveillance de l’API gRPC

gRPC utilise par défaut Protocol Buffers sur HTTP/2, bien que gRPC-Web prenne en charge HTTP/1.1 via un proxy pour les clients navigateurs. Exigences de surveillance : importation du fichier proto pour les définitions de services et méthodes ; prise en charge de l’encodage/décodage binaire des messages Protocol Buffer ; validation des codes d’état utilisant les codes d’état gRPC (OK, UNAVAILABLE, DEADLINE_EXCEEDED, etc.) — pas les codes HTTP ; prise en charge des types RPC Unary, Server-Streaming, Client-Streaming et Bidirectional-Streaming.

Surveillance de l’API WebSocket

Les APIs WebSocket maintiennent des connexions bidirectionnelles persistantes en temps réel. La surveillance valide le temps d’établissement de la connexion et le succès de la poignée de main WebSocket, la latence de livraison des messages et la correction de la charge utile, ainsi que la stabilité de la connexion dans le temps incluant le comportement de reconnexion après des coupures.

Surveillance des API publiques vs internes

La plupart des guides de surveillance d’API se concentrent exclusivement sur les points de terminaison accessibles au public. Mais dans les architectures microservices, la majorité des appels API critiques sont internes — des appels service à service qui n’atteignent jamais l’internet public.

| Surveillance API publique | Surveillance API interne | |

|---|---|---|

| Ce que cela couvre | Points de terminaison destinés aux clients, APIs partenaires, intégrations tierces | Microservices internes, VPC privés, environnements de staging, APIs derrière le pare-feu |

| Comment cela fonctionne | Agents de surveillance externes effectuent des vérifications depuis des emplacements globaux via internet public | Un Agent Privé déployé à l’intérieur de votre réseau initie des connexions sortantes vers la plateforme de surveillance |

| Exigences pare-feu | Aucune — les vérifications proviennent de l’extérieur | Aucune règle entrante requise — l’agent initie uniquement des connexions sortantes |

| Ce qu’il détecte | Échecs de résolution DNS, problèmes de routage CDN, erreurs TLS, lacunes de disponibilité géographique | Échecs inter-services, latence du microservice d’authentification, dégradation des API de requêtes base de données |

| Déploiement | Pas d’installation — fonctionne immédiatement | Agent installé sur site ou dans le cloud privé (Windows et Linux supportés) |

Les APIs internes des microservices sont la source la plus courante de défaillances en cascade. Un service d’authentification dégradé ou une API d’accès aux données lente cause des problèmes en aval qui apparaissent comme des défaillances côté frontend — rendant la cause racine difficile à localiser sans visibilité interne. La surveillance des API internes permet aux équipes d’isoler si la défaillance se situe au niveau de la couche API, du microservice en aval, ou de la base de données. En savoir plus sur la surveillance via Agent Privé derrière votre pare-feu.

Bonnes pratiques de surveillance des API

Ces pratiques réduisent le temps moyen de détection (MTTD), améliorent la précision des alertes, et garantissent que la couverture de surveillance correspond au risque en production.

- Surveillez à des intervalles d’une minute pour les points de terminaison critiques pour les revenus. Pour les APIs de paiement, d’authentification, et de données principales, chaque minute non détectée a un impact commercial direct. Des intervalles de 5 ou 15 minutes sont acceptables pour les points moins critiques.

- Effectuez les vérifications depuis au moins 5 emplacements géographiquement répartis. Un seul emplacement de surveillance ne peut pas détecter les échecs DNS régionaux, les mauvaises configurations CDN, ou les problèmes de routage géo-spécifiques. Au minimum, couvrir l’Amérique du Nord, l’Europe, et l’Asie-Pacifique.

- Validez le contenu de la charge utile, pas seulement les codes d’état. Configurez des assertions JSONPath pour chaque point de terminaison critique. Les défaillances silencieuses les plus coûteuses sont les API retournant un HTTP 200 avec des données incomplètes, obsolètes ou malformées.

- Utilisez des seuils d’alerte dérivés des valeurs de référence, pas des valeurs statiques en millisecondes. Établissez une base de temps de réponse par point de terminaison et configurez les alertes à 2× la valeur P95. Les seuils statiques génèrent des faux positifs lors des pics normaux de trafic.

- Incluez l’authentification dans vos chaînes de surveillance. L’expiration des jetons, les échecs de rafraîchissement OAuth et la rotation des certificats sont des causes principales de pannes d’API. La surveillance des étapes d’authentification détecte les échecs liés aux identifiants avant qu’ils ne se propagent.

- Créez des moniteurs de transaction en plusieurs étapes pour chaque parcours utilisateur critique. Les flux de connexion, les séquences de paiement et les workflows de soumission de données sont des appels d’API en chaîne. Les moniteurs à point de terminaison unique ne peuvent pas détecter les défaillances entre étapes causées par un passage incorrect de données ou une gestion de session erronée.

- Surveillez les dépendances API tierces comme des moniteurs séparés. Créez des moniteurs dédiés pour Stripe, Okta, Salesforce et autres dépendances externes. Cela permet de savoir immédiatement si une défaillance est interne ou externe.

- Importez des collections Postman ou Insomnia pour démarrer la surveillance. Convertissez les définitions API existantes en moniteurs de production 24/7 sans recréer les structures de requête. Cela élimine l’écart entre les tests en phase de développement et la surveillance en production.

- Intégrez les vérifications d’API post-déploiement dans les pipelines CI/CD. Exécutez des vérifications API synthétiques comme tests automatisés de fumée après chaque déploiement. En cas d’échec des vérifications post-déploiement, envisagez un rollback automatisé ou une mise en pause du trafic dans les configurations de livraison progressive (blue/green ou canary) — en utilisant des exécutions de confirmation depuis un second emplacement pour réduire les faux positifs avant d’entreprendre toute action automatisée.

- Dirigez les alertes vers PagerDuty, Slack ou Microsoft Teams avec des politiques d’escalade. La notification par email seulement crée un délai de détection. Les intégrations natives avec les outils de gestion des incidents garantissent que les alertes atteignent immédiatement la bonne personne, avec des parcours d’escalade définis en cas de non-réponse.

Défis de la surveillance des API

Même les configurations de surveillance bien conçues font face à des défis opérationnels. Les anticiper aide les équipes à concevoir en conséquence.

Visibilité des API tierces

La surveillance des dépendances externes vous donne des données de disponibilité et de latence, mais ne peut pas révéler la cause interne d’une dégradation. Lorsqu’un ralentissement de Stripe ou Okta se produit, vous pouvez le confirmer et isoler le périmètre d’impact — mais l’analyse de la cause racine dépend des pages de statut du fournisseur et des procédures d’escalade du support.

Limitation du débit

Les agents de surveillance comptent dans les limites de débit de votre API. Le volume total des requêtes synthétiques s’échelonne comme suit : emplacements × vérifications par heure × appels API par exécution de moniteur × tentatives de confirmation. Pour un moniteur à point de terminaison unique : 30 emplacements × 60 vérifications/heure = 1 800 requêtes/heure. Pour un moniteur de transaction à 5 étapes avec les mêmes paramètres : 30 × 60 × 5 = 9 000 requêtes/heure par moniteur. Prenez cela en compte dans le budget des limites de débit, en particulier pour les APIs internes aux seuils plus stricts. Assurez-vous que les plages IP de votre fournisseur de surveillance sont sur liste blanche lorsque nécessaire.

Complexité de l’authentification

Les APIs utilisant des jetons à durée de vie courte nécessitent des outils de surveillance capables de gérer automatiquement le rafraîchissement des jetons. Les jetons OAuth 2.0 délégués par utilisateur (flux Code d’autorisation) expirent généralement entre 15 minutes et 1 heure ; les jetons Client Credentials machine-à-machine durent souvent de 1 à 24 heures ; les environnements à haute sécurité peuvent imposer des fenêtres de 5 minutes. L’authentification basée sur certificat et les clés API tournantes demandent aussi une gestion rigoureuse des identifiants.

Réponses dynamiques et non déterministes

Les APIs retournant des données horodatées, des résultats paginés ou des tableaux ordonnés aléatoirement sont difficiles à valider via des correspondances de valeurs exactes. Utilisez des expressions JSONPath qui valident la structure, la présence des champs et les types de champs — plutôt que des valeurs exactes qui changent à chaque requête.

Fatigue d’alerte

Une surveillance excessive — trop de points de terminaison avec des intervalles d’1 minute, ou des seuils trop stricts — génère du bruit qui désensibilise les équipes aux alertes réelles. Utilisez une surveillance à paliers : 1 minute pour les chemins critiques, 5 à 15 minutes pour les points non critiques. Confirmez les alertes depuis un emplacement secondaire avant de déclencher des notifications afin d’éliminer les faux positifs temporaires.

Diversité des protocoles

REST, SOAP, GraphQL, gRPC, et WebSocket nécessitent chacun des stratégies d’assertion différentes. Un outil qui ne gère que REST manquera les défaillances des services SOAP et rapportera incorrectement les erreurs GraphQL comme réussies car ils renvoient un HTTP 200.

Comment configurer la surveillance API avec Dotcom-Monitor

Dotcom-Monitor fournit une surveillance synthétique d’API pour REST, SOAP et GraphQL depuis plus de 30 emplacements mondiaux, avec des intervalles de vérification d’1 minute, prise en charge des transactions multi-étapes et intégrations natives avec PagerDuty, Slack, and Microsoft Teams.

Étape 1 — Définissez votre point de terminaison et vos assertions

- URL du point de terminaison : Le point de terminaison de l’API à surveiller

- Méthode HTTP : GET, POST, PUT, PATCH ou DELETE

- En-têtes de la requête :

Content-Type,Authorizationet tous les en-têtes personnalisés requis - Corps de la requête : Charge utile JSON pour les requêtes POST/PUT

- Authentification : OAuth 2.0, Bearer Token, clé API, Basic Auth, mTLS, AWS Signature v4, NTLM, Kerberos ou en-têtes personnalisés

- Assertions : Code de statut HTTP, seuil de temps de réponse, valeurs des en-têtes, assertions de charge utile JSONPath/XPath

Étape 2 — Importer depuis Postman ou Insomnia

Si votre équipe utilise Postman ou Insomnia, évitez entièrement la configuration manuelle du point de terminaison :

- Postman : Exportez votre Collection au format JSON v2.0 ou v2.1 et importez-la dans Dotcom-Monitor. Les définitions de requête, les en-têtes, le corps, les variables d’environnement et les assertions de test sont conservés.

- Insomnia : Exportez votre espace de travail sous forme de fichier JSON Insomnia v4 et importez-le dans Dotcom-Monitor. Les groupes de requêtes, configurations d’authentification et variables d’environnement sont conservés.

Les deux formats d’importation transforment des tests ponctuels en surveillances de production continues programmées 24/7 sans reconfiguration.

Vous utilisez déjà Postman ? Il ne vous reste que 5 minutes avant une surveillance de production 24/7.

Importez votre Collection Postman existante directement dans Dotcom-Monitor. Vos définitions de requêtes, en-têtes, variables d’environnement et assertions sont conservées — aucune reconfiguration nécessaire.

Étape 3 — Configurez les emplacements et la fréquence de surveillance

- Fréquence de vérification : Intervalles de 1, 3, 5 ou 15 minutes — définis par point de terminaison selon la criticité

- Emplacements de surveillance : Sélectionnez parmi plus de 30 sites en Amérique du Nord, Europe, Asie-Pacifique et Amérique du Sud

- Agent Privé : Pour les API internes ou derrière un pare-feu — déployez l’agent sur site ou dans votre cloud privé (Windows et Linux supportés). L’agent initie uniquement des connexions sortantes — aucune règle de pare-feu entrante requise.

- Reprises de confirmation : Configurez une vérification de confirmation secondaire à un autre emplacement avant le déclenchement des alertes, pour éliminer les faux positifs transitoires du réseau

Étape 4 — Configurez le routage des alertes

- PagerDuty : Acheminer les alertes critiques directement vers les plannings d’astreinte avec création et escalade d’incidents automatiques

- Slack / Microsoft Teams : Publier des messages d’alerte avec détails du point de terminaison, type d’erreur et données de réponse vers les canaux opérationnels

- Email, SMS, Phone call: Configurez les préférences de notification par contact ou par équipe

- Webhook : Intégrez avec OpsGenie, ServiceNow ou tout service compatible HTTP

- Configuration des seuils : Définissez les conditions d’alerte par métrique — temps de réponse, taux d’erreur, taux d’échec d’assertion — avec niveaux de gravité

Étape 5 — Intégration du pipeline CI/CD

- Dotcom-Monitor REST API : Créez, mettez à jour et déclenchez des tâches de surveillance de façon programmatique via des appels API HTTP depuis n’importe quel système CI/CD

- GitHub Actions / Azure DevOps / Jenkins : Ajoutez une étape post-déploiement qui déclenche une vérification Dotcom-Monitor, attend les résultats et échoue le pipeline si des assertions échouent

- Validation pré-production : Exécutez les mêmes contrôles synthétiques sur votre environnement de staging avant de promouvoir les builds en production — détectez les régressions avant qu’aucun utilisateur ne soit impacté

Cas d’utilisation de la surveillance API par secteur

| Secteur | APIs critiques à surveiller | Exigences clés de surveillance |

|---|---|---|

| E-commerce | Passage en caisse, autorisation de paiement, inventaire, expédition, gestion du panier | Chaînes de transactions multi-étapes ; intervalles d’1 minute ; assertion du contenu sur le statut de confirmation de paiement |

| FinTech / Banque | Traitement des transactions, vérification KYC/AML, solde de compte, taux de change, APIs de virement bancaire | SLA de latence inférieure à 200 ms ; contrôles conformes pour preuves PCI DSS ; validation complète du flux d’authentification |

| Santé | Intégrations DSE (HL7 FHIR), portails d’assurance, points d’accès télémédecine, planification des patients | Contrôles conformes pour preuves HIPAA ; validation du contenu pour l’exhaustivité des données ; SLA de disponibilité à 99,99 % |

| SaaS | APIs cœur de produit, points de réception de webhooks, APIs d’intégration partenaire, APIs d’authentification | Respect des SLA API-as-a-Product ; import Postman pour cohérence dev-vers-surveillance ; surveillance des dépendances tierces |

| IT d’Entreprise | CRM, ERP, HRIS, fournisseur d’identité, APIs d’automatisation des workflows internes | Agent privé pour APIs derrière pare-feu ; support d’auth NTLM/Kerberos ; visibilité API inter-départementale |

| Média / Jeux | APIs de livraison de contenu CDN, authentification, score en temps réel, APIs de fonctionnalités sociales | Surveillance géographique distribuée ; surveillance de connexion WebSocket ; détection des pics de trafic |

Commencez à surveiller vos APIs dès aujourd’hui.

Dotcom-Monitor fournit une surveillance synthétique des APIs depuis plus de 30 emplacements mondiaux, avec des vérifications toutes les 1 minuteintervalles, prise en charge des transactions multi-étapes, et intégrations natives avec PagerDuty, Slack et Microsoft Teams. La configuration prend moins de 5 minutes. Aucune carte de crédit requise pour l’essai de 30 jours.