Les API sont au cœur des applications modernes. Elles alimentent les applications mobiles, connectent les microservices et permettent les intégrations tierces, ce qui les rend critiques pour la performance, la fiabilité et les revenus. C’est pourquoi la plupart des équipes investissent massivement dans des outils de test d’API comme Postman, des suites de tests automatisées et des testeurs d’API en ligne.

Les API sont au cœur des applications modernes. Elles alimentent les applications mobiles, connectent les microservices et permettent les intégrations tierces, ce qui les rend critiques pour la performance, la fiabilité et les revenus. C’est pourquoi la plupart des équipes investissent massivement dans des outils de test d’API comme Postman, des suites de tests automatisées et des testeurs d’API en ligne.

Et pourtant, des pannes en production continuent de se produire.

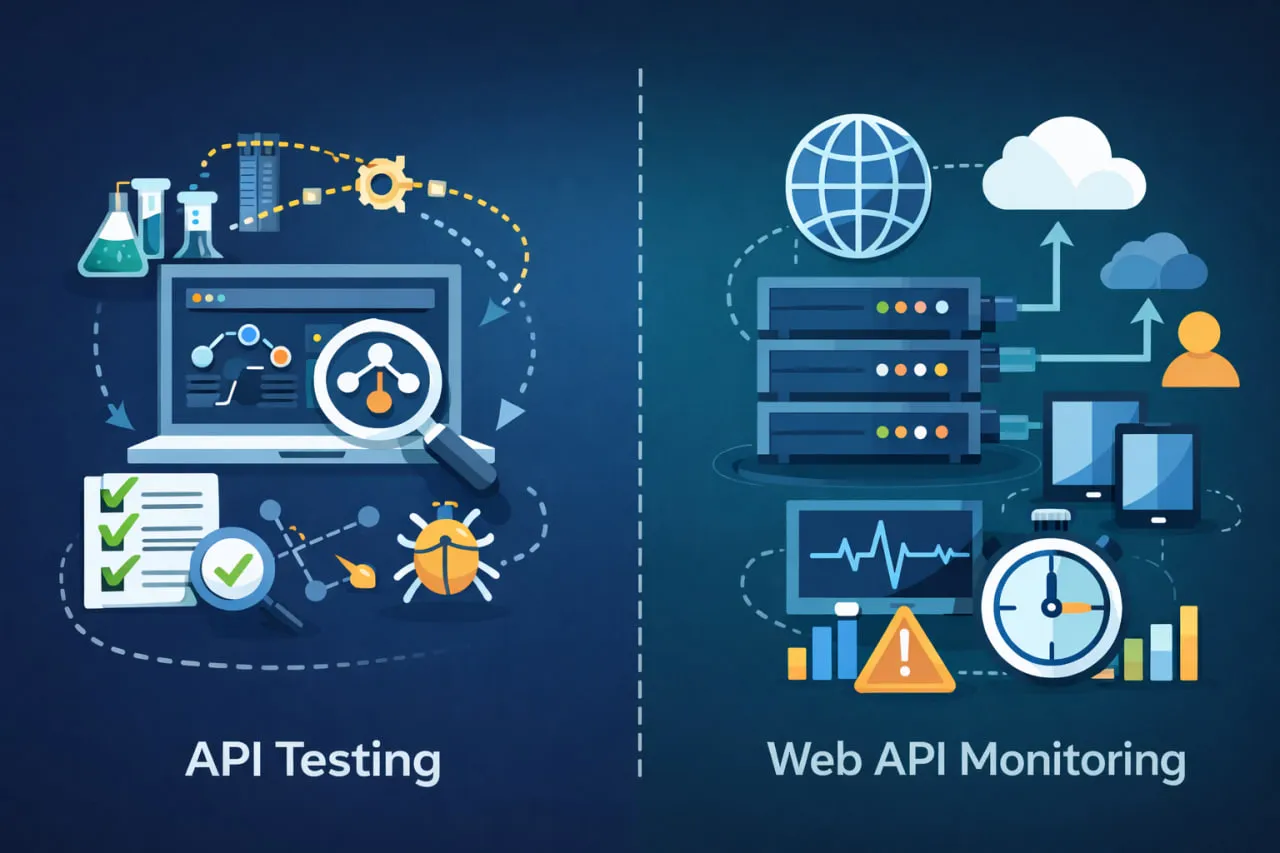

Cette dissonance (« nos API ont été testées, alors pourquoi ont-elles échoué ? ») est là où commence la confusion entre les tests d’API et la surveillance des Web API. Bien que liés, ils répondent à des objectifs différents à des étapes distinctes du cycle de vie des API.

Les tests d’API se concentrent sur la validation des endpoints avant la mise en production. Ils aident les équipes à confirmer la conformité, à faire respecter les contrats et à détecter les problèmes tôt dans des environnements contrôlés. La surveillance des Web API, en revanche, valide en continu les API après le déploiement, depuis l’extérieur, dans des conditions réelles.

Traiter ces approches comme interchangeables crée des angles morts une fois les API en production. Les vérifications manuelles, les exécutions de tests planifiées ou les simples pings de disponibilité ne sont pas conçus pour offrir une visibilité continue de niveau production.

Dans cet article, nous comparerons tests d’API vs surveillance des Web API, expliquerons où s’inscrivent des outils comme Postman et les testeurs d’API en ligne, et montrerons pourquoi les API en production nécessitent une validation externe continue. Nous verrons également comment les équipes complètent les tests par la surveillance des Web API afin de maintenir la fiabilité lorsque les utilisateurs dépendent de leurs API.

Qu’est-ce que le test d’API ?

Le test d’API est la pratique consistant à valider les interfaces de programmation d’applications (API) au niveau de la couche message, sans s’appuyer sur une interface graphique. Au lieu de naviguer dans des écrans, les équipes envoient des requêtes directement vers les endpoints de l’API et évaluent les réponses (codes de statut, en-têtes, charges utiles et caractéristiques de performance) afin de confirmer que l’API se comporte comme prévu.

À la base, le test d’API répond à une question simple : « Cet endpoint fonctionne-t-il correctement dans des conditions connues ? »

Pour les équipes de développement et de QA, cela fait du test d’API un élément essentiel de la création de logiciels fiables. Les API se situent souvent sous les interfaces utilisateur et les intégrations, de sorte que détecter les problèmes tôt, avant qu’ils ne se propagent dans une application, est à la fois plus rapide et moins coûteux que de déboguer des défaillances plus tard.

Où le test d’API s’inscrit dans le cycle de vie

Le test d’API est le plus efficace avant le déploiement, durant les phases de développement et de pré-production. Les cas d’usage typiques incluent :

- Vérifier que les endpoints renvoient des réponses correctes pour des requêtes valides

- S’assurer que la gestion des erreurs fonctionne pour des entrées invalides ou inattendues

- Confirmer que les contrats d’API (schémas, champs obligatoires, formats) sont respectés

- Vérifier les performances de base dans des conditions contrôlées

Comme les API changent rarement de manière isolée, les tester tôt aide les équipes à identifier les problèmes avant qu’ils n’affectent les services en aval, les applications front-end ou les clients.

C’est aussi pour cette raison que les tests d’API sont étroitement intégrés aux pipelines CI/CD modernes. Les tests d’API automatisés peuvent s’exécuter à chaque commit ou build, fournissant un retour rapide aux développeurs et empêchant les régressions d’atteindre la production.

Types courants de tests d’API

Bien que le terme « tests d’API » soit souvent utilisé de manière générale, il englobe en réalité plusieurs approches distinctes, chacune répondant à un objectif spécifique :

- Tests unitaires

Se concentrent sur des endpoints ou des fonctions individuels, en validant qu’une requête unique produit la réponse correcte. - Tests d’intégration

Vérifient que les API fonctionnent correctement lorsqu’elles sont combinées avec d’autres services, bases de données ou systèmes externes. - Tests de contrat

Garantissent que les API respectent des structures de requêtes et de réponses convenues afin que les changements ne cassent pas les consommateurs. - Tests fonctionnels

Confirment que les API répondent aux exigences métier et exécutent les actions attendues. - Tests de performance et de charge

Évaluent les temps de réponse et le comportement sous des niveaux de trafic simulés. - Tests de sécurité

Vérifient les vulnérabilités telles qu’une mauvaise gestion de l’authentification, des autorisations manquantes ou des expositions de données.

Toutes ces approches sont précieuses, mais elles partagent une limite importante : elles sont généralement exécutées dans des environnements contrôlés, avec des identifiants connus, des réseaux stables et des entrées prévisibles.

Pourquoi le test d’API seul a des limites

Le test d’API est conçu pour valider la conformité, pas pour fournir une assurance continue une fois les API en production. Les tests s’exécutent généralement :

- Dans des environnements de développement ou de staging

- À la demande ou selon un calendrier

- Depuis l’infrastructure interne de l’organisation

Par conséquent, le test d’API ne tient pas compte de nombreuses variables du monde réel, telles que la latence réseau entre régions, les défaillances intermittentes de tiers ou les changements survenant après le déploiement. C’est là que la confusion apparaît souvent. Les équipes supposent que parce que les API ont été testées, elles sont intrinsèquement fiables en production.

Elles ne le sont pas — et ce n’est pas un échec des tests. Ce n’est tout simplement pas ce pour quoi le test d’API a été conçu.

Pour comprendre où les tests s’arrêtent et où commence la responsabilité en production, il est utile de clarifier d’abord le type d’API concerné — qu’il s’agisse d’une API HTTP, d’une API REST ou d’une Web API — et la manière dont elles sont exposées aux consommateurs

Outils de test d’API : Postman, testeurs en ligne et leurs points forts

Une fois que les équipes comprennent ce que les tests d’API visent à accomplir, la question suivante est généralement pratique : quels outils utiliser ? Pour la plupart des développeurs et ingénieurs QA, la réponse commence avec Postman et s’étend à une gamme d’outils de test d’API en ligne et de clients HTTP légers. Ces outils dominent les résultats de recherche — et pour de bonnes raisons. Ils sont accessibles, flexibles et extrêmement efficaces dans leur périmètre prévu.

Ce qui est important, cependant, c’est de comprendre où ces outils excellent et où ils s’arrêtent. Les outils de test d’API sont conçus pour vous aider à valider les API pendant le développement et la pré-production, pas pour fournir une protection continue une fois les API en production.

Postman : le point de départ par défaut pour les tests d’API

Postman est devenu synonyme de test d’API. Il permet aux équipes d’envoyer rapidement des requêtes, d’inspecter les réponses, de gérer des environnements et d’automatiser des collections de tests. Pour les développeurs, c’est souvent le moyen le plus rapide de répondre à des questions telles que :

- Cet endpoint renvoie-t-il les bonnes données ?

- Les en-têtes et codes de statut sont-ils correctement définis ?

- Cette requête échoue-t-elle correctement avec des entrées invalides ?

La force de Postman réside dans la validation manuelle et automatisée. Les développeurs peuvent chaîner des requêtes, utiliser des variables et intégrer des collections dans des pipelines CI afin de détecter les régressions tôt. Cela fait de Postman un excellent outil de collaboration entre développeurs et équipes QA pendant le développement actif.

Cela dit, Postman est fondamentalement un client de test. Les tests sont exécutés lorsque quelqu’un les lance — manuellement ou selon un calendrier — et généralement depuis des environnements contrôlés. Une fois les API déployées, Postman ne valide pas en continu la disponibilité ou la performance depuis l’extérieur. Les équipes qui s’appuient uniquement sur Postman comblent souvent cette lacune par des vérifications ad hoc ou des scripts, en supposant que les tests suffisent à garantir la fiabilité.

C’est cette supposition qui crée des angles morts en production.

Outils de test d’API en ligne et clients HTTP

Au-delà de Postman, de nombreuses équipes expérimentent des outils de test d’API en ligne ou basés sur le navigateur. Ces outils facilitent :

- L’envoi rapide de requêtes HTTP sans installer de logiciel

- La validation des endpoints lors du débogage

- La réalisation de vérifications ponctuelles sur des API publiques

Les clients HTTP en ligne sont particulièrement utiles pour le dépannage ou pour comprendre le comportement d’une API. Ils abaissent la barrière à l’entrée et sont souvent les premiers outils utilisés par les ingénieurs juniors ou les équipes produit.

Cependant, comme Postman, ces outils sont transactionnels et réactifs. Ils répondent à « cette requête fonctionne-t-elle maintenant ? », mais ne fournissent aucun contexte historique, aucune alerte et aucune visibilité continue. Ils ne sont pas conçus pour surveiller les API dans le temps ni pour détecter les dégradations avant que les utilisateurs ne les remarquent.

Cette distinction devient plus claire lorsqu’on compare les approches clients HTTP en ligne vs surveillance des Web API, où la seconde se concentre sur une validation automatisée et répétable plutôt que sur des tests ponctuels.

Pourquoi les outils de test ne couvrent pas la réalité de la production

Le point commun entre Postman et les outils de test d’API en ligne est l’intention. Ils sont conçus pour aider les humains à tester des API, pas pour agir comme des observateurs permanents des systèmes en production. En conséquence :

- Les tests s’exécutent depuis des emplacements prévisibles

- L’authentification est généralement statique et contrôlée

- Les défaillances ne sont découvertes que lorsque quelqu’un vérifie

En production, les API se comportent différemment. Les chemins réseau changent, les identifiants expirent, les dépendances ralentissent et les schémas de trafic fluctuent. Les outils de test ne tiennent pas compte de ces variables parce qu’ils n’ont pas été conçus pour cela.

C’est là que les équipes commencent à regarder au-delà des outils de test et à se tourner vers la surveillance continue des Web API, qui valide automatiquement les API, depuis des emplacements externes et sans intervention manuelle. Plutôt que de remplacer Postman ou les testeurs en ligne, la surveillance les complète en prenant le relais une fois les API en production.

Des plateformes comme Dotcom-Monitor sont souvent introduites à ce stade — non pas comme des outils de test, mais comme des systèmes de surveillance qui vérifient en continu la disponibilité et le comportement des réponses des API en production.

Qu’est-ce que la surveillance des Web API ?

La surveillance des Web API est la pratique consistant à valider en continu les API après leur déploiement en production. Au lieu d’exécuter des tests à la demande, la surveillance lance automatiquement des vérifications d’API, selon un calendrier, afin de confirmer que les endpoints restent disponibles, réactifs et fonctionnels dans des conditions réelles.

Là où le test d’API demande « cet endpoint fonctionne-t-il dans un environnement contrôlé ? », la surveillance des Web API demande « cette API fonctionne-t-elle maintenant pour de vrais utilisateurs ? » Ce changement, de la validation avant mise en production à la vérification continue en production, constitue la distinction fondamentale.

La surveillance des Web API se concentre sur des questions opérationnelles, telles que :

- L’API est-elle accessible depuis l’extérieur de l’environnement applicatif ?

- Les temps de réponse se dégradent-ils au fil du temps ?

- Des erreurs se produisent-elles de manière intermittente ou continue ?

Comme ces vérifications s’exécutent en continu, elles génèrent des données historiques que les équipes peuvent utiliser pour identifier des tendances, corréler des incidents et comprendre le comportement des API dans le temps, ce que les tests ponctuels et les vérifications manuelles ne peuvent pas fournir.

Surveiller les API là où les utilisateurs les utilisent

Une caractéristique déterminante de la surveillance des Web API est qu’elle s’exécute de manière externe, depuis des emplacements situés hors de votre infrastructure. Cette perspective de l’extérieur vers l’intérieur reflète la manière dont les API sont réellement consommées par les utilisateurs, les partenaires et les systèmes intégrés, plutôt que leur comportement dans des environnements de test internes.

La surveillance moderne des Web API est généralement mise en œuvre via le monitoring synthétique, où des requêtes d’API répétables sont exécutées à intervalles réguliers et validées par rapport à des réponses attendues. Cette approche permet aux équipes de détecter tôt les problèmes de disponibilité et de performance, souvent avant que les clients ne soient affectés.

Une fois les API en production, de nombreuses équipes introduisent des plateformes de surveillance dédiées, telles que Dotcom-Monitor, pour compléter leurs outils existants de test d’API. Ces plateformes ne visent pas à remplacer Postman ou les tests basés sur le CI, mais à prendre en charge la fiabilité continue en production.

Pour une explication plus approfondie du fonctionnement pratique, vous pouvez consulter notre guide complet expliquant le fonctionnement de la surveillance des Web API, qui couvre la configuration, l’exécution et les cas d’usage courants plus en détail.

Tests d’API vs Surveillance des Web API : la différence pratique

Les tests d’API et la surveillance des Web API interagissent tous deux avec des endpoints d’API, mais ils interviennent à des moments différents du cycle de vie des API. La confusion survient lorsque les équipes attendent des outils de test qu’ils fournissent des garanties de production pour lesquelles ils n’ont jamais été conçus.

Les tests d’API concernent la validation avant mise en production. Les équipes utilisent des outils comme Postman ou des suites de tests automatisées pour confirmer que les endpoints renvoient des réponses correctes, respectent les contrats et gèrent des cas limites connus dans des environnements contrôlés.

La surveillance des Web API concerne la garantie continue après le déploiement. Une fois les API en production, la priorité passe de la conformité à la fiabilité, en confirmant que les endpoints restent accessibles, performants et fonctionnels dans des conditions réelles.

En résumé :

- Les tests demandent : « Cette API fonctionne-t-elle comme prévu ? »

- La surveillance demande : « Cette API fonctionne-t-elle maintenant ? »

Cette distinction devient cruciale en production, où les API sont affectées par des réseaux externes, des authentifications expirées et des dépendances tierces. C’est pourquoi de nombreuses équipes considèrent la surveillance comme le prolongement opérationnel des tests, et non comme un remplacement.

Un schéma courant consiste à continuer d’utiliser Postman et les tests CI pendant le développement, puis à introduire le monitoring synthétique en production afin de valider les API en continu depuis l’extérieur de l’environnement applicatif. Cette approche aide les équipes à détecter les problèmes plus tôt et à renforcer la confiance dans les performances des API lorsque les utilisateurs en dépendent.

Si vous souhaitez une analyse plus approfondie de la partie surveillance, vous pouvez en savoir plus sur le fonctionnement de la surveillance des Web API et sur la manière dont elle s’intègre aux workflows de test existants.

Pourquoi les tests d’API passent mais que les API échouent encore en production

Pour de nombreuses équipes, les incidents d’API les plus déroutants surviennent lorsque tout semblait correct auparavant. Les tests étaient au vert. Les builds ont réussi. Rien d’évident n’a changé. Et pourtant, les utilisateurs ont rencontré des défaillances.

Ce n’est pas une contradiction, c’est un manque de visibilité.

Tests contrôlés vs conditions réelles

Les outils de test d’API valident le comportement dans des environnements prévisibles. Les requêtes sont envoyées depuis des emplacements connus, avec des identifiants stables, vers des systèmes qui ne sont pas encore soumis à une pression de trafic réel. C’est exactement ce pour quoi les tests sont conçus.

La production, en revanche, introduit des variables que les tests modélisent mal :

- Différences de routage réseau entre régions

- Jetons d’authentification expirés ou renouvelés

- Comportement des CDN, pare-feu ou proxys

- Latence ou défaillances des dépendances tierces

Une API peut réussir tous les tests et néanmoins échouer lorsqu’elle est exposée à de vrais utilisateurs via l’internet public.

Le problème « tests verts, utilisateurs rouges »

Un autre problème courant concerne le timing. Les tests d’API s’exécutent généralement :

- Pendant le développement

- Dans le cadre du CI/CD

- À la demande ou selon un calendrier

Entre ces exécutions, beaucoup de choses peuvent changer. Une dépendance ralentit. Un certificat expire. Une configuration dérive. Sans validation continue, ces problèmes restent invisibles jusqu’à ce que les clients soient affectés.

C’est pourquoi les équipes réalisent souvent (trop tard) que les tests seuls n’offrent pas une couverture opérationnelle suffisante.

Là où la surveillance continue comble l’écart

C’est ici que la surveillance des Web API devient essentielle. En exécutant des vérifications d’API en continu et de manière externe, les équipes peuvent valider la disponibilité et le comportement des réponses dans les mêmes conditions que celles vécues par les utilisateurs. De nombreuses organisations ajoutent cette couche après des incidents initiaux en production, en utilisant des plateformes comme Dotcom-Monitor pour compléter leur pile de tests existante plutôt que de la remplacer.

La surveillance n’empêche pas l’écriture de bugs, mais elle empêche les défaillances silencieuses de passer inaperçues.

Si vos API sont orientées client ou critiques pour les revenus, cette visibilité de l’extérieur vers l’intérieur fait souvent la différence entre réagir aux plaintes et détecter les problèmes tôt.

Pour comprendre comment cette validation en production est mise en œuvre concrètement, il est utile d’examiner en quoi les clients HTTP en ligne diffèrent de la surveillance des Web API une fois les API en production.

Comment la surveillance des Web API complète Postman et les outils de test d’API

Postman et les outils de test d’API similaires sont indispensables pendant le développement. Ils aident les équipes à concevoir des requêtes, à valider des réponses et à automatiser des vérifications dans les pipelines CI. Mais une fois les API déployées, le rôle de ces outils diminue naturellement.

C’est là que la surveillance des Web API intervient, non pas comme un remplacement de Postman, mais comme son équivalent en production.

De la validation en développement à l’assurance en production

Un workflow courant ressemble à ceci :

- Les équipes utilisent Postman pour tester les endpoints pendant le développement

- Des tests d’API automatisés s’exécutent en CI pour détecter les régressions

- Les API sont déployées et commencent à servir de vrais utilisateurs

À ce stade, les tests Postman existent toujours, mais ils ne répondent plus à la question la plus urgente : cette API fonctionne-t-elle pour les utilisateurs en ce moment ?

En passant de Postman à la surveillance des Web API, les équipes étendent leur couverture à la production. Au lieu d’exécuter manuellement des collections ou de s’appuyer sur des vérifications sporadiques, la surveillance valide en continu les endpoints en production depuis l’extérieur de l’environnement applicatif.

Ce que la surveillance apporte que les outils de test n’offrent pas

Utilisés conjointement, les tests et la surveillance créent une répartition claire des responsabilités :

- Postman valide la conformité avant la mise en production

- La surveillance des Web API valide la disponibilité et la performance après la mise en production

Les plateformes de surveillance exécutent des vérifications répétables selon un calendrier, suivent le comportement des réponses dans le temps et signalent automatiquement les problèmes. Cela est particulièrement précieux pour les API qui prennent en charge des fonctionnalités orientées client, des intégrations ou des workflows critiques pour les revenus.

De nombreuses équipes adoptent à ce stade des outils de surveillance dédiés, tels que Dotcom-Monitor, afin d’obtenir une visibilité externe continue sur les API en production sans modifier leur manière de tester en développement.

Si vos API sont déjà bien testées, ajouter la surveillance est souvent le moyen le plus rapide de réduire les angles morts et de passer d’un dépannage réactif à une détection proactive.

Pour les équipes prêtes à franchir cette étape, il est utile d’examiner de plus près la conception des outils de surveillance de niveau production et ce qu’ils offrent au-delà des tests de développement.

Monitoring synthétique pour les API en production

Une fois les API déployées, les équipes ont besoin d’un moyen de les valider en continu, sans dépendre de vérifications manuelles ou d’exécutions de tests planifiées. C’est là que le monitoring synthétique devient un complément pratique aux tests d’API.

Le monitoring synthétique utilise des requêtes d’API prédéfinies qui s’exécutent selon un calendrier afin de confirmer la disponibilité et le comportement des réponses dans le temps. Comme les mêmes requêtes s’exécutent de manière cohérente, les équipes peuvent rapidement détecter des changements, des défaillances ou des dégradations de performance dans les environnements de production.

Contrairement aux tests de développement, le monitoring synthétique s’exécute généralement en dehors de l’environnement applicatif, offrant une visibilité sur le comportement des API à travers des réseaux et des conditions réels. Cette perspective externe permet de mettre en évidence des problèmes que les tests internes manquent souvent.

De nombreuses équipes mettent en œuvre cette approche à l’aide de plateformes de surveillance orientées production telles que Dotcom-Monitor. Plutôt que de remplacer des outils comme Postman, le monitoring synthétique prend le relais une fois les API en production, garantissant leur fiabilité à mesure que les utilisateurs et les intégrations en dépendent.

Au fil du temps, les vérifications continues alimentent des tableaux de bord et rapports qui montrent les tendances de disponibilité et les performances historiques, transformant des résultats de tests isolés en informations opérationnelles exploitables.

De la surveillance à la visibilité : tableaux de bord, rapports et adoption opérationnelle

Détecter un problème d’API n’est que la première étape. Ce qui détermine la capacité des équipes à agir rapidement et à expliquer ce qui s’est passé ensuite, c’est la visibilité. C’est là que la surveillance des Web API dépasse les simples vérifications et alertes pour devenir un outil opérationnel pour l’ingénierie et la direction.

La surveillance continue produit des données dans le temps, et pas seulement des résultats ponctuels. Lorsque ces données sont organisées dans des tableaux de bord et rapports, les équipes peuvent comprendre le comportement quotidien des API, et pas uniquement lorsqu’un incident survient. Les tendances de disponibilité, les schémas de temps de réponse et l’historique des incidents facilitent la réponse à des questions telles que « s’agit-il d’un incident ponctuel ou récurrent ? » et « la performance a-t-elle changé après un déploiement ? »

Cette visibilité est particulièrement importante lorsque les API deviennent critiques pour l’activité. Les responsables de l’ingénierie et les dirigeants ont souvent besoin de preuves — et non de suppositions — lors de l’analyse des incidents ou des discussions sur la fiabilité avec les parties prenantes. Des plateformes de surveillance comme Dotcom-Monitor sont couramment utilisées à ce stade pour centraliser les résultats et les présenter de manière accessible au-delà de l’équipe d’ingénierie immédiate.

Opérationnaliser la surveillance des Web API

Adopter la surveillance des Web API ne nécessite pas de repenser la manière dont les équipes testent les API. Au contraire, la plupart des organisations étendent ce qu’elles possèdent déjà :

- Les tests d’API restent intégrés au développement et au CI

- La surveillance prend le relais après le déploiement

- Les résultats alimentent des tableaux de bord et des alertes partagés

Pour faciliter cette transition, les équipes commencent généralement par un petit nombre d’endpoints critiques et étendent la couverture au fil du temps. Des guides de configuration clairs et des workflows adaptés aident à garantir des vérifications cohérentes et répétables à mesure que la surveillance se développe.

Pour les équipes prêtes à passer d’une validation ad hoc à une visibilité opérationnelle, cette étape est souvent celle où la surveillance démontre sa valeur, transformant des vérifications brutes en informations exploitables et en confiance.

Consultez notre base de connaissances pour

Conclusion : quand les tests d’API s’arrêtent, la surveillance commence

Les tests d’API et la surveillance des Web API sont souvent abordés ensemble, mais comme cet article l’a montré, ils résolvent des problèmes différents à des étapes différentes du cycle de vie des API. Des outils de test comme Postman sont essentiels pour valider la conformité pendant le développement. Ils aident les équipes à avancer rapidement, à détecter les régressions tôt et à livrer avec confiance.

Mais une fois les API en production, la définition de « fonctionner » change.

En production, la fiabilité est façonnée par de vrais réseaux, de vrais utilisateurs et de vraies dépendances. C’est là que les tests s’arrêtent naturellement et que la surveillance des Web API prend le relais, en fournissant une validation externe continue garantissant que les API restent disponibles et réactives après le déploiement. Les équipes qui reconnaissent plus tôt cette transition ont tendance à détecter les problèmes plus rapidement, à réduire les angles morts et à passer moins de temps à réagir aux incidents signalés par les clients.

L’approche la plus efficace n’est pas de choisir entre tests ou surveillance. Il s’agit de les utiliser de manière intentionnelle : les tests pour valider les API avant la mise en production, et la surveillance pour les protéger lorsqu’elles deviennent essentielles pour les utilisateurs et l’activité.

Si vos API sont déjà bien testées et orientées client, l’étape suivante consiste à comprendre leur comportement en production — de manière cohérente et sans effort manuel. Pour découvrir comment cela fonctionne en pratique, vous pouvez découvrir notre logiciel de surveillance des Web API et la manière dont les équipes l’utilisent pour compléter leurs workflows existants de test d’API.