Monitoreo de API es la práctica continua y automatizada de validar los puntos finales de API para la disponibilidad, el tiempo de respuesta y la corrección de datos — confirmando no solo que un punto final responde, sino que devuelve los datos correctos, en el formato adecuado, dentro de una latencia aceptable, desde la perspectiva de los usuarios y los sistemas dependientes.

Las API son el tejido conectivo del software moderno. Cada vez que un usuario inicia sesión, realiza un pago o recibe una notificación en tiempo real, múltiples llamadas a API se ejecutan detrás de escena — frecuentemente a través de microservicios, proveedores de la nube y vendedores terceros. Cuando esas llamadas fallan o se ralentizan, el impacto es inmediato: procesos de compra rotos, usuarios bloqueados y pérdida de ingresos.

Sin embargo, la mayoría de los equipos solo descubren fallos en las API cuando los clientes los informan. Sin un monitoreo proactivo, el retraso entre la falla y la investigación suele medirse en decenas de minutos — tiempo suficiente para exponer riesgos reales de ingresos y SLA antes de que alguien sea notificado.

Esta guía explica qué es el monitoreo de API, cómo funciona, qué métricas rastrear, en qué se diferencia de las pruebas de API y APM, y cómo implementarlo — con la precisión que los ingenieros DevOps, SREs y equipos de QA necesitan para tomar decisiones informadas en producción.

¿Qué es el monitoreo de API?

El monitoreo de API cubre tres capas distintas de validación, en orden creciente de especificidad:

- Monitoreo de disponibilidad — ¿Está accesible el punto final? ¿Devuelve una respuesta HTTP sin tiempo de espera?

- Monitoreo de rendimiento — ¿Cuánto tarda la respuesta? ¿TTFB, resolución DNS o el handshake TLS introducen latencia?

- Validación de carga útil — ¿El cuerpo de la respuesta contiene la estructura de datos esperada? ¿Las aserciones JSONPath o XPath pasan?

¿Qué es un punto final de API?

Una interfaz de programación de aplicaciones (API) es un conjunto de protocolos y definiciones que permite a los sistemas de software comunicarse. Un punto final de API es la URL específica en la que una API recibe solicitudesy devuelve respuestas — la unidad de observación para el monitoreo de API. Por ejemplo:

POST /v2/auth/token— endpoint de emisión de tokenGET /v2/orders/{id}— endpoint de recuperación de pedidosPOST /v2/payments/charge— endpoint de procesamiento de pagos

Las aplicaciones modernas dependen simultáneamente de docenas o cientos de endpoints — microservicios internos, pasarelas de pago de terceros, proveedores de identidad, APIs de envío y sistemas CRM. El monitoreo de API mantiene la visibilidad a través de todos ellos.

Tipos de Monitoreo de API

No todo el monitoreo de API es igual. Entender las categorías ayuda a los equipos a construir una cobertura que coincida tanto con su arquitectura como con sus requisitos de negocio. Los cinco tipos principales se aplican a casi todos los equipos; los tipos especializados importan cuando sus condiciones se cumplen.

Tipos Principales

| Tipo | Lo que Valida | Ideal para |

|---|---|---|

| Monitoreo de Disponibilidad | Alcance del endpoint; códigos de respuesta HTTP; respuesta dentro de la ventana de tiempo límite | SLAs básicos de disponibilidad; detección inmediata de caídas |

| Monitoreo de Rendimiento | Tiempo de respuesta, TTFB, resolución DNS, handshake TCP, tiempo TLS, throughput | SLAs de latencia, objetivos P95/P99, planificación de capacidad |

| Monitoreo de Payload / Validación | Cuerpo de respuesta mediante aserciones JSONPath/XPath; corrección de esquema; valores de campo | Detección de fallas silenciosas donde HTTP 200 ≠ datos correctos |

| Monitoreo Sintético | Llamadas API simuladas desde ubicaciones globales en intervalos programados, independiente del tráfico real | Detección proactiva; cobertura geográfica; periodos sin tráfico |

| Monitoreo de Transacciones Multi-Paso | Secuencias encadenadas de llamadas API (ej., auth → query → submit → confirm); paso de datos entre pasos | Flujos de comercio electrónico, procesos de inicio de sesión, flujos de pedidos |

Tipos Especializados

| Tipo | Lo que Valida | Ideal para |

|---|---|---|

| Monitoreo de Seguridad | Fallos de autenticación, patrones anómalos de solicitudes, expiración de certificados, abuso de límite de tasa, reproducción de tokens | FinTech, salud; APIs que manejan PII/PHI |

| Revisiones Relacionadas con Cumplimiento | Validación de versión/cifrado TLS, expiración de certificados, presencia de encabezados de seguridad, pruebas de aplicación de autenticación | Salud, servicios financieros, industrias reguladas |

| Monitoreo de Usuario Real (RUM) | Interacciones reales de usuarios con APIs; visibilidad de sesión completa; variabilidad real geográfica y de dispositivo | >Comprender el verdadero impacto en el usuario; validar hallazgos sintéticos |

| Versionado y Monitoreo de Deprecación | Tasas de adopción de versiones de API; picos de errores tras cambios de versión; compatibilidad hacia atrás | Equipos que gestionan múltiples versiones de API simultáneamente |

| Monitoreo de Terceros / Integración | Dependencias de API externas (Stripe, Okta, Salesforce, Twilio); aislar fallos externos vs. internos | Cualquier aplicación que dependa de APIs de terceros para flujos de trabajo críticos |

Una nota sobre controles relacionados con cumplimiento: estos proporcionan evidencia de apoyo para controles técnicos específicos. El cumplimiento de marcos normativos (HIPAA, PCI DSS, SOC 2) requiere una gobernanza organizacional más amplia que la que el monitoreo por sí solo puede ofrecer.

Monitoreo Sintético vs. Monitoreo de Usuarios Reales (RUM)

Ambos enfoques proporcionan datos de performance de API, pero desde puntos de vista fundamentalmente diferentes:

| Monitoreo Sintético | Monitoreo de Usuarios Reales (RUM) | |

|---|---|---|

| Disparo | Chequeos guionizados según un horario (ejemplo, cada 1 minuto) | Solicitudes reales de usuarios en producción |

| Cobertura | Funciona 24/7 — incluyendo cuando no hay usuarios reales activos | Sólo genera datos cuando los usuarios están realizando solicitudes activamente |

| Detección | Proactivo — detecta fallos antes de que cualquier usuario sea impactado | Reactivo — saca a la superficie problemas después de que los usuarios ya están afectados |

| Alcance | APIs públicas y privadas/internas (vía Private Agent) | APIs alcanzadas por usuarios/clientes reales — principalmente orientadas al público, aunque RUM empresarial también puede capturar llamadas API internas de aplicaciones instrumentadas |

| Casos de uso | Validación continua de disponibilidad y rendimiento | Comprender el verdadero radio de impacto y la experiencia real del usuario |

Métricas clave de monitoreo de API

Rastrear las métricas correctas es la diferencia entre una respuesta informada a incidentes y la fatiga por alertas. A continuación, las métricas que más importan, con puntos de referencia precisos y lo que cada una indica.

| Métrica | Objetivo / Punto de referencia | Qué detecta |

|---|---|---|

| Disponibilidad (Uptime %) | ≥ 99.9% (tres nueves); 99.99% para APIs críticas de ingresos | Interrupción total, interrupción parcial, tiempo de espera |

| Tiempo total de respuesta | < 200ms para endpoints simples; < 1s para operaciones complejas | Retrasos del servidor, sobrecarga, regresiones por despliegues |

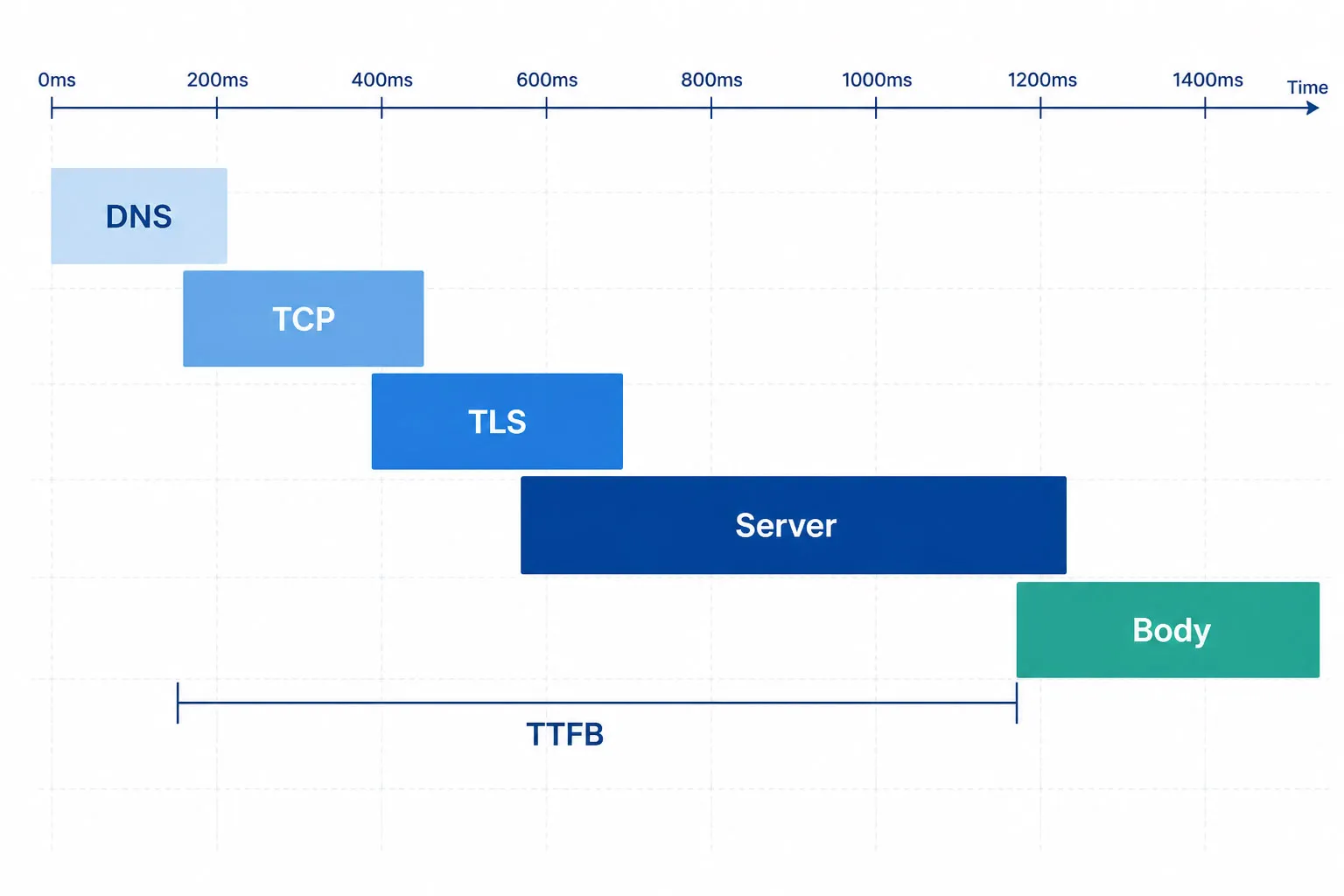

| Tiempo hasta el primer byte (TTFB) | < 100ms ideal; < 300ms aceptable | Retraso en el procesamiento del servidor antes de iniciar la respuesta |

| Tiempo de respuesta P95 / P99 | Alerta a 2× la línea base P95 por endpoint; ajusta según comportamiento del endpoint | Latencia extrema afectando al 1–5% más lento de las solicitudes |

| Tasa de error (4xx / 5xx) | < 0.1% para APIs en producción | Fallos de autenticación, manejo incorrecto de entradas, errores del servidor |

| Tiempo de resolución DNS | < 50ms para búsquedas cacheadas en la misma región; puede superar 100ms en regiones cruzadas | Problemas de propagación DNS, fallos en el resolvedor |

| Tiempo de handshake TLS | < 100ms | Mala configuración del certificado, problemas en la negociación de versión TLS |

| Tasa de aprobación de aserción de carga útil | 100% (alerta en cualquier fallo) | Fallos silenciosos: respuestas HTTP 200 con datos erróneos o faltantes |

| Rendimiento (req/seg) | Comparar con línea base histórica | Caídas inesperadas de tráfico o picos anormales |

| Vencimiento de certificado (días restantes) | Alerta a 30 días; crítico a 7 días | Vencimiento inminente del certificado TLS |

Puntos de referencia del tiempo de respuesta

¿Cómo Funciona la Monitorización de API?

Comprender la mecánica técnica ayuda a los equipos a configurar la monitorización correctamente e interpretar los resultados con precisión.

El Bucle Principal de Monitorización

- Programar. Se ejecuta una comprobación sintética en un intervalo configurado (por ejemplo, cada 1 minuto) desde una ubicación global de monitorización seleccionada.

- Enviar solicitud. El agente de monitorización envía una solicitud HTTP al endpoint objetivo — incluyendo el método HTTP (GET, POST, PUT, PATCH, DELETE), encabezados de la solicitud, credenciales de autenticación y cuerpo de la solicitud.

- Medir tiempo. El agente registra el tiempo de resolución DNS, tiempo de conexión TCP, tiempo de handshake TLS, Tiempo hasta el Primer Byte (TTFB) y tiempo total de respuesta como componentes distintos.

- Afirmar. La respuesta se evalúa contra afirmaciones configuradas — código de estado HTTP, umbral de tiempo de respuesta, encabezados de respuesta y contenido del payload mediante JSONPath (REST) o XPath (SOAP).

- Alertar o aprobar. Si alguna afirmación falla, o si la solicitud expira, se crea un incidente y se envían alertas según las reglas de notificación configuradas.

- Registrar. Todos los resultados — aprobados y fallidos — se almacenan con marcas de tiempo, datos de respuesta y resultados de afirmaciones para análisis históricos y reportes de SLA.

Monitorización de Transacciones API Multi-Paso

La monitorización de un solo endpoint confirma que los endpoints individuales responden. Pero los recorridos reales de los usuarios no son llamadas API únicas; son secuencias encadenadas donde cada paso depende del resultado del paso anterior.

Considere un flujo de pago en un comercio electrónico:

- Paso 1 —

POST /auth/token: Autenticar usuario; extraeraccess_tokendel cuerpo de la respuesta - Paso 2 —

GET /products/{id}: Obtener detalles del producto; inyectar el token en el encabezadoAuthorization - Paso 3 —

POST /cart/add: Agregar artículo; extraercart_idde la respuesta - Paso 4 —

POST /checkout/initiate: Iniciar el checkout concart_id; extraercheckout_session_id - Paso 5 —

POST /payments/charge: Procesar pago; afirmar que el campo de respuestaorder_statuses igual a'confirmed'

En la monitorización de un solo endpoint, los cinco pasos podrían pasar individualmente mientras que la transacción completa falla — porque los datos de sesión no se pasan correctamente entre pasos, un token expira en medio del flujo o la API de pagos devuelve HTTP 200 con un campo de error en la carga útil. La monitorización de múltiples pasos ejecuta toda la cadena como un solo monitor, valida cada paso de manera independiente y pasa valores dinámicos (tokens, IDs de sesión, IDs de orden) entre pasos automáticamente.

Dotcom-Monitor permite monitorización de transacciones de múltiples pasos encadenando llamadas API secuenciales en una sola tarea de monitorización. La extracción e inyección de variables entre pasos es automática. Cada paso se verifica de forma independiente, por lo que los fallos se localizan en el paso exacto donde la transacción se rompió.

Validación de la carga útil: Afirmaciones JSONPath y XPath

La validación de la carga útil es lo que diferencia la monitorización de un simple ping de disponibilidad. Cómo se expresan las afirmaciones depende de la herramienta, pero la lógica es consistente:

- Acceso a campo JSONPath (REST): Acceder a

$.data.status— luego afirmar que el valor devuelto es igual a'active' - Verificación de arreglo JSONPath: Acceder a

$.items— afirmar que la longitud del arreglo es mayor que 0 - Afirmación XPath (SOAP):

//order/status/text()— afirmar que el valor del nodo es igual a'confirmed' - Afirmación de encabezado: Afirmar que el valor del encabezado

Content-Typees igual a'application/json' - Afirmación de tiempo de respuesta: Afirmar que el tiempo total de respuesta sea inferior a 500 ms

Monitoreo de Autenticación

Las APIs de producción requieren autenticación. Una herramienta de monitoreo debe manejar los mismos métodos de autenticación que sus clientes API reales. Los esquemas que una plataforma de monitoreo lista para producción debería soportar:

| Método de Autenticación | Descripción | Notas |

|---|---|---|

| OAuth 2.0 — Credenciales de Cliente | Máquina a máquina; el cliente intercambia credenciales por un token directamente | El más común para el monitoreo de API servidor a servidor |

| OAuth 2.0 — Código de Autorización | Autorización delegada por el usuario; típicamente usado con PKCE para SPAs/aplicaciones móviles | Requiere que la herramienta de monitoreo maneje automáticamente la renovación del token |

| OAuth 2.0 — Contraseña del Propietario del Recurso (ROPC) | Intercambio directo de nombre de usuario + contraseña — flujo legado | Usar solo donde el Código de Autorización no sea factible |

| Token Bearer (JWT) | Token estático o renovado dinámicamente en el encabezado Authorization |

Los JWTs de corta duración requieren renovación automática del token |

| Clave API | Clave estática en encabezado, parámetro de consulta o cookie | El más sencillo de monitorear; vigilar eventos de rotación |

| Autenticación Básica | username:password codificado en Base64 en el encabezado Authorization |

Legado — aún común en APIs internas y empresariales |

| Firma AWS v4 | Solicitud firmada HMAC usando credenciales AWS | Requerido para endpoints de AWS API Gateway |

| mTLS / Certificado de Cliente | TLS mutuo — ambos lados presentan certificados | Entornos de confianza cero; monitoreo crítico de expiración de certificados |

| NTLM / Kerberos | Autenticación integrada de Windows/Active Directory | APIs internas empresariales; menos común en stacks nativos de la nube |

| Encabezados Personalizados | Esquemas de autenticación propietarios mediante encabezados personalizados de solicitud | Catch-all para implementaciones no estándar de autenticación |

La expiración del token es una causa principal de falsos positivos en el monitoreo. Los tiempos de vida de los tokens de acceso OAuth 2.0 varían ampliamente según la implementación y el tipo de concesión. Los tokens delegados por el usuario (flujo de Código de Autorización) típicamente oscilan entre 15 minutos y 1 hora. Los tokens máquina a máquina (flujo de Credenciales de Cliente) suelen configurarse para ventanas más largas — 1 hora a 24 horas — para reducir la carga de renovación. Los entornos de alta seguridad pueden imponer tiempos de vida tan cortos como 5 minutos. Independientemente de la ventana, un monitoherramienta de monitoreo que no maneje actualización automática de tokens generará falsos positivos o requerirá rotación manual de credenciales, creando tanto sobrecarga operativa como riesgo de interrupciones.

Una nota sobre el otorgamiento implícito OAuth 2.0: está obsoleto en las mejores prácticas de seguridad actuales de OAuth 2.0 (RFC 9700) y no debe usarse en nuevos sistemas. Si tus APIs existentes usan el flujo implícito, se recomienda encarecidamente migrar a Código de Autorización + PKCE.

Por qué importa el monitoreo de API: impacto comercial

Las APIs no son abstracciones de infraestructura, son caminos de ingresos. Cuando fallan, las consecuencias son financieras, operativas y contractuales.

El costo de las fallas de API no detectadas

Sin monitoreo proactivo, los equipos dependen de los informes de los clientes para detectar fallas. Las encuestas de la industria ubican consistentemente el MTTD reportado por clientes muy por encima de 30 minutos — para cuando se presenta, investiga, triage y escala una queja, ese intervalo ya ha pasado. El monitoreo sintético continuo con intervalos de comprobación de 1 minuto reduce la detección a menos de 60 segundos, permitiendo aislar la causa raíz antes de que el problema se agrave.

La fórmula de ingresos es sencilla: órdenes/min × valor promedio de la orden × duración de la interrupción en minutos. Una plataforma que procesa 100 órdenes/min a un valor promedio de $50 pierde $25,000 en ingresos potenciales durante una interrupción de 5 minutos de la API de pagos. Inserta tu propio flujo y valor de orden para dimensionar tu exposición.

Escenarios específicos de la industria

- Comercio electrónico. Un fallo en la API de pago durante el tráfico pico detiene todas las conversiones. Una API de autorización de pago que devuelve HTTP 200 con estado rechazado — pero sin alerta — bloquea silenciosamente transacciones por minutos antes de que alguien lo note.

- FinTech. Las APIs de procesamiento de transacciones deben cumplir con requisitos de latencia sub-segundos. La degradación persistente por encima de los umbrales SLA puede desencadenar penalizaciones contractuales y hallazgos de auditoría bajo PCI DSS.

- Salud. Las APIs de integración EHR y de telemedicina deben mantener un intercambio de datos conforme a HIPAA. Una API que devuelve HTTP 200 con datos incompletos del paciente es un evento de cumplimiento — no solo un problema de rendimiento.

- SaaS / API como Producto. Cuando tu API es un producto facturable, el tiempo de inactividad desencadena penalizaciones contractuales de SLA y pérdida de clientes. El monitoreo proporciona la evidencia documentada de disponibilidad necesaria para reportar cumplimiento de SLA.

- TI Empresarial. Integraciones de API CRM, ERP y RRHH entre departamentos. Una degradación en la API de Salesforce puede interrumpir silenciosamente flujos de ventas en toda la organización sin que aparezca un solo error 500 en tus registros.

Riesgo de API de terceros

Las aplicaciones modernas dependen de APIs externas que no controlan: pasarelas de pago (Stripe, PayPal, Braintree), proveedores de identidad (Okta, Auth0, AWS Cognito), shAPIs de envío y sistemas CRM. Cuando estos se degradan, tu aplicación parece estar rota para los usuarios aunque tu infraestructura esté saludable.

Monitorear endpoints de terceros permite a los equipos aislar inmediatamente si una falla es interna o externa, una distinción que puede tomar un tiempo significativo de investigación establecer sin datos previos de monitoreo. También proporciona evidencia documentada para responsabilizar a los proveedores conforme a sus SLA publicados.

Deja de enterarte de las fallas de API por tus clientes.

El monitoreo sintético de API de Dotcom-Monitor detecta fallas en menos de 60 segundos y envía alertas directamente a PagerDuty, Slack o Microsoft Teams. Monitorea pasarelas de pago, proveedores de identidad y APIs internas desde una sola plataforma.

Prueba gratis por 30 días → No se requiere tarjeta de crédito

Monitoreo de API vs. Pruebas de API

Ambas prácticas validan el comportamiento de la API, pero tienen propósitos diferentes en el ciclo de vida de entrega del software. Confundirlas crea brechas en la cobertura.

| Dimensión | Pruebas de API | Monitoreo de API |

|---|---|---|

| Cuándo | Pre-despliegue — desarrollo, QA, pipeline CI/CD | Post-despliegue — continuamente en producción |

| Entorno | Desarrollo, staging, entorno de prueba controlado | Producción en vivo, infraestructura real, tráfico real |

| Disparador | Commit de código, build, ejecución manual, puerta PR | Programado (ej. cada 1 minuto), continuo 24/7 |

| Objetivo | Prevenir bugs que lleguen a producción | Detectar fallas y degradación en producción |

| Cobertura | Todos los comportamientos, casos límite, caminos de error | Rutas críticas, endpoints SLA, cadenas del viaje del usuario |

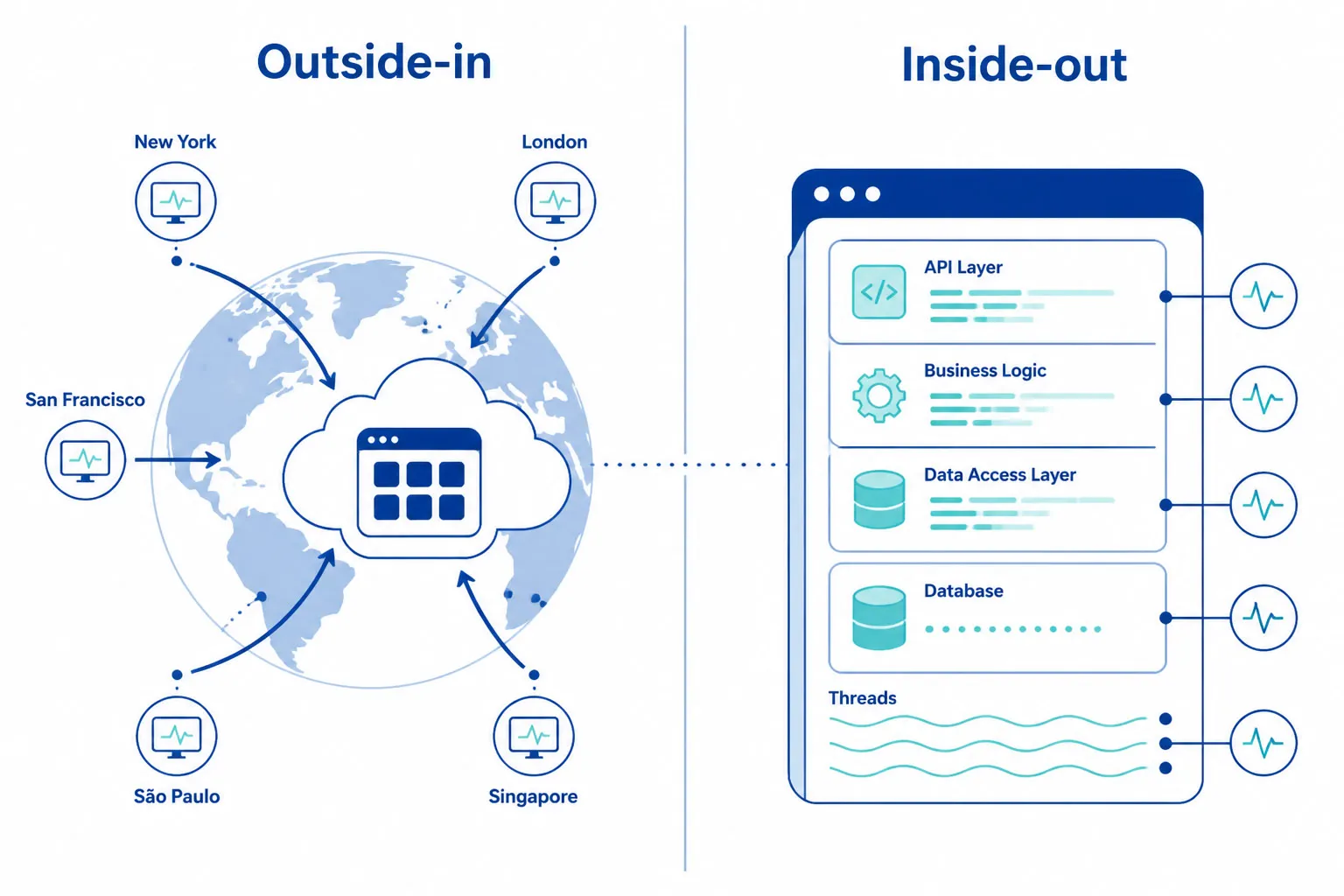

| Perspectiva | De adentro hacia afuera: prueba el comportamiento del código | De afuera hacia adentro: valida desde la perspectiva del usuario |

| Resultado | Reporte pasa/falla; bloquea despliegue en falla | Alertas en tiempo real, registros SLA de uptime, historial de incidentes |

La relación práctica: Las pruebas de API son una actividad de fase de desarrollo. El monitoreo de API es una actividad operativa. Las pruebas encuentran bugs antes del despliegue; el monitoreo detecta fallas, regresiones, degradación de rendimiento y problemas de dependencias después del despliegue — bajo condiciones reales de infraestructura que difieren de los entornos de prueba controlados.

Una madurael equipo de ingeniería ejecuta ambos — y usa importaciones de colecciones de Postman para conectar los dos, convirtiendo pruebas de desarrollo en monitores de producción sin duplicar definiciones de solicitudes.

Monitoreo de API vs. APM

Estas dos categorías se confunden con frecuencia. Son complementarias, no intercambiables.

| Monitoreo sintético de API | APM (Monitoreo del rendimiento de aplicaciones) | |

|---|---|---|

| Perspectiva | Desde afuera hacia adentro — valida desde el mismo punto de vista que usuarios y socios | Desde adentro hacia afuera — observa el comportamiento interno de la aplicación |

| Lo que ve | Errores de DNS, problemas de ruteo de red, errores TLS, rutas erróneas de CDN, brechas geográficas | Consultas lentas a BD, fugas de memoria, excepciones de código, llamadas lentas a funciones |

| Cuándo se ejecuta | 24/7 — incluso durante períodos sin tráfico | Sólo cuando se están procesando solicitudes reales |

| Pregunta que responde | “¿Pueden nuestros clientes llamar a esta API ahora mismo?” | “¿Qué ocurre dentro de nuestra aplicación cuando llega una solicitud?” |

Los equipos con el MTTR más bajo usan ambos: APM para análisis interno de causas raíz, monitoreo sintético de API para validación externa. Los logs y trazas responden “¿qué salió mal en nuestro código?” El monitoreo sintético responde “¿pueden nuestros clientes usar esta API ahora mismo?”

Protocolos de API: REST, SOAP, GraphQL, gRPC y WebSocket

Cada protocolo de API tiene requisitos de monitoreo y modos de falla distintos. Una herramienta de monitoreo que trate todas las APIs como simples solicitudes HTTP GET pasará por alto problemas específicos de cada protocolo.

Monitoreo de API REST

REST es el protocolo de API dominante. El monitoreo valida métodos HTTP (GET, POST, PUT, PATCH, DELETE), códigos de estado, encabezados de respuesta y cuerpos de respuesta JSON mediante aserciones JSONPath. Requisitos clave: verificar valores de campos en la carga útil de la respuesta — no sólo códigos de estado; monitorear todos los métodos HTTP, no solo GET (POST, PUT y DELETE activan lógica del servidor diferente y fallosmodos); rastree el tiempo de respuesta por endpoint individualmente, no como promedios agregados a través de los endpoints.

Monitoreo de API SOAP

Las APIs SOAP intercambian XML sobre HTTP. Requisitos de monitoreo: importación WSDL para la definición del endpoint y esquema; aserciones XPath en elementos de respuesta XML; soporte para protocolos SOAP 1.1 y SOAP 1.2; configuración WS-Security para servicios SOAP empresariales usando seguridad a nivel de mensaje.

Monitoreo de API GraphQL

El principal desafío del monitoreo de GraphQL: la mayoría de implementaciones de servidores GraphQL devuelven HTTP 200 incluso para errores parciales o consultas mal formadas. El código de estado HTTP no es una señal confiable de fallo. Debe:

- Enviar cargas de consulta específicas y hacer aserciones en el objeto

datade la respuesta - Revisar el arreglo

errorsen el cuerpo de la respuesta — en GraphQL estándar, cada respuesta tiene un campo opcional superiorerrorsque está vacío o ausente en éxito y se llena en fallos. Una respuesta 200 conerrors[]poblado significa que la solicitud falló en la capa GraphQL aunque HTTP haya tenido éxito - Validar invariantes específicos de la consulta: asegurar que los campos esperados estén presentes, no nulos y con el tipo correcto en el objeto data — algunos sistemas codifican fallos de dominio dentro del objeto data en lugar de poblar el arreglo superior de errors

- Monitorear límites de complejidad y profundidad de consulta para detectar degradación de rendimiento antes de que cause timeouts

Monitoreo de API gRPC

gRPC usa Protocol Buffers sobre HTTP/2 por defecto, aunque gRPC-Web soporta HTTP/1.1 vía proxy para clientes en navegador. Requisitos de monitoreo: importación de archivo proto para definiciones de servicio y métodos; soporte de codificación/decodificación binaria para mensajes Protocol Buffer; validación de códigos de estado usando códigos de estado gRPC (OK, UNAVAILABLE, DEADLINE_EXCEEDED, etc.) — no códigos de estado HTTP; soporte para tipos RPC Unary, Server-Streaming, Client-Streaming y Bidirectional-Streaming.

Monitoreo de API WebSocket

Las APIs WebSocket mantienen conexiones bidireccionales persistentes para datos en tiempo real. El monitoreo valida el tiempo de establecimiento de conexión y éxito del handshake WebSocket, latencia de entrega de mensajes y corrección de la carga útil, y estabilidad de la conexión en el tiempo incluyendo el comportamiento de reconexión tras caídas.

Monitoreo de API Pública vs. Monitoreo de API Interna

La mayoría de las guías de monitoreo de API se enfocan exclusivamente en los endpoints públicos. Pero en arquitecturas de microservicios, la mayoría de las llamadas API críticas son internas — llamadas servicio a servicio que nunca llegan a la internet pública.

| Monitoreo de API Pública | Monitoreo de API Interna | |

|---|---|---|

| Lo que cubre | Endpoints orientados al cliente, APIs de socios, integraciones de terceros | Microservicios internos, VPCs privadas, entornos de staging, APIs detrás del firewall |

| Cómo funciona | Agentes externos de monitoreo ejecutan verificaciones desde ubicaciones globales a través de internet pública | Un Agente Privado desplegado dentro de su red inicia conexiones salientes hacia la plataforma de monitoreo |

| Requisitos de firewall | Ninguno — las verificaciones se originan externamente | No se requieren reglas entrantes — el agente solo inicia conexiones salientes |

| Lo que detecta | Fallas de resolución DNS, problemas de enrutamiento CDN, errores TLS, brechas de disponibilidad geográfica | Fallas entre servicios, latencia en microservicio de autenticación, degradación del API de consultas a base de datos |

| Implementación | No requiere instalación — funciona inmediatamente | Agente instalado on-premises o en nube privada (soporta Windows y Linux) |

Las APIs internas de microservicios son la fuente más común de fallas en cascada. Un servicio de autenticación degradado o un API de acceso a datos lento provoca problemas en etapas posteriores que se manifiestan como fallas en el frontend — haciendo difícil encontrar la causa raíz sin visibilidad interna. Monitorear APIs internas permite a los equipos aislar si la falla está en la capa del API, en el microservicio descendente o en la base de datos. Aprende más sobre Monitoreo con Agentes Privados detrás de tu firewall.

Mejores Prácticas para el Monitoreo de API

Estas prácticas reducen el tiempo medio para la detección (MTTD), mejoran la precisión de las alertas y aseguran que la cobertura de monitoreo se ajuste al riesgo en producción.

- Monitorea en intervalos de 1 minuto para endpoints críticos de ingresos. Para pagos, autenticación y APIs de datos centrales, cada minuto sin detección tiene impacto directo en el negocio. Intervalos de 5 o 15 minutos son aceptables para endpoints de menor criticidad.

- Ejecuta verificaciones desde al menos 5 ubicaciones geográficamente distribuidas. Una sola ubicación de monitoreo no puede detectar fallas DNS regionales, configuraciones erróneas de CDN o problemas de enrutamiento específicos por región. Como mínimo, cubre Norteamérica, Europa y Asia-Pacífico.

- Valide el contenido del payload, no solo los códigos de estado. Configure aserciones JSONPath para cada endpoint crítico. Las fallas silenciosas más costosas son las APIs que retornan HTTP 200 con datos incompletos, obsoletos o mal formados.

- Use umbrales de alerta derivados de la línea base, no valores estáticos en milisegundos. Establezca una línea base de tiempo de respuesta por endpoint y configure alertas al doble del valor P95. Los umbrales estáticos generan falsos positivos durante picos normales de tráfico.

- Incluya la autenticación en sus cadenas de monitoreo. La expiración de tokens, fallas en la renovación de OAuth y la rotación de certificados son causas principales de interrupciones de API. Monitorear los pasos de autenticación detecta fallos relacionados con credenciales antes de que se propaguen.

- Construya monitores de transacciones multi-paso para cada recorrido crítico del usuario. Flujos de inicio de sesión, secuencias de pago y flujos de envío de datos son llamadas API encadenadas. Los monitores de endpoint único no pueden detectar fallos inter-paso causados por paso incorrecto de datos o manejo de sesiones.

- Monitoree las dependencias de APIs de terceros como monitores separados. Cree monitores dedicados para Stripe, Okta, Salesforce y otras dependencias externas. Esto responde inmediatamente si una falla es interna o externa.

- Importe colecciones de Postman o Insomnia para iniciar el monitoreo. Convierta definiciones existentes de APIs en monitores de producción 24/7 sin recrear las estructuras de solicitud. Esto elimina la brecha entre las pruebas en tiempo de desarrollo y el monitoreo en producción.

- Integre chequeos de API post-despliegue en pipelines CI/CD. Ejecute chequeos sintéticos de API como pruebas de humo automatizadas después de cada despliegue. Si los chequeos post-despliegue fallan, considere activar una reversión automática o retención de tráfico en configuraciones de entrega progresiva (blue/green o canary), utilizando ejecuciones de confirmación desde una segunda ubicación para reducir falsos positivos antes de tomar cualquier acción automatizada.

- Dirija las alertas a PagerDuty, Slack o Microsoft Teams con políticas de escalamiento. El alertamiento solo por correo electrónico genera retraso en la detección. Las integraciones nativas con herramientas de gestión de incidentes aseguran que las alertas lleguen a la persona correcta de inmediato, con rutas de escalamiento definidas para la falta de respuesta.

Desafíos del Monitoreo de API

Incluso las configuraciones de monitoreo bien diseñadas enfrentan desafíos operativos. Anticiparlos ayuda a los equipos a diseñar en torno a ellos.

Visibilidad de API de terceros

Monitorear dependencias externas le brinda datos de disponibilidad y latencia pero no puede exponer la causa interna de una degradación. Cuando Stripe u Okta se ralentizan, puede confirmarlo y aislar el radio de impacto, pero el análisis de la causa raíz depende de las páginas de estado del proveedor y rutas de escalamiento de soporte.

Limitación de velocidad

Los agentes de monitoreo cuentan para los límites de frecuencia de su API. El volumen total de solicitudes sintéticas se escala como: ubicaciones × verificaciones por hora × llamadas API por ejecución de monitor × reintentos de confirmación. Para un monitor de un solo punto final: 30 ubicaciones × 60 verificaciones/hora = 1,800 solicitudes/hora. Para un monitor de transacciones de 5 pasos con los mismos ajustes: 30 × 60 × 5 = 9,000 solicitudes/hora por monitor. Considere esto en la planificación del límite de frecuencia, especialmente para APIs internas con umbrales más estrictos. Asegúrese de que los rangos IP de su proveedor de monitoreo estén en la lista blanca donde sea necesario.

Complejidad de autenticación

Las APIs que usan tokens de corta duración requieren herramientas de monitoreo que manejen la renovación automática de tokens. Los tokens OAuth 2.0 delegados por usuario (flujo de Código de Autorización) suelen expirar entre 15 minutos y 1 hora; los tokens de Credenciales de Cliente máquina a máquina a menudo duran de 1 a 24 horas; los entornos de alta seguridad pueden aplicar ventanas de 5 minutos. La autenticación basada en certificados y las claves API rotativas también requieren una gestión cuidadosa de credenciales.

Respuestas dinámicas y no deterministas

Las APIs que devuelven datos con marca de tiempo, resultados paginados o arreglos en orden aleatorio son difíciles de verificar con coincidencia de valor exacto. Use expresiones JSONPath que validen la estructura, la presencia de campos y los tipos de campo — en lugar de valores exactos que cambian en cada solicitud.

Fatiga por alertas

El exceso de monitoreo — demasiados endpoints con intervalos de 1 minuto, o umbrales demasiado estrictos — genera ruido que desensibiliza a los equipos ante alertas reales. Use monitoreo por niveles: 1 minuto para rutas críticas, 5–15 minutos para endpoints no críticos. Confirme las alertas desde una ubicación secundaria antes de enviar notificaciones para eliminar falsos positivos transitorios.

Diversidad de protocolos

REST, SOAP, GraphQL, gRPC y WebSocket requieren diferentes estrategias de aserción. Una herramienta que solo maneje REST perderá fallas en servicios SOAP y reportará incorrectamente errores de GraphQL como exitosos porque devuelven HTTP 200.

Cómo configurar el monitoreo de API con Dotcom-Monitor

Dotcom-Monitor proporciona monitoreo sintético de API para REST, SOAP y GraphQL desde más de 30 ubicaciones globales, con intervalos de verificación de 1 minuto, soporte para transacciones de múltiples pasos e integraciones nativas con PagerDuty, Slack, and Microsoft Teams.

Paso 1 — Defina su Endpoint y Afirmaciones

- URL del Endpoint: El endpoint de la API a monitorear

- Método HTTP: GET, POST, PUT, PATCH o DELETE

- Encabezados de la solicitud:

Content-Type,Authorizationy cualquier encabezado personalizado requerido - Cuerpo de la solicitud: Payload JSON para solicitudes POST/PUT

- Autenticación: OAuth 2.0, Bearer Token, API Key, Basic Auth, mTLS, AWS Signature v4, NTLM, Kerberos o encabezados personalizados

- Afirmaciones: código de estado HTTP, umbral de tiempo de respuesta, valores de encabezados, afirmaciones de payload JSONPath/XPath

Paso 2 — Importar desde Postman o Insomnia

Si su equipo usa Postman o Insomnia, omita totalmente la configuración manual del endpoint:

- Postman: Exporte su Colección como JSON v2.0 o v2.1 e impórtela en Dotcom-Monitor. Se preservan las definiciones de solicitud, encabezados, cuerpo, variables de entorno y afirmaciones de prueba.

- Insomnia: Exporte su espacio de trabajo como un archivo JSON Insomnia v4 e impórtelo en Dotcom-Monitor. Se retienen los grupos de solicitudes, configuraciones de autenticación y variables de entorno.

Ambos formatos de importación convierten pruebas de desarrollo puntuales en monitores de producción programados continuamente las 24/7 sin necesidad de reconfiguración.

¿Ya usa Postman? Está a 5 minutos de monitoreo de producción 24/7.

Importe su Colección Postman existente directamente en Dotcom-Monitor. Se preservan sus definiciones de solicitud, encabezados, variables de entorno y afirmaciones — no se requiere reconfiguración.

Paso 3 — Configure las Ubicaciones de Monitoreo y la Frecuencia

- Frecuencia de chequeo: Intervalos de 1, 3, 5 o 15 minutos — establezca por endpoint según la criticidad

- Ubicaciones de monitoreo: Seleccione entre más de 30 ubicaciones en Norteamérica, Europa, Asia-Pacífico y Sudamérica

- Agente Privado: Para APIs internas o detrás de un firewall — despliegue el agente on-premise o en su nube privada (compatible con Windows y Linux). El agente inicia únicamente conexiones salientes — no se requieren reglas de firewall entrantes.

- Reintentos de confirmación: Configure una verificación de confirmación desde una ubicación secundaria antes de activar alertas, para eliminar falsos positivos transitorios de red

Paso 4 — Configure la Ruta de Alertas

- PagerDuty: Dirija alertas críticas directamente a horarios de guardia con creación automática de incidentes y escalación

- Slack / Microsoft Teams: Publique mensajes de alerta con detalles del endpoint, tipo de error y datos de respuesta en canales de operaciones

- Email, SMS, Phone call: Configura preferencias de notificación por contacto o por equipo

- Webhook: Integra con OpsGenie, ServiceNow, o cualquier servicio compatible con HTTP

- Configuración de umbrales: Establece condiciones de alerta por métrica — tiempo de respuesta, tasa de error, tasa de fallo de aserción — con niveles de severidad

Paso 5 — Integración de la canalización CI/CD

- Dotcom-Monitor REST API: Crea, actualiza y activa tareas de monitoreo programáticamente mediante llamadas API HTTP desde cualquier sistema CI/CD

- GitHub Actions / Azure DevOps / Jenkins: Añade un paso post-despliegue que active una ejecución de chequeo de Dotcom-Monitor, espere resultados y falle la canalización si alguna aserción falla

- Validación pre-producción: Ejecuta los mismos chequeos sintéticos contra tu entorno de staging antes de promover construcciones a producción — detecta regresiones antes de que cualquier usuario se vea afectado

Casos de uso de monitoreo de API por industria

| Industria | APIs críticas a monitorear | Requisitos clave de monitoreo |

|---|---|---|

| E-commerce | Checkout, autorización de pago, inventario, envíos, gestión del carrito | Cadenas de transacciones multi-paso; intervalos de 1 minuto; aserción de carga útil sobre el estado de confirmación de pago |

| FinTech / Banca | Procesamiento de transacciones, verificación KYC/AML, saldo de cuenta, tasas de cambio, APIs de transferencias bancarias | SLAs de latencia sub-200ms; chequeos relacionados con cumplimiento que soportan evidencia PCI DSS; validación completa del flujo de autenticación |

| Salud | Integraciones EHR (HL7 FHIR), portales de seguros, puntos de telemedicina, programación de pacientes | Chequeos relacionados con cumplimiento que soportan evidencia HIPAA; validación de carga útil para completitud de datos; SLA de 99.99% de uptime |

| SaaS | APIs del producto principal, endpoints de entrega webhook, APIs de integración con socios, APIs de autenticación | Cumplimiento del SLA de API-como-producto; importación Postman para consistencia dev-a-monitoreo; monitoreo de dependencias de terceros |

| TI Empresarial | CRM, ERP, HRIS, proveedor de identidad, APIs de automatización de flujos internos | Agente privado para APIs detrás del firewall; soporte de autenticación NTLM/Kerberos; visibilidad de APIs entre departamentos |

| Medios / Juegos | APIs de entrega de contenido CDN, autenticación, puntuación en tiempo real, APIs de funciones sociales | Monitoreo de distribución geográfica; monitoreo de conexiones WebSocket; detección de picos de tráfico |

Comience a monitorear sus APIs hoy.

Dotcom-Monitor ofrece monitoreo sintético de API desde más de 30 ubicaciones globales, con chequeos cada minutointervalos, soporte para transacciones de múltiples pasos e integraciones nativas con PagerDuty, Slack y Microsoft Teams. La configuración toma menos de 5 minutos. No se requiere tarjeta de crédito para la prueba de 30 días.