APIs stehen im Zentrum moderner Anwendungen. Sie treiben mobile Apps an, verbinden Microservices und ermöglichen Integrationen mit Drittanbietern, wodurch sie für Performance, Zuverlässigkeit und Umsatz kritisch sind. Deshalb investieren die meisten Teams stark in API-Testtools wie Postman, automatisierte Test-Suites und Online-API-Tester.

APIs stehen im Zentrum moderner Anwendungen. Sie treiben mobile Apps an, verbinden Microservices und ermöglichen Integrationen mit Drittanbietern, wodurch sie für Performance, Zuverlässigkeit und Umsatz kritisch sind. Deshalb investieren die meisten Teams stark in API-Testtools wie Postman, automatisierte Test-Suites und Online-API-Tester.

Und dennoch kommt es weiterhin zu Ausfällen in der Produktion.

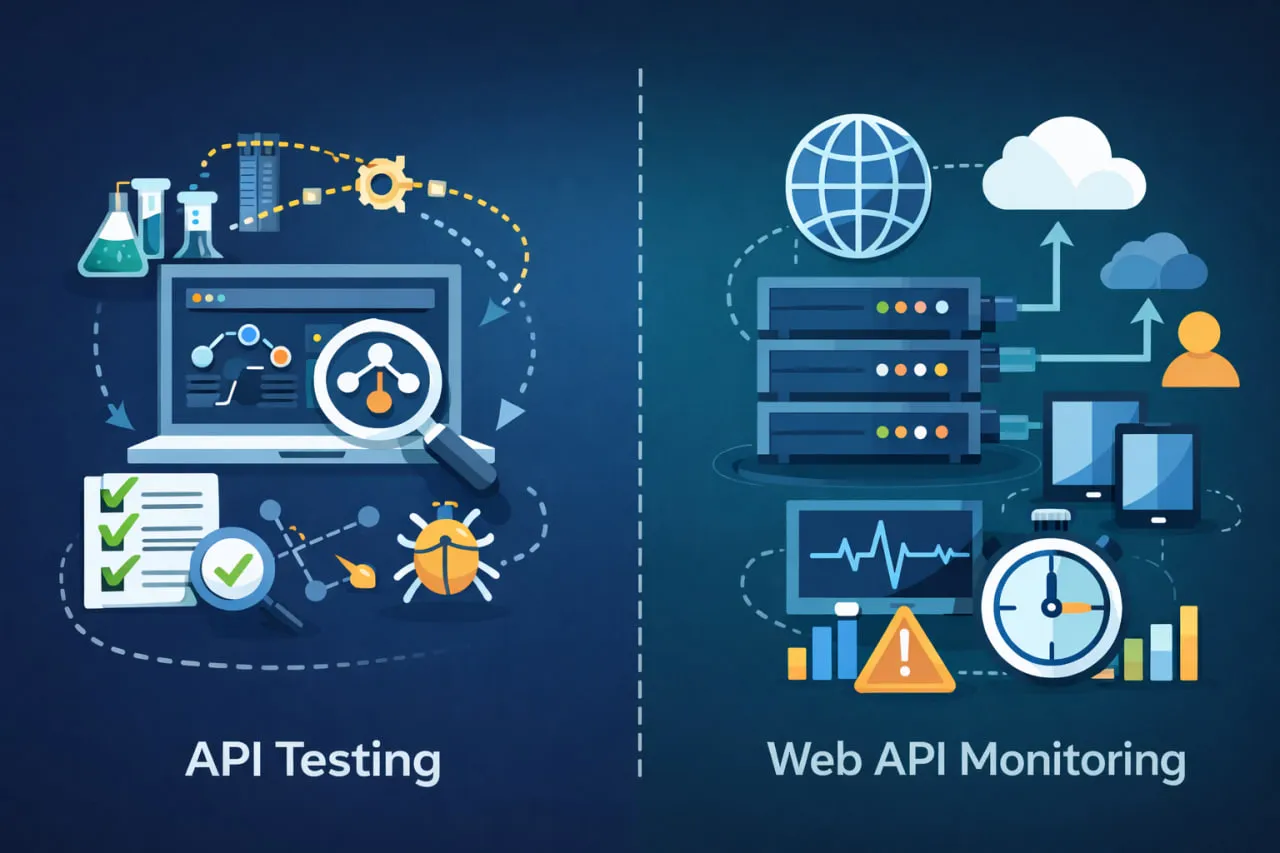

Diese Diskrepanz („unsere APIs wurden getestet, warum sind sie also ausgefallen?“) ist der Punkt, an dem die Verwirrung zwischen API-Tests und Web-API-Monitoring beginnt. Obwohl beide miteinander verwandt sind, dienen sie unterschiedlichen Zwecken in verschiedenen Phasen des API-Lebenszyklus.

API-Tests konzentrieren sich auf die Validierung von Endpoints vor der Veröffentlichung. Sie helfen Teams, Korrektheit zu bestätigen, Verträge durchzusetzen und Probleme frühzeitig in kontrollierten Umgebungen zu erkennen. Web-API-Monitoring hingegen validiert APIs kontinuierlich nach dem Deployment, von außen und unter realen Bedingungen.

Diese Ansätze als austauschbar zu betrachten, hinterlässt blinde Flecken, sobald APIs live sind. Manuelle Prüfungen, geplante Testläufe oder einfache Uptime-Pings sind nicht dafür ausgelegt, eine permanente, produktionsreife Sichtbarkeit zu liefern.

In diesem Artikel vergleichen wir API-Tests vs. Web-API-Monitoring, erklären, wo Tools wie Postman und Online-API-Tester einzuordnen sind, und zeigen, warum Produktions-APIs eine kontinuierliche externe Validierung benötigen. Außerdem beleuchten wir, wie Teams Tests mit Web-API-Monitoring kombinieren, um die Zuverlässigkeit aufrechtzuerhalten, sobald Nutzer von ihren APIs abhängig sind.

Was sind API-Tests?

API-Tests sind die Praxis, Programmierschnittstellen (APIs) auf der Nachrichtenebene zu validieren, ohne sich auf eine grafische Benutzeroberfläche zu stützen. Anstatt durch Oberflächen zu klicken, senden Teams Anfragen direkt an API-Endpoints und bewerten die Antworten (Statuscodes, Header, Payloads und Performance-Eigenschaften), um zu bestätigen, dass sich die API wie erwartet verhält.

Im Kern beantworten API-Tests eine einfache Frage: „Funktioniert dieser Endpoint unter bekannten Bedingungen korrekt?“

Für Entwicklungs- und QA-Teams macht dies API-Tests zu einem wesentlichen Bestandteil beim Aufbau zuverlässiger Software. APIs liegen häufig unter Benutzeroberflächen und Integrationen, sodass das frühzeitige Erkennen von Problemen, bevor sie sich durch eine Anwendung fortpflanzen, sowohl schneller als auch kostengünstiger ist als spätere Fehlersuche.

Wo API-Tests im Lebenszyklus angesiedelt sind

API-Tests sind am effektivsten vor dem Deployment, während der Entwicklungs- und Pre-Production-Phasen. Typische Anwendungsfälle sind:

- Überprüfen, ob Endpoints korrekte Antworten für gültige Anfragen liefern

- Sicherstellen, dass die Fehlerbehandlung bei ungültigen oder unerwarteten Eingaben funktioniert

- Bestätigen, dass API-Verträge (Schemas, Pflichtfelder, Formate) eingehalten werden

- Überprüfung der Basis-Performance unter kontrollierten Bedingungen

Da APIs selten isoliert geändert werden, hilft frühes Testen Teams, Probleme zu identifizieren, bevor sie nachgelagerte Services, Frontend-Anwendungen oder Kunden beeinträchtigen.

Aus diesem Grund sind API-Tests auch eng in moderne CI/CD-Pipelines integriert. Automatisierte API-Tests können bei jedem Commit oder Build ausgeführt werden, liefern schnelles Feedback an Entwickler und verhindern, dass Regressionen die Produktion erreichen.

Häufige Arten von API-Tests

Obwohl der Begriff „API-Tests“ oft allgemein verwendet wird, umfasst er tatsächlich mehrere unterschiedliche Testansätze, die jeweils einem bestimmten Zweck dienen:

- Unit-Tests

Konzentrieren sich auf einzelne Endpoints oder Funktionen und validieren, dass eine einzelne Anfrage die korrekte Antwort erzeugt. - Integrationstests

Überprüfen, dass APIs korrekt funktionieren, wenn sie mit anderen Services, Datenbanken oder externen Systemen kombiniert werden. - Vertragstests

Stellen sicher, dass APIs vereinbarte Anfrage- und Antwortstrukturen einhalten, sodass Änderungen keine Konsumenten brechen. - Funktionale Tests

Bestätigen, dass APIs Geschäftsanforderungen erfüllen und erwartete Aktionen ausführen. - Performance- und Lasttests

Bewerten Antwortzeiten und Verhalten unter simulierten Traffic-Levels. - Sicherheitstests

Prüfen auf Schwachstellen wie fehlerhafte Authentifizierungslogik, fehlende Autorisierung oder Datenlecks.

All diese Ansätze sind wertvoll, haben jedoch eine wichtige Einschränkung gemeinsam: Sie werden typischerweise in kontrollierten Umgebungen ausgeführt, mit bekannten Zugangsdaten, stabilen Netzwerken und vorhersehbaren Eingaben.

Warum API-Tests allein Grenzen haben

API-Tests sind darauf ausgelegt, Korrektheit zu validieren, nicht jedoch eine kontinuierliche Absicherung zu bieten, sobald APIs live sind. Tests laufen in der Regel:

- In Entwicklungs- oder Staging-Umgebungen

- On-Demand oder nach Zeitplan

- Innerhalb der eigenen Infrastruktur

Infolgedessen berücksichtigen API-Tests viele reale Variablen nicht, wie Netzwerk-Latenz über Regionen hinweg, intermittierende Ausfälle von Drittanbietern oder Änderungen nach dem Deployment. Hier entsteht häufig Verwirrung. Teams gehen davon aus, dass APIs aufgrund bestandener Tests in der Produktion automatisch zuverlässig sind.

Das sind sie nicht – und das ist kein Versagen der Tests. Es ist schlicht nicht das, wofür API-Tests entwickelt wurden.

Um zu verstehen, wo Tests enden und die Verantwortung in der Produktion beginnt, hilft es, zunächst zu klären, mit welcher Art von APIs Sie es zu tun haben – sei es eine HTTP-API, REST-API oder Web-API – und wie sie Konsumenten bereitgestellt werden

API-Testtools: Postman, Online-Tester und ihre Stärken

Sobald Teams verstehen, was API-Tests leisten sollen, stellt sich meist die praktische Frage: Welche Tools sollten wir verwenden? Für die meisten Entwickler und QA-Ingenieure beginnt die Antwort mit Postman und erweitert sich auf eine Reihe von Online-API-Testtools und leichten HTTP-Clients. Diese Tools dominieren die Suchergebnisse – und das aus gutem Grund. Sie sind zugänglich, flexibel und innerhalb ihres vorgesehenen Einsatzbereichs äußerst effektiv.

Wichtig ist jedoch zu verstehen, wo diese Tools ihre Stärken haben und wo ihre Grenzen liegen. API-Testtools sind dafür ausgelegt, APIs während der Entwicklung und Pre-Production zu validieren, nicht um nach dem Livegang einen kontinuierlichen Schutz zu bieten.

Postman: Der Standard-Einstiegspunkt für API-Tests

Postman ist zum Synonym für API-Tests geworden. Es ermöglicht Teams, schnell Anfragen zu senden, Antworten zu prüfen, Umgebungen zu verwalten und Testkollektionen zu automatisieren. Für Entwickler ist es oft der schnellste Weg, Fragen zu beantworten wie:

- Gibt dieser Endpoint die richtigen Daten zurück?

- Sind Header und Statuscodes korrekt gesetzt?

- Schlägt diese Anfrage bei ungültigen Eingaben sauber fehl?

Die Stärke von Postman liegt in der manuellen und automatisierten Validierung. Entwickler können Anfragen verketten, Variablen verwenden und Kollektionen in CI-Pipelines integrieren, um Regressionen frühzeitig zu erkennen. Das macht Postman zu einem hervorragenden Kollaborationstool zwischen Entwicklungs- und QA-Teams während der aktiven Entwicklung.

Dennoch ist Postman im Kern ein Test-Client. Tests werden ausgeführt, wenn jemand sie startet – manuell oder nach Zeitplan – und typischerweise aus kontrollierten Umgebungen heraus. Nach dem Deployment validiert Postman Verfügbarkeit oder Performance nicht kontinuierlich von außen. Teams, die sich ausschließlich auf Postman verlassen, schließen diese Lücke oft mit Ad-hoc-Prüfungen oder Skripten und gehen davon aus, dass Tests ausreichen, um Zuverlässigkeit zu garantieren.

Diese Annahme ist der Ursprung von blinden Flecken in der Produktion.

Online-API-Testtools und HTTP-Clients

Neben Postman experimentieren viele Teams mit browserbasierten oder Online-API-Testtools. Diese Tools erleichtern:

- Das schnelle Senden von HTTP-Anfragen ohne Installation von Software

- Die Validierung von Endpoints während des Debuggings

- Einmalige Prüfungen öffentlicher APIs

Online-HTTP-Clients sind besonders hilfreich zur Fehleranalyse oder um zu verstehen, wie sich eine API verhält. Sie senken die Einstiegshürde und sind oft die ersten Tools, zu denen Junior-Entwickler oder Produktteams greifen.

Wie Postman sind diese Tools jedoch transaktional und reaktiv. Sie beantworten die Frage „Funktioniert diese Anfrage jetzt?“, liefern aber keinen historischen Kontext, keine Alarmierung und keine kontinuierliche Sichtbarkeit. Sie sind nicht dafür ausgelegt, APIs über längere Zeiträume zu überwachen oder Verschlechterungen zu erkennen, bevor Nutzer sie bemerken.

Dieser Unterschied wird deutlicher beim Vergleich von Online-HTTP-Clients vs. Web-API-Monitoring, bei dem sich Letzteres auf wiederholbare, automatisierte Validierung statt auf einmalige Tests konzentriert.

Warum Testtools die Produktionsrealität nicht abdecken

Der gemeinsame Nenner von Postman und Online-API-Testtools ist die Intention. Sie wurden entwickelt, um Menschen beim Testen von APIs zu unterstützen, nicht um als dauerhafte Beobachter von Produktionssystemen zu fungieren. Infolgedessen:

- Laufen Tests von vorhersehbaren Standorten aus

- Ist Authentifizierung meist statisch und kontrolliert

- Werden Fehler nur entdeckt, wenn jemand nachschaut

In der Produktion verhalten sich APIs anders. Netzwerkpfade ändern sich, Zugangsdaten laufen ab, Abhängigkeiten werden langsamer und Traffic-Muster schwanken. Testtools berücksichtigen diese Variablen nicht, weil sie nicht dafür gedacht sind.

An diesem Punkt beginnen Teams, über Testtools hinauszublicken und sich dem kontinuierlichen Web-API-Monitoring zuzuwenden, das APIs automatisch, von externen Standorten und ohne manuelle Eingriffe validiert. Anstatt Postman oder Online-Tester zu ersetzen, ergänzt Monitoring diese, indem es die Verantwortung übernimmt, sobald APIs live sind.

Plattformen wie Dotcom-Monitor werden häufig in dieser Phase eingeführt – nicht als Testtools, sondern als Monitoringsysteme, die Verfügbarkeit und Antwortverhalten von APIs in Produktionsumgebungen kontinuierlich überprüfen.

Was ist Web-API-Monitoring?

Web-API-Monitoring ist die Praxis der kontinuierlichen Validierung von APIs nach deren Deployment in die Produktion. Anstatt Tests on demand auszuführen, führt Monitoring API-Prüfungen automatisch und nach Zeitplan aus, um zu bestätigen, dass Endpoints unter realen Bedingungen verfügbar, reaktionsschnell und funktionsfähig bleiben.

Während API-Tests fragen „Funktioniert dieser Endpoint in einer kontrollierten Umgebung?“, fragt Web-API-Monitoring „Funktioniert diese API jetzt für echte Nutzer?“ Dieser Wechsel von der Validierung vor der Veröffentlichung hin zur kontinuierlichen Überprüfung in der Produktion ist der zentrale Unterschied.

Web-API-Monitoring konzentriert sich auf operative Fragen wie:

- Ist die API von außerhalb der Anwendungsumgebung erreichbar?

- Verschlechtern sich die Antwortzeiten im Laufe der Zeit?

- Treten Fehler intermittierend oder dauerhaft auf?

Da diese Prüfungen kontinuierlich laufen, erzeugen sie historische Daten, mit denen Teams Trends erkennen, Vorfälle korrelieren und das Verhalten von APIs über die Zeit verstehen können – etwas, das einmalige Tests und manuelle Prüfungen nicht leisten können.

APIs dort überwachen, wo Nutzer sie erleben

Ein wesentliches Merkmal des Web-API-Monitorings ist, dass es extern ausgeführt wird, von Standorten außerhalb Ihrer Infrastruktur. Diese Outside-in-Perspektive spiegelt wider, wie APIs tatsächlich von Nutzern, Partnern und integrierten Systemen konsumiert werden, und nicht, wie sie sich in internen Testumgebungen verhalten.

Modernes Web-API-Monitoring wird häufig mithilfe von Synthetic Monitoring umgesetzt, bei dem wiederholbare API-Anfragen in regelmäßigen Abständen ausgeführt und gegen erwartete Antworten validiert werden. Dieser Ansatz ermöglicht es Teams, Verfügbarkeits- und Performance-Probleme frühzeitig zu erkennen, oft bevor Kunden betroffen sind.

Sobald APIs live sind, führen viele Teams dedizierte Monitoring-Plattformen wie Dotcom-Monitor ein, um ihre bestehenden API-Testtools zu ergänzen. Diese Plattformen sollen Postman oder CI-basierte Tests nicht ersetzen, sondern die Verantwortung für die laufende Zuverlässigkeit in der Produktion übernehmen.

Für eine vertiefende Erklärung der praktischen Umsetzung können Sie unseren vollständigen Leitfaden dazu lesen, wie Web-API-Monitoring funktioniert, der Einrichtung, Ausführung und typische Anwendungsfälle detailliert behandelt.

API-Tests vs. Web-API-Monitoring: Der praktische Unterschied

API-Tests und Web-API-Monitoring interagieren beide mit API-Endpoints, existieren jedoch für unterschiedliche Zeitpunkte im API-Lebenszyklus. Verwirrung entsteht, wenn Teams von Testtools Produktionsgarantien erwarten, für die sie nie konzipiert wurden.

API-Tests dienen der Validierung vor der Veröffentlichung. Teams nutzen Tools wie Postman oder automatisierte Test-Suites, um zu bestätigen, dass Endpoints korrekte Antworten liefern, Verträge einhalten und bekannte Randfälle in kontrollierten Umgebungen korrekt behandeln.

Web-API-Monitoring dient der kontinuierlichen Absicherung nach dem Deployment. Sobald APIs live sind, verschiebt sich der Fokus von Korrektheit zu Zuverlässigkeit – also darauf, dass Endpoints unter realen Bedingungen erreichbar, performant und funktionsfähig bleiben.

Kurz gesagt:

- Tests fragen: „Funktioniert diese API wie vorgesehen?“

- Monitoring fragt: „Funktioniert diese API jetzt?“

Dieser Unterschied wird in der Produktion entscheidend, wo APIs von externen Netzwerken, ablaufender Authentifizierung und Abhängigkeiten von Drittanbietern beeinflusst werden. Deshalb betrachten viele Teams Monitoring als operative Fortsetzung von Tests, nicht als deren Ersatz.

Ein gängiges Muster ist es, Postman und CI-Tests während der Entwicklung weiter zu nutzen und dann Synthetic Monitoring in der Produktion einzuführen, um APIs kontinuierlich von außerhalb der Anwendungsumgebung zu validieren. Dieser Ansatz hilft Teams, Probleme früher zu erkennen und Vertrauen aufzubauen, dass APIs erwartungsgemäß funktionieren, sobald Nutzer von ihnen abhängig sind.

Wenn Sie eine tiefere Analyse der Monitoring-Seite wünschen, können Sie mehr darüber erfahren, wie Web-API-Monitoring funktioniert und wie es sich in bestehende Test-Workflows einfügt.

Warum API-Tests bestehen, APIs aber dennoch in der Produktion ausfallen

Für viele Teams treten die verwirrendsten API-Vorfälle auf, wenn zuvor alles in Ordnung schien. Tests waren erfolgreich. Builds liefen durch. Nichts Offensichtliches hatte sich geändert. Und dennoch erlebten Nutzer Ausfälle.

Das ist kein Widerspruch, sondern eine Sichtbarkeitslücke.

Kontrollierte Tests vs. reale Bedingungen

API-Testtools validieren Verhalten in vorhersehbaren Umgebungen. Anfragen werden von bekannten Standorten aus gesendet, mit stabilen Zugangsdaten und gegen Systeme, die noch keinem realen Traffic-Druck ausgesetzt sind. Genau dafür sind Tests gedacht.

Die Produktion hingegen bringt Variablen mit sich, die Tests nur unzureichend abbilden:

- Unterschiede im Netzwerk-Routing zwischen Regionen

- Abgelaufene oder rotierte Authentifizierungs-Tokens

- Verhalten von CDN, Firewalls oder Proxys

- Latenzen oder Ausfälle von Drittanbieter-Abhängigkeiten

Eine API kann alle Tests bestehen und dennoch scheitern, sobald sie realen Nutzern über das öffentliche Internet zur Verfügung steht.

Das Problem „grüne Tests, rote Nutzer“

Ein weiteres häufiges Problem ist das Timing. API-Tests laufen typischerweise:

- Während der Entwicklung

- Als Teil von CI/CD

- On demand oder nach Zeitplan

Zwischen diesen Läufen kann sich vieles ändern. Eine Abhängigkeit wird langsamer. Ein Zertifikat läuft ab. Eine Konfiguration driftet. Ohne kontinuierliche Validierung bleiben diese Probleme unsichtbar, bis Kunden betroffen sind.

Deshalb erkennen Teams oft (zu spät), dass Tests allein keine operative Abdeckung bieten.

Wo kontinuierliches Monitoring die Lücke schließt

Hier wird Web-API-Monitoring unverzichtbar. Durch kontinuierliche, externe API-Prüfungen können Teams Verfügbarkeit und Antwortverhalten unter denselben Bedingungen validieren, die Nutzer erleben. Viele Organisationen ergänzen diese Ebene nach ersten Produktionsvorfällen, indem sie Plattformen wie Dotcom-Monitor nutzen, um ihren bestehenden Test-Stack zu ergänzen statt ihn zu ersetzen.

Monitoring verhindert nicht, dass Bugs geschrieben werden, aber es verhindert, dass stille Ausfälle unbemerkt bleiben.

Wenn Ihre APIs kundenorientiert oder umsatzkritisch sind, ist diese Outside-in-Sichtbarkeit oft der Unterschied zwischen reaktivem Beschwerdemanagement und frühzeitiger Problemerkennung.

Um zu verstehen, wie diese Produktionsvalidierung praktisch umgesetzt wird, lohnt sich ein Blick darauf, wie sich Online-HTTP-Clients und Web-API-Monitoring unterscheiden, sobald APIs live sind.

Wie Web-API-Monitoring Postman und API-Testtools ergänzt

Postman und ähnliche API-Testtools sind während der Entwicklung unverzichtbar. Sie helfen Teams, Anfragen zu entwerfen, Antworten zu validieren und Prüfungen in CI-Pipelines zu automatisieren. Sobald APIs jedoch deployt sind, nimmt die Rolle dieser Tools naturgemäß ab.

An dieser Stelle tritt Web-API-Monitoring auf den Plan – nicht als Ersatz für Postman, sondern als dessen Gegenstück in der Produktion.

Von der Entwicklungsvalidierung zur Produktionsabsicherung

Ein typischer Workflow sieht folgendermaßen aus:

- Teams nutzen Postman zum Testen von Endpoints während der Entwicklung

- Automatisierte API-Tests laufen im CI, um Regressionen zu erkennen

- APIs werden deployt und beginnen, reale Nutzer zu bedienen

An diesem Punkt existieren Postman-Tests weiterhin, beantworten jedoch nicht mehr die dringendste Frage: Funktioniert diese API gerade für Nutzer?

Durch den Übergang von Postman zu Web-API-Monitoring erweitern Teams ihre Abdeckung auf die Produktion. Anstatt Kollektionen manuell auszuführen oder sich auf sporadische Prüfungen zu verlassen, validiert Monitoring live Endpoints kontinuierlich von außerhalb der Anwendungsumgebung.

Was Monitoring bietet, was Testtools nicht leisten

Gemeinsam eingesetzt schaffen Tests und Monitoring eine klare Aufgabenteilung:

- Postman validiert Korrektheit vor der Veröffentlichung

- Web-API-Monitoring validiert Verfügbarkeit und Performance nach der Veröffentlichung

Monitoring-Plattformen führen wiederholbare Prüfungen nach Zeitplan aus, verfolgen das Antwortverhalten über die Zeit und machen Probleme automatisch sichtbar. Dies ist besonders wertvoll für APIs, die kundenorientierte Funktionen, Integrationen oder umsatzkritische Workflows unterstützen.

Viele Teams führen in dieser Phase dedizierte Monitoring-Tools wie Dotcom-Monitor ein, um kontinuierliche externe Sichtbarkeit für Produktions-APIs zu erhalten, ohne ihre Entwicklungs-Testprozesse zu ändern.

Wenn Ihre APIs bereits gut getestet sind, ist das Hinzufügen von Monitoring oft der schnellste Weg, blinde Flecken zu reduzieren und von reaktiver Fehlerbehebung zu proaktiver Erkennung überzugehen.

Für Teams, die bereit sind, diesen nächsten Schritt zu gehen, lohnt es sich, einen genaueren Blick darauf zu werfen, wie produktionsreife Monitoring-Tools konzipiert sind und was sie über Entwicklungstests hinaus bieten.

Synthetic Monitoring für Produktions-APIs

Sobald APIs deployt sind, benötigen Teams eine Möglichkeit, sie kontinuierlich zu validieren, ohne sich auf manuelle Prüfungen oder geplante Testläufe zu verlassen. Hier wird Synthetic Monitoring zu einer praktischen Ergänzung von API-Tests.

Synthetic Monitoring nutzt vordefinierte API-Anfragen, die nach Zeitplan ausgeführt werden, um Verfügbarkeit und Antwortverhalten über die Zeit zu bestätigen. Da dieselben Anfragen konsistent ausgeführt werden, können Teams Änderungen, Ausfälle oder Performance-Verschlechterungen in Produktionsumgebungen schnell erkennen.

Im Gegensatz zu Entwicklungstests läuft Synthetic Monitoring typischerweise außerhalb der Anwendungsumgebung und bietet Einblicke in das Verhalten von APIs über reale Netzwerke und Bedingungen hinweg. Diese externe Perspektive deckt Probleme auf, die interne Tests häufig übersehen.

Viele Teams setzen diesen Ansatz mithilfe produktionsorientierter Monitoring-Plattformen wie Dotcom-Monitor um. Anstatt Tools wie Postman zu ersetzen, übernimmt Synthetic Monitoring die Verantwortung, sobald APIs live sind, und stellt sicher, dass sie zuverlässig bleiben, wenn Nutzer und Integrationen von ihnen abhängen.

Mit der Zeit fließen kontinuierliche Prüfungen in Dashboards und Berichte ein, die Verfügbarkeitstrends und historische Performance zeigen und isolierte Testergebnisse in umsetzbare operative Erkenntnisse verwandeln.

Von Monitoring zu Sichtbarkeit: Dashboards, Berichte und operative Nutzung

Das Erkennen eines API-Problems ist nur der erste Schritt. Entscheidend dafür, ob Teams schnell handeln und im Nachhinein erklären können, was passiert ist, ist die Sichtbarkeit. Hier entwickelt sich Web-API-Monitoring über Prüfungen und Alerts hinaus zu einem operativen Werkzeug für Engineering und Management.

Kontinuierliches Monitoring erzeugt Daten über die Zeit hinweg, nicht nur punktuelle Ergebnisse. Werden diese Daten in Dashboards und Berichten aufbereitet, können Teams verstehen, wie sich APIs im Tagesgeschäft verhalten – nicht nur dann, wenn etwas ausfällt. Verfügbarkeitstrends, Antwortzeitmuster und Vorfallhistorien erleichtern die Beantwortung von Fragen wie „Ist das ein einmaliges oder ein wiederkehrendes Problem?“ und „Hat sich die Performance nach einem Deployment verändert?“

Diese Sichtbarkeit ist besonders wichtig, sobald APIs geschäftskritisch werden. Engineering-Manager und Führungskräfte benötigen bei der Analyse von Vorfällen oder bei Gesprächen über Zuverlässigkeit mit Stakeholdern häufig Belege – keine Annahmen. Monitoring-Plattformen wie Dotcom-Monitor werden in dieser Phase häufig eingesetzt, um Ergebnisse zu zentralisieren und sie über das unmittelbare Engineering-Team hinaus zugänglich zu machen.

Web-API-Monitoring operationalisieren

Die Einführung von Web-API-Monitoring erfordert kein Umdenken in der Art und Weise, wie Teams APIs testen. Stattdessen erweitern die meisten Organisationen ihre bestehenden Prozesse:

- API-Tests bleiben Teil von Entwicklung und CI

- Monitoring übernimmt nach dem Deployment

- Ergebnisse fließen in gemeinsame Dashboards und Alerts ein

Um den Übergang zu erleichtern, beginnen Teams in der Regel mit einer kleinen Anzahl kritischer Endpoints und erweitern die Abdeckung schrittweise. Klare Setup-Anleitungen und Konfigurations-Workflows stellen sicher, dass Prüfungen konsistent und wiederholbar bleiben, wenn das Monitoring skaliert.

Für Teams, die von ad-hoc-Validierung zu operativer Sichtbarkeit wechseln möchten, ist dies oft der Punkt, an dem Monitoring seinen Wert beweist und rohe Prüfungen in Erkenntnisse und Vertrauen verwandelt.

Besuchen Sie unsere Wissensdatenbank für

Fazit: Wo API-Tests enden, beginnt Monitoring

API-Tests und Web-API-Monitoring werden oft gemeinsam betrachtet – doch wie dieser Artikel gezeigt hat, lösen sie unterschiedliche Probleme in unterschiedlichen Phasen des API-Lebenszyklus. Testtools wie Postman sind unverzichtbar, um Korrektheit während der Entwicklung zu validieren. Sie helfen Teams, schnell voranzukommen, Regressionen früh zu erkennen und mit Vertrauen zu veröffentlichen.

Sobald APIs jedoch live sind, ändert sich die Definition von „funktionierend“.

In der Produktion wird Zuverlässigkeit durch reale Netzwerke, reale Nutzer und reale Abhängigkeiten geprägt. Hier enden Tests naturgemäß, und Web-API-Monitoring übernimmt – mit kontinuierlicher externer Validierung, die sicherstellt, dass APIs nach dem Deployment verfügbar und reaktionsschnell bleiben. Teams, die diese Übergabe früher erkennen, entdecken Probleme schneller, reduzieren blinde Flecken und verbringen weniger Zeit mit der Reaktion auf von Kunden gemeldete Ausfälle.

Der effektivste Ansatz ist nicht die Wahl zwischen Tests oder Monitoring. Es ist die bewusste Kombination beider: Tests zur Validierung von APIs vor der Veröffentlichung und Monitoring, um sie zu schützen, sobald sie für Nutzer und das Geschäft relevant werden.

Wenn Ihre APIs bereits gut getestet und kundenorientiert sind, besteht der nächste Schritt darin, ihr Verhalten in der Produktion zu verstehen – konsistent und ohne manuellen Aufwand. Um zu sehen, wie dies in der Praxis funktioniert, können Sie unsere Web-API-Monitoring-Software ansehen und erfahren, wie Teams sie nutzen, um ihre bestehenden API-Test-Workflows zu ergänzen.