API-Überwachung ist die kontinuierliche, automatisierte Praxis der Validierung von API-Endpunkten hinsichtlich Verfügbarkeit, Antwortzeit und Datenkorrektheit – sie bestätigt nicht nur, dass ein Endpunkt antwortet, sondern dass er die richtigen Daten im richtigen Format innerhalb einer akzeptablen Latenz aus Sicht der Benutzer und abhängiger Systeme zurückliefert.

APIs sind das verbindende Gewebe moderner Software. Jedes Mal, wenn sich ein Benutzer anmeldet, eine Zahlung abschickt oder eine Echtzeitbenachrichtigung erhält, führen mehrere API-Aufrufe im Hintergrund aus – oft über Microservices, Cloud-Anbieter und Drittanbieter hinweg. Wenn diese Aufrufe fehlschlagen oder sich verlangsamen, sind die Auswirkungen unmittelbar: unterbrochene Bezahlvorgänge, ausgesperrte Benutzer und Umsatzeinbußen.

Dennoch entdecken die meisten Teams API-Ausfälle erst, wenn Kunden sie melden. Ohne proaktive Überwachung wird die Zeitspanne zwischen Ausfall und Untersuchung typischerweise in zehn Minuten gemessen – lang genug, um reales Umsatz- und SLA-Risiko auszusetzen, bevor jemand alarmiert wird.

Dieser Leitfaden erklärt, was API-Überwachung ist, wie sie funktioniert, welche Kennzahlen zu verfolgen sind, wie sie sich von API-Tests und APM unterscheidet und wie man sie implementiert – mit der Präzision, die DevOps-Ingenieure, SREs und QA-Teams benötigen, um fundierte Entscheidungen im Produktionsbetrieb zu treffen.

Was ist API-Überwachung?

Die API-Überwachung umfasst drei verschiedene Validierungsebenen, in aufsteigender Spezifität:

- Verfügbarkeitsüberwachung — Ist der Endpunkt erreichbar? Liefert er eine HTTP-Antwort ohne Timeout zurück?

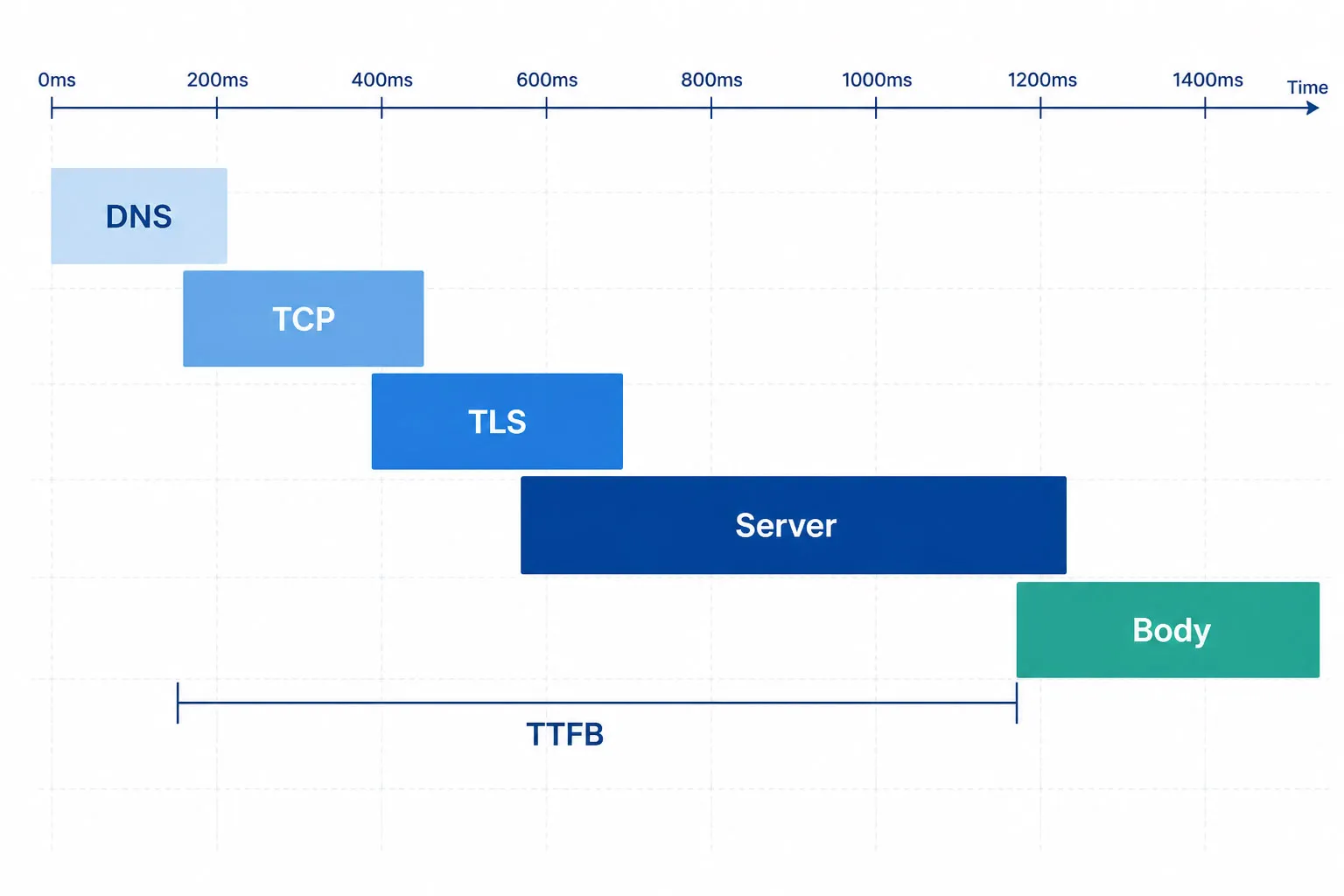

- Leistungsüberwachung — Wie lange dauert die Antwort? Führen TTFB, DNS-Auflösung oder TLS-Handshake zu Latenzen?

- Payload-Validierung — Enthält der Antwortkörper die erwartete Datenstruktur? Werden JSONPath- oder XPath-Assertions bestanden?

Was ist ein API-Endpunkt?

Eine Application Programming Interface (API) ist eine Reihe von Protokollen und Definitionen, die es Softwaresystemen ermöglichen, zu kommunizieren. Ein API-Endpunkt ist die spezifische URL, an der eine API Anfragen empfängtund gibt Antworten zurück — die Beobachtungseinheit für API-Überwachung. Zum Beispiel:

POST /v2/auth/token— Endpunkt zur Token-AusstellungGET /v2/orders/{id}— Endpunkt zum Abrufen von BestellungenPOST /v2/payments/charge— Endpunkt zur Zahlungsabwicklung

Moderne Anwendungen sind gleichzeitig auf Dutzende oder Hunderte solcher Endpunkte angewiesen — interne Microservices, Drittanbieter-Zahlungs-Gateways, Identitätsanbieter, Versand-APIs und CRM-Systeme. API-Überwachung sorgt für Transparenz über alle hinweg.

Arten der API-Überwachung

Nicht alle API-Überwachung ist gleich. Das Verständnis der Kategorien hilft Teams, eine Abdeckung zu schaffen, die sowohl ihrer Architektur als auch ihren Geschäftsanforderungen entspricht. Die fünf Kernarten gelten für fast jedes Team; die spezialisierten Arten sind relevant, wenn ihre Bedingungen vorliegen.

Kernarten

| Typ | Was geprüft wird | Am besten geeignet für |

|---|---|---|

| Uptime Monitoring | Erreichbarkeit des Endpunkts; HTTP-Antwortcodes; Antwort innerhalb des Zeitlimits | Grundlegende Verfügbarkeits-SLAs; sofortige Ausfallerkennung |

| Performance Monitoring | Antwortzeit, TTFB, DNS-Auflösung, TCP-Handshake, TLS-Zeit, Durchsatz | Latenz-SLAs, P95/P99 Ziele, Kapazitätsplanung |

| Payload / Validierungsüberwachung | Antwortkörper mittels JSONPath-/XPath-Assertions; Schema-Korrektheit; Feldwerte | Erkennen von stillen Ausfällen, bei denen HTTP 200 ≠ korrekte Daten bedeutet |

| Synthetische Überwachung | Simulierte API-Aufrufe von globalen Standorten in geplanten Intervallen, unabhängig vom realen Traffic | Proaktive Erkennung; geografische Abdeckung; Null-Traffic-Phasen |

| Multi-Step Transaction Monitoring | Verkettete API-Aufrufsequenzen (z.B. auth → query → submit → confirm); Datenübergabe zwischen Schritten | E-Commerce-Flows, Login-Prozesse, Bestell-Workflows |

Spezialisierte Arten

| Typ | Was geprüft wird | Am besten geeignet für |

|---|---|---|

| Sicherheitsüberwachung | Authentifizierungsfehler, anomale Anfrage-Muster, Ablauf von Zertifikaten, Rate-Limit-Missbrauch, Token-Wiederholungen | FinTech, Gesundheitswesen; APIs mit PII/PHI |

| Compliance-bezogene Prüfungen | TLS-Version-/Cipher-Validierung, Zertifikatsablauf, Vorhandensein von Sicherheitsheadern, Authentifizierungsdurchsetzungstests | Gesundheitswesen, Finanzdienstleistungen, regulierte Branchen |

| Real User Monitoring (RUM) | Reale Nutzer-API-Interaktionen; vollständige Sitzungsübersicht; echte geographische und Gerätevarianten | >Verstehen des tatsächlichen Benutzereinflusses; Validierung synthetischer Erkenntnisse |

| Versionsverwaltung & Auslaufüberwachung | API-Versionseinführungsraten; Fehleranstiege nach Versionsänderungen; Abwärtskompatibilität | Teams, die mehrere API-Versionen gleichzeitig verwalten |

| Überwachung von Drittanbietern / Integrationen | Externe API-Abhängigkeiten (Stripe, Okta, Salesforce, Twilio); Isolierung externer vs. interner Fehler | Jede App, die für kritische Workflows auf Drittanbieter-APIs angewiesen ist |

Ein Hinweis zu Compliance-bezogenen Prüfungen: Diese liefern unterstützende Beweise für spezifische technische Kontrollen. Framework-Compliance (HIPAA, PCI DSS, SOC 2) erfordert eine umfassendere organisatorische Governance, die über das hinausgeht, was allein durch Monitoring geleistet werden kann.

Synthetisches Monitoring vs. Real User Monitoring (RUM)

Beide Ansätze liefern API-Leistungsdaten, aber aus grundsätzlich unterschiedlichen Blickwinkeln:

| Synthetisches Monitoring | Real User Monitoring (RUM) | |

|---|---|---|

| Auslöser | Gesteuerte Prüfungen nach Zeitplan (z. B. alle 1 Minute) | Tatsächliche Benutzeranfragen in der Produktion |

| Abdeckung | Läuft 24/7 – auch wenn keine realen Nutzer aktiv sind | Erzeugt nur Daten, wenn Nutzer aktiv Anfragen stellen |

| Erkennung | Proaktiv – erkennt Fehler, bevor Nutzer betroffen sind | Reaktiv – zeigt Probleme erst, nachdem Nutzer bereits betroffen sind |

| Umfang | Öffentliche und private/interne APIs (über Private Agent) | APIs, die von realen Nutzern/Kunden erreicht werden – hauptsächlich öffentlich, aber Enterprise-RUM kann auch interne API-Aufrufe von instrumentierten Apps erfassen |

| Anwendungsfall | Kontinuierliche Validierung von Verfügbarkeit und Leistung | Verstehen des tatsächlichen Ausmaßes und der Erfahrung echter Nutzer |

Wichtige API-Überwachungsmetriken

Die richtigen Metriken zu verfolgen, ist der Unterschied zwischen informierter Vorfallreaktion und Alarmmüdigkeit. Nachfolgend die wichtigsten Metriken — mit genauen Benchmarks und deren Bedeutung.

| Metrik | Ziel / Benchmark | Was sie erkennt |

|---|---|---|

| Verfügbarkeit (Uptime %) | ≥ 99,9 % (drei Neunen); 99,99 % für umsatzkritische APIs | Gesamtausfall, Teilausfall, Timeout |

| Gesamtreaktionszeit | < 200 ms für einfache Endpunkte; < 1 s für komplexe Operationen | Serververlangsamungen, Überlastung, Deployment-Regressions |

| Time to First Byte (TTFB) | < 100 ms ideal; < 300 ms akzeptabel | Serververzögerung vor Beginn der Antwort |

| P95 / P99 Reaktionszeit | Alarm bei 2× Baseline P95 pro Endpunkt; Anpassung an Endpunktverhalten | Spitzenlatenz für die langsamsten 1–5 % der Anfragen |

| Fehlerrate (4xx / 5xx) | < 0,1 % für Produktions-APIs | Authentifizierungsfehler, falsche Eingabeverarbeitung, Serverfehler |

| DNS-Auflösungszeit | < 50 ms für zwischengespeicherte Abfragen in derselben Region; überregionale Abfragen können 100 ms überschreiten | DNS-Propagation-Probleme, Resolver-Fehler |

| TLS-Handshake-Zeit | < 100 ms | Fehlkonfiguration des Zertifikats, TLS-Version-Negotiationsprobleme |

| Durchsatz-Aussage-Erfolgsrate | 100 % (Alarm bei jedem Fehler) | Stille Fehler: HTTP-200-Antworten mit falschen oder fehlenden Daten |

| Durchsatz (Anfragen/Sek.) | Vergleich mit historischem Basiswert | Unerwartete Verkehrsrückgänge oder ungewöhnliche Spitzen |

| Zertifikatsablauf (verbleibende Tage) | Alarm bei 30 Tagen; kritisch bei 7 Tagen | Bevorstehendes TLS-Zertifikatsablauf |

Reaktionszeit-Benchmarks

Wie funktioniert API-Monitoring?

Das Verständnis der technischen Abläufe hilft Teams, das Monitoring korrekt zu konfigurieren und Ergebnisse genau zu interpretieren.

Die Kernüberwachungsschleife

- Terminplan. Ein synthetischer Check wird in einem konfigurierten Intervall (z. B. jede 1 Minute) von einem ausgewählten globalen Überwachungsstandort ausgeführt.

- Anfrage senden. Der Monitoring-Agent sendet eine HTTP-Anfrage an den Ziel-Endpunkt – einschließlich der HTTP-Methode (GET, POST, PUT, PATCH, DELETE), Anfrageheader, Authentifizierungsdaten und Anfrageinhalt.

- Timing messen. Der Agent erfasst DNS-Auflösungszeit, TCP-Verbindungszeit, TLS-Handschlagzeit, Time to First Byte (TTFB) und die gesamte Antwortzeit als separate Komponenten.

- Prüfen. Die Antwort wird gegen konfigurierte Assertions bewertet – HTTP-Statuscode, Antwortzeitgrenze, Antwortheader und Payload-Inhalt über JSONPath (REST) oder XPath (SOAP).

- Alarmieren oder passieren. Wenn eine Assertion fehlschlägt oder die Anfrage zeitüberschritten wird, wird ein Vorfall erstellt und Benachrichtigungen gemäß den konfigurierten Regeln versendet.

- Speichern. Alle Ergebnisse – bestanden und nicht bestanden – werden mit Zeitstempeln, Antwortdaten und Assertionsergebnissen für historische Trends und SLA-Berichte gespeichert.

Mehrstufiges API-Transaktionsmonitoring

Die Überwachung einzelner Endpunkte bestätigt, dass einzelne Endpunkte antworten. Aber echte Nutzerwege sind keine einzelnen API-Aufrufe — sie sind verkettete Sequenzen, bei denen jeder Schritt vom Ergebnis des vorherigen Schrittes abhängt.

Betrachten wir einen E-Commerce-Checkout-Prozess:

- Schritt 1 —

POST /auth/token: Benutzer authentifizieren;access_tokenaus dem Antworttext extrahieren - Schritt 2 —

GET /products/{id}: Produktdetails abrufen; Token in denAuthorization-Header einfügen - Schritt 3 —

POST /cart/add: Artikel hinzufügen;cart_idaus der Antwort extrahieren - Schritt 4 —

POST /checkout/initiate: Checkout mitcart_idstarten;checkout_session_idextrahieren - Schritt 5 —

POST /payments/charge: Zahlung verarbeiten; prüfen, dass das Antwortfeldorder_statusgleich'confirmed'ist

Bei der Überwachung einzelner Endpunkte können alle fünf Schritte einzeln bestanden werden, während die vollständige Transaktion fehlschlägt — weil Sitzungsdaten nicht korrekt zwischen den Schritten übergeben werden, ein Token mitten im Ablauf abläuft oder die Zahlungs-API HTTP 200 mit einem Fehlerfeld im Payload zurückgibt. Die Überwachung mehrerer Schritte führt die gesamte Kette als einen einzigen Monitor aus, validiert jeden Schritt unabhängig und übergibt dynamische Werte (Tokens, Sitzungs-IDs, Bestellnummern) automatisch zwischen den Schritten.

Dotcom-Monitor ermöglicht Multi-Step-Transaktionsüberwachung durch das Verketten sequentieller API-Aufrufe in einer einzigen Überwachungsaufgabe. Die Variablenextraktion und -einfügung zwischen den Schritten erfolgt automatisch. Jeder Schritt wird unabhängig geprüft, so dass Fehler genau auf den Schritt eingegrenzt werden können, an dem die Transaktion unterbrochen wurde.

Payload-Validierung: JSONPath- und XPath-Assertions

Payload-Validierung ist der Unterschied zwischen Überwachung und einer einfachen Verfügbarkeitsabfrage. Wie Assertions ausgedrückt werden, hängt vom Tool ab, die Logik bleibt jedoch gleich:

- JSONPath-Feldzugriff (REST): Zugriff auf

$.data.status— dann prüfen, ob der zurückgegebene Wert'active'ist - JSONPath-Array-Überprüfung: Zugriff auf

$.items— prüfen, ob die Array-Länge größer als 0 ist - XPath-Assertion (SOAP):

//order/status/text()— prüfen, ob der Knotenwert'confirmed'ist - Header-Assertion: Prüfen, ob der Wert des

Content-Type-Headers'application/json'ist - Antwortzeit-Assertion: Prüfen, ob die Gesamtantwortzeit unter 500 ms liegt

Authentifizierungsüberwachung

Produktive APIs erfordern eine Authentifizierung. Ein Überwachungstool muss dieselben Authentifizierungsmethoden unterstützen wie Ihre tatsächlichen API-Clients. Die Schemas, die eine produktionsreife Überwachungsplattform unterstützen sollte:

| Auth Methode | Beschreibung | Hinweise |

|---|---|---|

| OAuth 2.0 — Client Credentials | Maschine-zu-Maschine; Client tauscht Anmeldedaten direkt gegen ein Token aus | Am häufigsten für Server-zu-Server API-Überwachung |

| OAuth 2.0 — Authorization Code | Benutzerdelegierte Autorisierung; wird typischerweise mit PKCE für SPAs/mobile Apps genutzt | Erfordert, dass das Überwachungstool die automatische Token-Erneuerung handhabt |

| OAuth 2.0 — Resource Owner Password (ROPC) | Direkter Austausch von Benutzername + Passwort — Legacy-Flow | Nur verwenden, wenn der Authorization Code nicht umsetzbar ist |

| Bearer Token (JWT) | Statisches oder dynamisch erneuertes Token im Authorization-Header |

Kurzlebige JWTs erfordern eine automatische Token-Erneuerung |

| API-Schlüssel | Statischer Schlüssel im Header, Query-Parameter oder Cookie | Am einfachsten zu überwachen; auf Rotationsereignisse achten |

| Basic Authentication | Base64-kodiertes username:password im Authorization-Header |

Legacy — immer noch häufig in Unternehmens- und internen APIs |

| AWS Signature v4 | HMAC-signierte Anfrage mit AWS-Anmeldeinformationen | Erforderlich für AWS API Gateway-Endpunkte |

| mTLS / Client-Zertifikat | Mutual TLS — beide Seiten legen Zertifikate vor | Zero-Trust-Umgebungen; Überwachung des Zertifikatsablaufs ist kritisch |

| NTLM / Kerberos | Windows/Active Directory integrierte Authentifizierung | Unternehmensinterne APIs; weniger häufig in Cloud-nativen Stacks |

| Benutzerdefinierte Header | Proprietäre Auth-Schemata über benutzerdefinierte Anfrageheader | Fangt alle nicht standardmäßigen Auth-Implementierungen ab |

Das Ablaufen von Tokens ist eine Hauptursache für falsch positive Überwachungen. Die Lebensdauer von OAuth 2.0 Zugriffstokens variiert stark je nach Implementierung und Grant-Typ. Benutzerdelegierte Tokens (Authorization Code Flow) liegen typischerweise zwischen 15 Minuten und 1 Stunde. Maschinen-zu-Maschinen Tokens (Client Credentials Flow) sind oft für längere Zeitfenster konfiguriert — 1 Stunde bis 24 Stunden — um den Erneuerungsaufwand zu reduzieren. Hochsichere Umgebungen können Lebenszeiten von nur 5 Minuten erzwingen. Unabhängig vom Zeitfenster muss ein Monitoring tool, das keine automatische Token-Aktualisierung unterstützt, erzeugt Fehlalarme oder erfordert manuelle Anmeldeinformationsrotation, was sowohl betrieblichen Aufwand als auch Ausfallrisiken schafft.

Ein Hinweis zum OAuth 2.0 Implicit Grant: Dieser ist in den aktuellen OAuth 2.0-Sicherheitsbest Practices (RFC 9700) veraltet und sollte in neuen Systemen nicht verwendet werden. Wenn Ihre bestehenden APIs den Implicit-Flow nutzen, wird dringend empfohlen, auf Authorization Code + PKCE umzusteigen.

Warum API-Überwachung wichtig ist: Geschäftliche Auswirkungen

APIs sind keine Infrastruktur-Abstraktionen – sie sind Einnahmequellen. Wenn sie ausfallen, sind die Konsequenzen finanziell, operativ und vertraglich.

Die Kosten unerkannter API-Ausfälle

Ohne proaktive Überwachung verlassen sich Teams auf Kundenberichte, um Ausfälle zu erkennen. Branchenumfragen zeigen konstant, dass die mittlere Zeit bis zur Entdeckung (MTTD) durch Kundenberichte deutlich über 30 Minuten liegt – bis eine Beschwerde eingereicht, untersucht, priorisiert und eskaliert wurde, ist dieses Zeitfenster bereits verstrichen. Kontinuierliche synthetische Überwachung mit 1-Minuten-Intervallen verkürzt die Erkennung auf unter 60 Sekunden und ermöglicht die Ursachenfindung, bevor sich das Problem verschärft.

Die Umsatzformel ist einfach: Bestellungen/Min × durchschnittlicher Bestellwert × Ausfalldauer in Minuten. Eine Plattform, die 100 Bestellungen/Min bei einem durchschnittlichen Bestellwert von 50 $ verarbeitet, verliert während eines 5-minütigen Zahlungsausfalls 25.000 $ potenziellen Umsatz. Setzen Sie Ihre eigene Auslastung und Ihren Bestellwert ein, um Ihr Risiko zu bestimmen.

Branchenspezifische Szenarien

- E-Commerce. Ein Checkout-API-Ausfall während Spitzenverkehrszeiten stoppt alle Konversionen. Eine Zahlungsautorisierungs-API, die HTTP 200 mit einem abgelehnten Status zurückgibt – aber keinen Alarm auslöst – blockiert stillschweigend Transaktionen für Minuten, bevor jemand es bemerkt.

- FinTech. APIs zur Transaktionsverarbeitung müssen Anforderungen an sub-sekündige Latenz erfüllen. Anhaltende Verschlechterungen über SLA-Grenzwerte können vertragliche Strafen und Audit-Feststellungen unter PCI DSS auslösen.

- Gesundheitswesen. EHR-Integrations-APIs und Telemedizin-Endpunkte müssen HIPAA-konformen Datenaustausch gewährleisten. Eine API, die HTTP 200 mit unvollständigen Patientendaten zurückgibt, ist ein Compliance-Ereignis – nicht nur ein Leistungsproblem.

- SaaS / API-as-a-Product. Wenn Ihre API ein abrechenbares Produkt ist, lösen Ausfallzeiten vertragliche SLA-Strafen und Kundenabwanderungen aus. Die Überwachung liefert die dokumentierten Verfügbarkeitsnachweise, die für die SLA-Einhaltungsberichterstattung benötigt werden.

- Enterprise IT. CRM-, ERP- und HR-API-Integrationen über Abteilungen hinweg. Eine Salesforce-API-Verschlechterung kann heimlich vertriebsbezogene Workflows organisationsweit beeinträchtigen, ohne dass in Ihren Protokollen ein einzelner 500-Fehler erscheint.

Risiko bei Drittanbieter-APIs

Moderne Anwendungen sind auf externe APIs angewiesen, die sie nicht kontrollieren: Zahlungsgateways (Stripe, PayPal, Braintree), Identitätsanbieter (Okta, Auth0, AWS Cognito), shipping APIs und CRM-Systemen. Wenn diese ausfallen, erscheint Ihre Anwendung für die Benutzer defekt, obwohl Ihre Infrastruktur gesund ist.

Die Überwachung von Endpunkten Dritter ermöglicht es Teams, sofort zu erkennen, ob ein Fehler intern oder extern ist – eine Unterscheidung, die ohne vorherige Überwachungsdaten viel Untersuchungszeit erfordern kann. Sie liefert zudem dokumentierte Nachweise, um Anbieter an ihre veröffentlichten SLAs zu binden.

Hören Sie auf, von Ihren Kunden über API-Ausfälle zu erfahren.

Die synthetische API-Überwachung von Dotcom-Monitor erkennt Ausfälle in weniger als 60 Sekunden und leitet Benachrichtigungen direkt an PagerDuty, Slack oder Microsoft Teams weiter. Überwachen Sie Zahlungs-Gateways, Identitätsanbieter und interne APIs von einer Plattform aus.

API-Überwachung vs. API-Tests

Beide Praktiken validieren das Verhalten von APIs, erfüllen jedoch unterschiedliche Zwecke im Software-Lieferzyklus. Eine Vermischung führt zu Abdeckungs-Lücken.

| Dimension | API-Tests | API-Überwachung |

|---|---|---|

| Wann | Vor der Bereitstellung – Entwicklung, QA, CI/CD-Pipeline | Nach der Bereitstellung – kontinuierlich in der Produktion |

| Umgebung | Entwicklung, Staging, kontrollierte Testumgebung | Live-Produktion, reale Infrastruktur, echter Verkehr |

| Auslöser | Code-Commit, Build, manuelle Ausführung, PR-Gate | Geplant (z. B. jede Minute), 24/7 kontinuierlich |

| Ziel | Vermeidung von Bugs, die in die Produktion gelangen | Erkennung von Ausfällen und Degradierung in der Produktion |

| Abdeckung | Alle Verhaltensweisen, Randfälle, Fehlerpfade | Kritische Pfade, SLA-Endpunkte, Nutzer-Journey-Ketten |

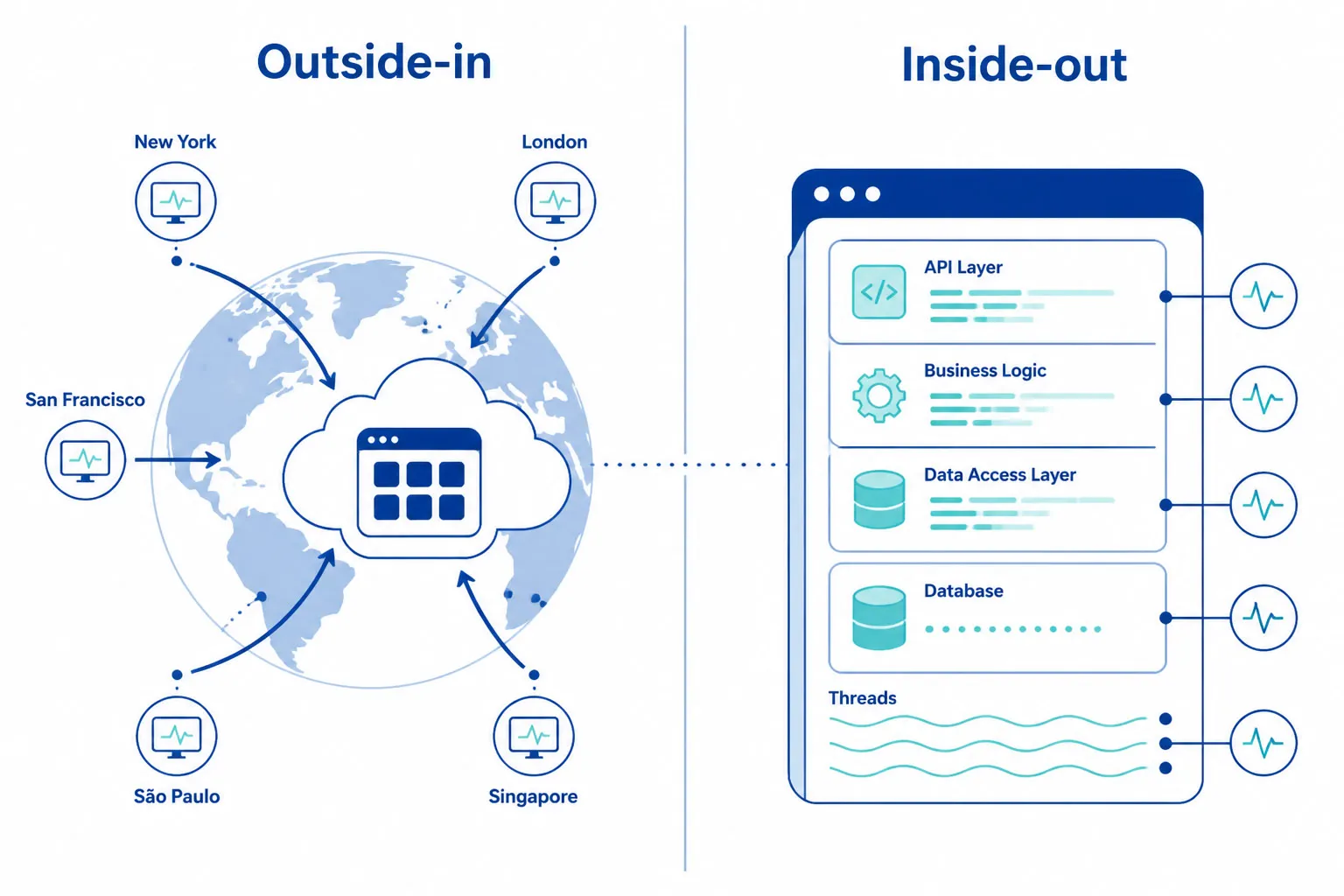

| Perspektive | Innen nach außen: testet das Verhalten des Codes | Außen nach innen: validiert aus Sicht des Benutzers |

| Ergebnis | Bestanden/Nicht bestanden Bericht; verhindert bei Fehlern die Bereitstellung | Echtzeit-Benachrichtigungen, SLA-Verfügbarkeitsprotokolle, Vorfallhistorie |

Die praktische Beziehung: API-Tests sind eine Aktivität in der Entwicklungsphase. API-Überwachung ist eine operative Tätigkeit. Tests entdecken Fehler vor der Bereitstellung; Überwachung erkennt Ausfälle, Regressionen, Performance-Degradierung und Abhängigkeitsprobleme nach der Bereitstellung – unter realen Infrastrukturbedingungen, die sich von kontrollierten Testumgebungen unterscheiden.

Ein ausgereiftes Das Engineering-Team betreibt beides — und verwendet Postman Collection-Importe, um die beiden zu verbinden, indem Entwicklungstests in Produktionsmonitore umgewandelt werden, ohne Anforderungsdefinitionen zu duplizieren.

API-Überwachung vs. APM

Diese beiden Kategorien werden häufig verwechselt. Sie ergänzen sich, sind aber nicht austauschbar.

| Synthetische API-Überwachung | APM (Application Performance Monitoring) | |

|---|---|---|

| Perspektive | Outside-in — validiert aus derselben Sicht wie Benutzer und Partner | Inside-out — beobachtet internes Anwendungsverhalten |

| Was sie sieht | DNS-Ausfälle, Netzwerk-Routing-Probleme, TLS-Fehler, CDN-Fehlleitungen, geografische Lücken | Langsame DB-Abfragen, Speicherlecks, Code-Ausnahmen, langsame Funktionsaufrufe |

| Wann sie läuft | 24/7 — auch während verkehrsfreier Zeiten | Nur wenn echte Anfragen verarbeitet werden |

| Frage, die sie beantwortet | „Können unsere Kunden diese API gerade wirklich aufrufen?“ | „Was passiert in unserer Anwendung, wenn eine Anfrage eingeht?“ |

Teams mit der niedrigsten MTTR verwenden beide: APM für interne Ursachenanalyse, synthetische API-Überwachung für externe Validierung. Logs und Traces beantworten „Was ist in unserem Code schiefgelaufen?“ Synthetische Überwachung beantwortet „Können unsere Kunden diese API gerade nutzen?“

API-Protokolle: REST, SOAP, GraphQL, gRPC und WebSocket

Jedes API-Protokoll hat unterschiedliche Überwachungsanforderungen und Fehlerarten. Ein Überwachungstool, das alle APIs als einfache HTTP-GET-Anfragen behandelt, übersieht protokollspezifische Probleme.

REST API Monitoring

REST ist das dominierende API-Protokoll. Die Überwachung validiert HTTP-Methoden (GET, POST, PUT, PATCH, DELETE), Statuscodes, Antwort-Header und JSON-Antwortkörper mittels JSONPath-Assertions. Wichtige Anforderungen: Überprüfung der Werte im Antwort-Payload-Feld — nicht nur der Statuscodes; Überwachung aller HTTP-Methoden, nicht nur GET (POST, PUT und DELETE lösen unterschiedliche serverseitige Logik und Fehler aus)Modi); verfolgen Sie die Antwortzeit pro Endpunkt einzeln, nicht als aggregierte Durchschnittswerte über Endpunkte hinweg.

SOAP API-Überwachung

SOAP-APIs tauschen XML über HTTP aus. Überwachungsanforderungen: WSDL-Import zur Definition von Endpunkt und Schema; XPath-Assertions auf XML-Antwortelemente; Unterstützung der Protokolle SOAP 1.1 und SOAP 1.2; WS-Security-Konfiguration für unternehmensweite SOAP-Dienste mit Nachrichtensicherheit auf Protokollebene.

GraphQL API-Überwachung

Die wichtigste Überwachungsherausforderung bei GraphQL: die meisten GraphQL-Serverimplementierungen geben HTTP 200 auch bei Teilfehlern oder fehlerhaften Abfragen zurück. Der HTTP-Statuscode ist kein verlässliches Fehlschlagsignal. Sie müssen:

- Speziellen Abfrage-Content senden und das Antwortobjekt

dataprüfen - Das

errors-Array im Antwortkörper prüfen – im Standard-GraphQL hat jede Antwort optional ein obersteserrors-Feld, das bei Erfolg leer oder nicht vorhanden und bei Fehlern gefüllt ist. Eine 200-Antwort mit einem gefülltenerrors[]bedeutet, dass die Anfrage auf GraphQL-Ebene fehlgeschlagen ist, obwohl HTTP erfolgreich war - Abfragespezifische Dateninvarianten validieren: sicherstellen, dass erwartete Felder im data-Objekt vorhanden, nicht null und korrekt typisiert sind – manche Systeme kodieren Fachbereichsfehler innerhalb des data-Objekts statt das obere errors-Array zu füllen

- Abfragekomplexitäts- und Tiefenlimits überwachen, um Leistungsabfall zu erkennen, bevor es zu Timeouts kommt

gRPC API-Überwachung

gRPC verwendet standardmäßig Protocol Buffers über HTTP/2, während gRPC-Web HTTP/1.1 über einen Proxy für Browser-Clients unterstützt. Überwachungsanforderungen: Proto-Datei-Import für Dienst- und Methodendefinitionen; Unterstützung für binäre Kodierung/Dekodierung von Protocol Buffer-Nachrichten; Validierung der Statuscodes anhand von gRPC-Statuscodes (OK, UNAVAILABLE, DEADLINE_EXCEEDED usw.) – nicht HTTP-Statuscodes; Unterstützung für RPC-Typen Unary, Server-Streaming, Client-Streaming und Bidirektionales Streaming.

WebSocket API-Überwachung

WebSocket-APIs halten persistente bidirektionale Verbindungen für Echtzeitdaten aufrecht. Die Überwachung validiert die Verbindungsaufbauzeit und den Erfolg des WebSocket-Handshakes, Nachrichtenlieferlatenz und Payload-Korrektheit sowie die Verbindungsstabilität über die Zeit, einschließlich Wiederverbindungsverhalten nach Verbindungsabbrüchen.

Öffentliche API-Überwachung vs. Interne API-Überwachung

Die meisten API-Überwachungsanleitungen konzentrieren sich ausschließlich auf öffentliche Endpunkte. In Microservices-Architekturen hingegen ist der Großteil der kritischen API-Aufrufe intern — Service-zu-Service-Aufrufe, die niemals das öffentliche Internet erreichen.

| Öffentliche API-Überwachung | Interne API-Überwachung | |

|---|---|---|

| Was abgedeckt wird | Kundenorientierte Endpunkte, Partner-APIs, Integrationen von Drittanbietern | Interne Microservices, private VPCs, Testumgebungen, APIs hinter der Firewall |

| Funktionsweise | Externe Überwachungsagenten führen Prüfungen von globalen Standorten über das öffentliche Internet durch | Ein innerhalb Ihres Netzwerks bereitgestellter Private Agent initiiert ausgehende Verbindungen zur Überwachungsplattform |

| Firewall-Anforderungen | Keine — Prüfungen stammen von außen | Keine eingehenden Regeln erforderlich — Agent initiiert nur ausgehende Verbindungen |

| Was erkannt wird | DNS-Auflösungsfehler, CDN-Routing-Probleme, TLS-Fehler, geografische Verfügbarkeitslücken | Inter-Service-Ausfälle, Verzögerungen im Authentifizierungs-Microservice, Verschlechterung der Datenbankabfrage-API |

| Bereitstellung | Keine Installation — sofort einsatzbereit | Agent vor Ort oder in privater Cloud installiert (Windows und Linux unterstützt) |

Interne Microservice-APIs sind die häufigste Ursache für Kaskadenausfälle. Ein degradierter Authentifizierungsdienst oder eine langsame Datenzugriffs-API verursacht nachgelagerte Probleme, die als Frontend-Fehler sichtbar werden — wodurch es ohne interne Sichtbarkeit schwer wird, die Ursache zu finden. Die Überwachung interner APIs ermöglicht es Teams zu isolieren, ob der Fehler in der API-Schicht, dem nachgelagerten Microservice oder der Datenbank liegt. Erfahren Sie mehr über Private Agent-Überwachung hinter Ihrer Firewall.

Best Practices für API-Überwachung

Diese Praktiken reduzieren die mittlere Erkennungszeit (MTTD), verbessern die Präzision von Alarmen und stellen sicher, dass die Überwachungsabdeckung dem Produktionsrisiko entspricht.

- Überwachen Sie innerhalb von 1-Minuten-Intervallen für umsatzkritische Endpunkte. Für Zahlungs-, Authentifizierungs- und zentrale Daten-APIs hat jede unerkannte Minute direkte geschäftliche Auswirkungen. Für weniger kritische Endpunkte sind 5- oder 15-minütige Intervalle akzeptabel.

- Führen Sie Prüfungen von mindestens 5 geografisch verteilten Standorten aus. Ein einzelner Überwachungsstandort kann regionale DNS-Ausfälle, CDN-Fehlkonfigurationen oder geografisch spezifische Routing-Probleme nicht erkennen. Mindestens sollten Nordamerika, Europa und Asien-Pacific.

- Validieren Sie den Payload-Inhalt, nicht nur Statuscodes. Konfigurieren Sie JSONPath-Assertions für jeden kritischen Endpunkt. Die kostspieligsten stillen Fehler sind APIs, die HTTP 200 mit unvollständigen, veralteten oder fehlerhaften Daten zurückgeben.

- Verwenden Sie baselinespezifische Alarmgrenzen, keine statischen Millisekundenwerte. Erstellen Sie eine Antwortzeit-Basislinie pro Endpunkt und konfigurieren Sie Warnungen bei dem 2-fachen des P95-Werts. Statische Schwellenwerte erzeugen Fehlalarme bei normalen Verkehrsspitzen.

- Beziehen Sie die Authentifizierung in Ihre Überwachungsketten ein. Token-Ablauf, OAuth-Aktualisierungsfehler und Zertifikatsrotation sind Hauptursachen für API-Ausfälle. Die Überwachung der Authentifizierungsschritte erkennt kennwortbezogene Fehler, bevor sie sich ausbreiten.

- Erstellen Sie mehrstufige Transaktionsmonitore für jede kritische Benutzerreise. Login-Flows, Checkout-Sequenzen und Datenübermittlungs-Workflows sind verkettete API-Aufrufe. Monitore für einzelne Endpunkte können keine Fehler zwischen den Schritten erkennen, die durch falsche Datenübergabe oder Sitzungsverwaltung verursacht werden.

- Überwachen Sie Drittanbieter-API-Abhängigkeiten als separate Monitore. Erstellen Sie dedizierte Monitore für Stripe, Okta, Salesforce und andere externe Abhängigkeiten. Dies beantwortet sofort die Frage, ob ein Fehler intern oder extern ist.

- Importieren Sie Postman- oder Insomnia-Sammlungen, um die Überwachung zu starten. Konvertieren Sie bestehende API-Definitionen in 24/7-Produktionsmonitore, ohne die Anfrage-Strukturen neu erstellen zu müssen. Dies beseitigt die Lücke zwischen der Testphase in der Entwicklung und der Produktionsüberwachung.

- Integrieren Sie API-Prüfungen nach der Bereitstellung in CI/CD-Pipelines. Führen Sie synthetische API-Tests als automatisierte Smoke-Tests nach jeder Bereitstellung aus. Wenn die Nachbereitungsprüfungen fehlschlagen, erwägen Sie einen automatischen Rollback oder eine Traffic-Stop-Funktion in progressiven Bereitstellungs-Setups (Blue/Green oder Canary) — unter Verwendung von Bestätigungsläufen von einem zweiten Standort, um Fehlalarme zu reduzieren, bevor automatisierte Maßnahmen ergriffen werden.

- Leiten Sie Alarme mit Eskalationsrichtlinien an PagerDuty, Slack oder Microsoft Teams weiter. Alarmierung nur per E-Mail führt zu Verzögerungen bei der Erkennung. Native Integrationen mit Incident-Management-Tools stellen sicher, dass Warnungen sofort die richtige Person erreichen, mit definierten Eskalationswegen bei Nichtreaktion.

Herausforderungen der API-Überwachung

Selbst gut gestaltete Überwachungs-Setups stehen vor betrieblichen Herausforderungen. Wenn Teams diese vorhersehen, können sie besser darauf reagieren.

Transparenz bei Drittanbieter-APIs

Die Überwachung externer Abhängigkeiten liefert Verfügbarkeits- und Latenzdaten, kann aber die interne Ursache einer Verschlechterung nicht aufdecken. Wenn Stripe oder Okta langsamer werden, können Sie dies bestätigen und den Schadensradius eingrenzen – aber die Ursachenanalyse hängt von Anbieter-Statusseiten und Support-Eskalationswegen ab.

Ratenbegrenzung

Überwachungsagenten zählen zu den Ratenlimits Ihrer API. Das gesamte Volumen synthetischer Anfragen skaliert wie folgt: Standorte × Prüfungen pro Stunde × API-Aufrufe pro Monitorlauf × Bestätigungswiederholungen. Für einen Monitor mit einem einzelnen Endpunkt: 30 Standorte × 60 Prüfungen/Stunde = 1.800 Anfragen/Stunde. Für einen 5-Schritte-Transaktionsmonitor bei denselben Einstellungen: 30 × 60 × 5 = 9.000 Anfragen/Stunde pro Monitor. Berücksichtigen Sie dies bei der Planung der Ratenlimits, besonders bei internen APIs mit strengeren Grenzwerten. Stellen Sie sicher, dass die IP-Bereiche Ihres Überwachungsanbieters dort, wo erforderlich, auf der Whitelist stehen.

Authentifizierungs-Komplexität

APIs, die kurzlebige Tokens verwenden, benötigen Überwachungstools, die eine automatische Token-Aktualisierung handhaben können. Benutzer-delegierte OAuth 2.0 Tokens (Authorization Code Flow) laufen typischerweise nach 15 Minuten bis 1 Stunde ab; Client Credentials Tokens für Maschine-zu-Maschine-Kommunikation halten oft 1–24 Stunden; in hochsicheren Umgebungen können 5-Minuten-Fenster vorgeschrieben sein. Zertifikat-basierte Authentifizierung und rotierende API-Schlüssel erfordern ebenfalls sorgfältiges Credential-Management.

Dynamische und nicht-deterministische Antworten

APIs, die zeitgestempelte Daten, paginierte Ergebnisse oder zufällig geordnete Arrays zurückgeben, sind schwer mit exakten Wertvergleichen zu überprüfen. Verwenden Sie JSONPath-Ausdrücke, die Struktur, Feldvorhandensein und Feldtypen validieren – anstatt exakte Feldwerte, die sich bei jeder Anfrage ändern.

Alarm-Müdigkeit

Überwachung von zu vielen Endpunkten im 1-Minuten-Takt oder zu eng gesetzte Schwellenwerte erzeugen Lärm, der Teams für echte Alarme abstumpft. Nutzen Sie gestaffelte Überwachung: 1 Minute für kritische Pfade, 5–15 Minuten für nicht-kritische Endpunkte. Bestätigen Sie Alarme von einem sekundären Standort, bevor Sie Benachrichtigungen auslösen, um vorübergehende Fehlalarme zu vermeiden.

Protokoll-Vielfalt

REST, SOAP, GraphQL, gRPC und WebSocket erfordern jeweils unterschiedliche Prüfstrategien. Ein Tool, das nur REST unterstützt, verpasst SOAP-Service-Ausfälle und meldet GraphQL-Fehler fälschlicherweise als erfolgreich, da diese HTTP 200 zurückgeben.

Wie man API-Überwachung mit Dotcom-Monitor einrichtet

Dotcom-Monitor bietet synthetische API-Überwachung für REST, SOAP und GraphQL von über 30 globalen Standorten mit 1-Minuten-Prüfintervallen, Unterstützung für Mehrschritt-Transaktionen und native Integrationen mit PagerDuty, Slack, and Microsoft Teams.

Schritt 1 — Definieren Sie Ihren Endpunkt und die Assertions

- Endpoint-URL: Der zu überwachende API-Endpunkt

- HTTP-Methode: GET, POST, PUT, PATCH oder DELETE

- Request-Header:

Content-Type,Authorizationund alle erforderlichen benutzerdefinierten Header - Request-Body: JSON-Payload für POST-/PUT-Anfragen

- Authentifizierung: OAuth 2.0, Bearer Token, API-Schlüssel, Basic Auth, mTLS, AWS Signature v4, NTLM, Kerberos oder benutzerdefinierte Header

- Assertions: HTTP-Statuscode, Antwortzeit-Schwellenwert, Header-Werte, JSONPath-/XPath-Payload-Assertions

Schritt 2 — Importieren aus Postman oder Insomnia

Wenn Ihr Team Postman oder Insomnia verwendet, überspringen Sie die manuelle Endpunktkonfiguration vollständig:

- Postman: Exportieren Sie Ihre Collection als v2.0 oder v2.1 JSON und importieren Sie diese in Dotcom-Monitor. Anforderungsdefinitionen, Header, Body, Umgebungsvariablen und Test-Assertions werden beibehalten.

- Insomnia: Exportieren Sie Ihren Workspace als Insomnia v4 JSON-Datei und importieren Sie diese in Dotcom-Monitor. Anforderungsgruppen, Auth-Konfigurationen und Umgebungsvariablen bleiben erhalten.

Beide Importformate wandeln einmalige Entwicklungstests in kontinuierlich geplante 24/7-Produktionsmonitore um, ohne dass eine Neukonfiguration erforderlich ist.

Verwenden Sie bereits Postman? Sie sind 5 Minuten von 24/7-Produktionsüberwachung entfernt.

Importieren Sie Ihre bestehende Postman-Collection direkt in Dotcom-Monitor. Ihre Anforderungsdefinitionen, Header, Umgebungsvariablen und Assertions bleiben erhalten – keine Neukonfiguration notwendig.

Schritt 3 — Konfigurieren Sie Monitoring-Standorte und Frequenz

- Prüffrequenz: 1-, 3-, 5- oder 15-Minuten-Intervalle – je nach Kritikalität pro Endpunkt festlegen

- Monitoring-Standorte: Wählen Sie aus über 30 Standorten in Nordamerika, Europa, Asien-Pazifik und Südamerika

- Private Agent: Für interne oder hinter der Firewall befindliche APIs – setzen Sie den Agent lokal oder in Ihrer privaten Cloud ein (Windows und Linux unterstützt). Agent initiiert nur ausgehende Verbindungen – keine eingehenden Firewall-Regeln erforderlich.

- Bestätigungs-Wiederholungen: Konfigurieren Sie eine Bestätigungsprüfung von einem sekundären Standort vor dem Auslösen von Alarmen, um vorübergehende Netzwerkausfälle als Fehlalarme auszuschließen

Schritt 4 — Konfigurieren Sie die Alarmweiterleitung

- PagerDuty: Leiten Sie kritische Alarme direkt an Bereitschaftspläne weiter mit automatischer Erstellung und Eskalation von Vorfällen

- Slack / Microsoft Teams: Senden Sie Alarmnachrichten mit Endpunktdetails, Fehlertyp und Antwortdaten an Operations-Kanäle

- Email, SMS, Phone call: Konfigurieren Sie Benachrichtigungseinstellungen pro Kontakt oder pro Team

- Webhook: Integration mit OpsGenie, ServiceNow oder jedem HTTP-kompatiblen Dienst

- Schwellenwertkonfiguration: Legen Sie Alarmbedingungen pro Metrik fest — Antwortzeit, Fehlerquote, Assertion-Fehlerrate — mit Schweregraden

Schritt 5 — CI/CD-Pipeline-Integration

- Dotcom-Monitor REST API: Über HTTP-API-Aufrufe aus jedem CI/CD-System programmatisch Monitoring-Aufgaben erstellen, aktualisieren und auslösen

- GitHub Actions / Azure DevOps / Jenkins: Fügen Sie einen Post-Deploy-Schritt hinzu, der einen Dotcom-Monitor-Check startet, auf Ergebnisse wartet und die Pipeline bei fehlgeschlagenen Assertions abbricht

- Vorproduktion-Validierung: Führen Sie dieselben synthetischen Prüfungen in Ihrer Staging-Umgebung aus, bevor Sie Builds in die Produktion übernehmen — erfassen Sie Regressionen, bevor ein Benutzer betroffen ist

API-Monitoring-Anwendungsfälle nach Branche

| Branche | Kritische APIs zur Überwachung | Wichtige Monitoring-Anforderungen |

|---|---|---|

| E-Commerce | Checkout, Zahlungsautorisierung, Inventar, Versand, Warenkorbverwaltung | Mehrstufige Transaktionsketten; 1-Minuten-Intervalle; Payload-Assertion bei Zahlungsbestätigungsstatus |

| FinTech / Banking | Transaktionsverarbeitung, KYC/AML-Verifizierung, Kontostand, FX-Kurse, Überweisungs-APIs | SLAs mit Latenz unter 200 ms; Compliance-Prüfungen zur Unterstützung von PCI-DSS-Nachweisen; vollständige Validierung des Authentifizierungsablaufs |

| Healthcare | EHR-Integrationen (HL7 FHIR), Versicherungsportale, Telemedizin-Endpunkte, Patiententerminplanung | Compliance-Prüfungen zur Unterstützung von HIPAA-Nachweisen; Payload-Validierung für Datenvollständigkeit; 99,99 % Betriebszeit-SLA |

| SaaS | Kernprodukt-APIs, Webhook-Delivery-Endpunkte, Partnerintegrations-APIs, Authentifizierungs-APIs | API-as-a-Product SLA-Einhaltung; Postman-Import für Konsistenz von Entwicklung zu Monitoring; Überwachung von Drittanbieter-Abhängigkeiten |

| Enterprise IT | CRM, ERP, HRIS, Identitätsanbieter, interne Workflow-Automatisierungs-APIs | Private Agent für hinter der Firewall befindliche APIs; Unterstützung für NTLM/Kerberos-Authentifizierung; abteilungsübergreifende API-Sichtbarkeit |

| Medien / Gaming | CDN-Content-Delivery-APIs, Authentifizierung, Echtzeit-Scoring, Social-Feature-APIs | Geografische Verteilungsüberwachung; WebSocket-Verbindungsüberwachung; Erkennung von Verkehrsspitzen |

Beginnen Sie noch heute mit dem Monitoring Ihrer APIs.

Dotcom-Monitor bietet synthetisches API-Monitoring von über 30 globalen Standorten mit 1-Minuten-PrüfungenIntervalle, Unterstützung für mehrstufige Transaktionen und native Integrationen von PagerDuty, Slack und Microsoft Teams. Die Einrichtung dauert weniger als 5 Minuten. Für die 30-tägige Testphase ist keine Kreditkarte erforderlich.